API7 AI Gateway Alternativen 2026: Top 10 API7 AI Gateway Alternativen

Aktualisiert März 2026

Wenn Sie API7 AI Gateway Alternativen, evaluieren, kartiert dieser Leitfaden die Landschaft wie ein Bauherr. Zuerst klären wir, was API7 KI-Gateway ist—eine AI/LLM-Governance-Schicht mit Richtlinien, Plugins und Beobachtbarkeit—und vergleichen dann die 10 besten Alternativen. Wir platzieren TeilenAI zuerst für Teams, die eine API über viele Anbieter hinweg wünschen, einen transparenten Marktplatz mit Preis/Latenz/Verfügbarkeit/Betriebszeit vor der Weiterleitung, sofortiges Failover, und menschengetriebene Wirtschaftlichkeit (70 % der Ausgaben gehen an Anbieter).

Schnelle Links — Modelle durchsuchen · Spielplatz öffnen · API-Schlüssel erstellen · API-Referenz · Benutzerhandbuch · Veröffentlichungen ansehen

Was API7 AI Gateway ist (und nicht ist)

API7 (Schöpfer hinter Apache APISIX) bietet ein KI-Gateway das sich auf Governance und Zuverlässigkeit für LLM-Verkehr konzentriert—Zentralisierung von Anmeldeinformationen/Richtlinien, Bereitstellung von KI-orientierten Plugins (z. B. Multi-LLM-Proxying, Ratenbegrenzung) und Integration mit beliebten Observabilitäts-Stacks. Kurz gesagt: ein Gateway für KI-Ausgang, kein transparenter Multi-Anbieter Marktplatz. Wenn Sie bereits APISIX/APIs verwenden, werden Sie den Control-Plane/Data-Plane-Ansatz und das Plugin-Modell erkennen.

Wenn Ihre Priorität Richtlinien-Durchsetzung, Sicherheit, und OpenTelemetry-freundliche Observabilität, ist, passt ein KI-Gateway wie das von API7 in diese Richtung. Wenn Sie Anbieter-unabhängige Wahl, Transparenz vor der Weiterleitung (sehen Sie Preis/Latenzzeit/Betriebszeit/Verfügbarkeit, bevor Sie anrufen), und sofortiges Failover über viele Anbieter hinweg möchten Sie ein Aggregator (wie ShareAI) zusätzlich oder anstelle eines Gateways.

Aggregatoren vs Gateways vs Agentenplattformen

LLM-Aggregatoren: eine API über viele Modelle/Anbieter hinweg mit Transparenz vor der Weiterleitung (Preis, Latenz, Betriebszeit, Verfügbarkeit, Anbietertyp) und intelligentes Routing/Failover. Beispiele: ShareAI, OpenRouter.

KI-Gateways: Richtlinien/Verwaltung am Rand (Anmeldedaten, Ratenlimits, Leitplanken) plus Beobachtbarkeit; Sie bringen Ihre Anbieter mit. Beispiele: API7 AI Gateway, Kong AI Gateway, Portkey.

Agent/Chatbot-Plattformen: Verpacktes UX für Assistenten (Speicher, Tools, Kanäle) — ausgerichtet auf Endbenutzererfahrungen statt anbieterunabhängige Aggregation. Beispiele: Orq, bestimmte Orchestrierungssuiten.

TL;DR: Gateways sind Governance-zuerst; Aggregatoren sind Wahl + Resilienz zuerst. Viele Teams paaren ein Gateway für organisationsweite Richtlinien mit ShareAI für marktplatzgesteuertes Routing.

Wie wir die besten API7 AI Gateway-Alternativen bewertet haben

- Modellbreite & Neutralität — proprietär + offen; Wechsel ohne Neuschreibungen.

- Latenz & Resilienz — Routing-Richtlinien, Timeouts, Wiederholungen, sofortiges Failover.

- Governance & Sicherheit — Schlüsselverwaltung, Bereiche, regionale Weiterleitung, Leitplanken.

- Beobachtbarkeit — Protokolle/Spuren und Kosten-/Latenz-Dashboards.

- Preistransparenz & TCO — vergleichen Sie reale Kosten bevor Sie weiterleiten.

- Entwicklererfahrung — Dokumentationen, SDKs, Schnellstarts; Zeit bis zum ersten Token.

- Community & Wirtschaft — ob Ihre Ausgaben Angebot wachsen lassen (Anreize für GPU-Besitzer).

Top 10 API7 AI Gateway Alternativen

#1 — ShareAI (Menschenbetriebene KI-API)

Was es ist. A Multi-Provider-API mit einer transparenten Marktplatz und intelligenten Weiterleitung. Mit einer Integration, durchsuchen Sie einen großen Katalog (150+ Modelle) und vergleichen Preis, Latenz, Betriebszeit, Verfügbarkeit, Anbietertyp—dann leiten Sie mit sofortiges Failover. Die Wirtschaft wird von Menschen angetrieben: 70% von jedem Dollar fließt zu Anbietern (Gemeinschaft oder Unternehmen), die Modelle online halten.

Warum es hier #1 ist. Wenn Sie möchten Anbieter-unabhängige Aggregation mit Transparenz vor der Weiterleitung und Resilienz, ist ShareAI die direkteste Lösung. Behalten Sie ein Gateway, wenn Sie organisationsweite Richtlinien benötigen; fügen Sie ShareAI für marktplatzgesteuerte Weiterleitung hinzu.

- Eine API → 150+ Modelle über viele Anbieter hinweg; keine Umschreibungen, keine Bindung.

- Transparenter Marktplatz: wählen Sie nach Preis, Latenz, Betriebszeit, Verfügbarkeit, Anbietertyp.

- Resilienz standardmäßig: Routing-Richtlinien + sofortiges Failover.

- Faire Wirtschaft: 70 % der Ausgaben geht an Anbieter (Gemeinschaft oder Unternehmen).

Schnelle Links — Modelle durchsuchen · Spielplatz öffnen · API-Schlüssel erstellen · API-Referenz · Benutzerhandbuch · Veröffentlichungen ansehen

Für Anbieter: verdienen, indem Modelle online gehalten werden

Jeder kann ein ShareAI-Anbieter werden—Gemeinschaft oder Unternehmen. Einsteigen über Windows, Ubuntu, macOS, oder Docker. Beitragen Leerlaufzeit-Ausbrüche oder ausführen immer eingeschaltet. Wählen Sie Ihren Anreiz: Belohnungen (Geld), Austausch (Token / AI Prosumer), oder Mission (spenden Sie % an NGOs). Während Sie skalieren, können Sie Ihre eigenen Inferenzpreise festlegen festlegen und bevorzugte Sichtbarkeit. Anbieter-Dokumentation: Anbieterleitfaden.

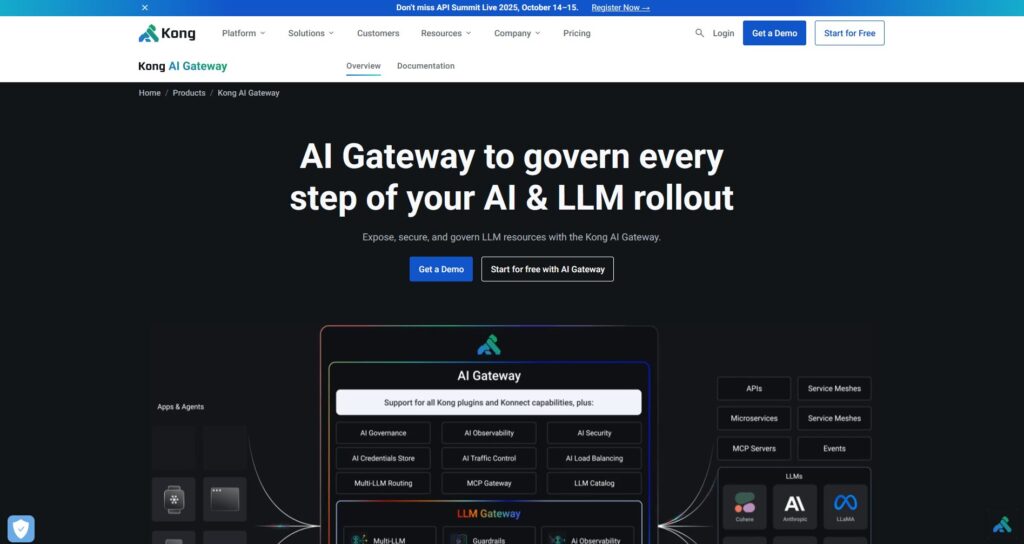

#2 — Kong AI-Gateway

Enterprise AI/LLM Gateway—Governance, Richtlinien/Plugins, Analytik, Beobachtbarkeit für KI-Verkehr am Rand. Es ist eine Steuerungsebene statt eines Marktplatzes.

#3 — Portkey

KI-Gateway mit Schwerpunkt auf Leitplanken, Beobachtbarkeit und Governance—beliebt in regulierten Branchen. Wenn Sie gesucht haben Portkey-Alternativen, beachten Sie, dass ShareAI die Multi-Provider- Anwendungsfälle mit Marktplatz-Transparenz und Failover, abdeckt, was die Gateway-Funktionen ergänzt.

#4 — OpenRouter

Vereinheitlichte API über viele Modelle; ideal für schnelle Experimente über einen breiten Katalog.

#5 — Eden AI

Aggregiert LLMs plus umfassendere KI-Funktionen (Bild, Übersetzung, TTS) mit Fallbacks/Caching und Batch-Verarbeitung.

#6 — LiteLLM

Ein leichtgewichtiges Python-SDK + selbst hostbarer Proxy, der eine OpenAI-kompatible Schnittstelle zu vielen Anbietern bietet.

#7 — Unify

Qualitätsorientiertes Routing und Bewertung, um bessere Modelle pro Eingabeaufforderung auszuwählen.

#8 — Orq KI

Orchestrierungs-/Kollaborationsplattform, die Teams hilft, von Experimenten zu Produktion mit Low-Code-Flows überzugehen.

#9 — Apigee (mit LLMs dahinter)

Eine ausgereifte API-Management-/Gateway-Lösung, die Sie vor LLM-Anbietern platzieren können, um Richtlinien, Schlüssel und Quoten anzuwenden.

#10 — NGINX

Verwenden Sie NGINX, um benutzerdefiniertes Routing, Token-Durchsetzung und Caching für LLM-Backends zu erstellen, wenn Sie DIY-Kontrolle bevorzugen.

API7 KI-Gateway vs ShareAI

Wenn Sie eine API über viele Anbieter mit transparente Preisgestaltung/Latenzzeit/Betriebszeit und sofortiges Failover, wählen Sie TeilenAI. Wenn Ihre oberste Anforderung ist Egress-Governance—zentralisierte Anmeldedaten, Richtliniendurchsetzung, OpenTelemetry-freundlich Beobachtbarkeit—ein AI-Gateway wie API7 passt in diese Kategorie. Viele Teams kombinieren sie: Gateway für Organisationsrichtlinien + ShareAI für Marktplatz-Routing.

Schneller Vergleich

| Plattform | Wen es bedient | Modellvielfalt | Governance & Sicherheit | Beobachtbarkeit | Routing / Failover | Marktplatztransparenz | Anbieterprogramm |

|---|---|---|---|---|---|---|---|

| TeilenAI | Produkt-/Plattformteams, die eine API + faire Wirtschaftlichkeit benötigen | 150+ Modelle, viele Anbieter | API-Schlüssel & pro-Routen-Kontrollen | Konsolennutzung + Marktplatzstatistiken | Intelligentes Routing + sofortiges Failover | Ja (Preis, Latenz, Verfügbarkeit, Betriebszeit, Anbietertyp) | Ja — offene Versorgung; 70% zu Anbietern |

| API7 KI-Gateway | Teams, die Egress-Governance benötigen | BYO-Anbieter | Zentralisierte Anmeldedaten/Richtlinien | OpenTelemetry-Metriken/Tracing | Bedingtes Routing über Plugins | Nein (Infrastruktur-Tool, kein Marktplatz) | n/v |

| Kong KI-Gateway | Unternehmen, die Richtlinien auf Gateway-Ebene benötigen | BYO | Starke Edge-Richtlinien/Plugins | Analysen | Proxy/Plugins, Wiederholungen | Nein (Infrastruktur) | n/v |

| Portkey | Regulierte/Unternehmensteams | Breit | Leitplanken & Governance | Tiefe Spuren | Bedingte Weiterleitung | Teilweise | n/v |

| OpenRouter | Entwickler, die einen Schlüssel wollen | Breites Katalog | Grundlegende API-Steuerungen | App-seitig | Rückfalle | Teilweise | n/v |

| Eden KI | Teams, die LLM + andere KI-Dienste benötigen | Breit | Standardsteuerungen | Variiert | Fallbacks/Caching | Teilweise | n/v |

| LiteLLM | DIY/Selbstgehosteter Proxy | Viele Anbieter | Konfigurations-/Schlüssellimits | Ihre Infrastruktur | Wiederholungen/Fallback | n/v | n/v |

| Vereinheitlichen | Qualitätsorientierte Teams | Multi-Modell | Standard-API-Sicherheit | Plattformanalysen | Beste-Modell-Auswahl | n/v | n/v |

| Orq | Orchestrierungsorientierte Teams | Breite Unterstützung | Plattformkontrollen | Plattformanalysen | Orchestrierungsflüsse | n/v | n/v |

| Apigee / NGINX | Unternehmen / DIY | BYO | Richtlinien | Add-ons / benutzerdefiniert | Benutzerdefiniert | n/v | n/v |

Preise & TCO: vergleichen echt Kosten (nicht nur Stückpreise)

Roh $/1K Tokens verbirgt das wahre Bild. TCO verschiebt sich mit Wiederholungen/Fallbacks, Latenz (die die Nutzung beeinflusst), Anbieterabweichungen, Speicher für Beobachtbarkeit und Bewertungsdurchläufe. Ein transparenter Marktplatz hilft Ihnen, Routen auszuwählen, die Kosten und Benutzererfahrung ausbalancieren.

TCO ≈ Σ (Basis_Tokens × Einheitspreis × (1 + Wiederholungsrate))

- Prototyp (~10k Tokens/Tag): Optimieren für Zeit bis zum ersten Token (Playground, Schnellstarts).

- Mittelmaßstab (~2M Tokens/Tag): Marktplatz-gesteuertes Routing/Failover kann 10–20% reduzieren und gleichzeitig die Benutzererfahrung verbessern.

- Spitzenlasten: Höhere effektive Tokenkosten durch Wiederholungen während des Failovers erwarten; dafür budgetieren.

Migrationsleitfaden: Wechsel zu ShareAI

Von API7 AI Gateway

Behalten Sie Gateway-Ebene-Richtlinien bei, wo sie glänzen; fügen Sie ShareAI hinzu für Marktplatz-Routing + sofortiges Failover. Muster: Gateway-Authentifizierung/Richtlinie → ShareAI-Routing pro Modell → Marktplatzstatistiken messen → Richtlinien verschärfen.

Von OpenRouter

Modellnamen zuordnen, Eingabeaufforderungsparität überprüfen, dann überwachen 10% des Verkehrs und hochfahren 25% → 50% → 100% solange Latenz-/Fehlerbudgets eingehalten werden. Marktplatzdaten machen Anbieterwechsel unkompliziert.

Von LiteLLM

Ersetzen Sie den selbstgehosteten Proxy auf Produktionsrouten, die Sie nicht betreiben möchten; behalten Sie LiteLLM für die Entwicklung, falls gewünscht. Vergleichen Sie Betriebsaufwand mit den Vorteilen des verwalteten Routings.

Von Unify / Portkey / Orq / Kong

Definieren Sie Erwartungen an Funktionsparität (Analytik, Leitplanken, Orchestrierung, Plugins). Viele Teams arbeiten hybrid: Behalten Sie spezialisierte Funktionen dort, wo sie am stärksten sind; verwenden Sie ShareAI für transparente Anbieterwahl und Failover.

Entwickler-Schnellstart (Copy-Paste)

Die folgenden verwenden eine OpenAI-kompatible Oberfläche. Ersetzen Sie IHRE_SCHLÜSSEL durch Ihren ShareAI-Schlüssel—holen Sie sich einen unter API-Schlüssel erstellen. Siehe die API-Referenz für Details. Probieren Sie ein Modell sofort im Spielplatz.

#!/usr/bin/env bash"

// JavaScript (fetch) — Node 18+/Edge-Laufzeiten;

Sicherheits-, Datenschutz- und Compliance-Checkliste (anbieterunabhängig)

- Schlüsselverwaltung: Rotationsfrequenz; minimale Berechtigungen; Trennung der Umgebungen.

- Datenaufbewahrung: wo Eingaben/Antworten gespeichert werden, wie lange; Standardwerte für Schwärzungen.

- PII & sensible Inhalte: Maskierung; Zugriffskontrollen; regionale Weiterleitung für Datenlokalität.

- Beobachtbarkeit: Eingabe-/Antwortprotokollierung; Möglichkeit zur Filterung oder Pseudonymisierung; Weitergabe von Trace-IDs konsistent (OTel).

- Vorfallreaktion: Eskalationspfade und Anbieter-SLAs.

FAQ — API7 AI Gateway vs. andere Wettbewerber

API7 AI Gateway vs. OpenRouter — schneller Multi-Modell-Zugriff oder Gateway-Kontrollen?

OpenRouter ermöglicht Multi-Modell-Zugriff schnell; API7 zentralisiert Richtlinien und Beobachtbarkeit. Wenn Sie auch möchten Transparenz vor der Weiterleitung und sofortiges Failover, TeilenAI kombiniert Multi-Anbieter-Zugriff mit einer Marktplatzansicht und resilientem Routing.

API7 AI Gateway vs. Traefik AI Gateway — zwei Gateways?

Beide sind Gateways (Richtlinien, Plugins, Analysen), keine Marktplätze. Viele Teams kombinieren ein Gateway mit ShareAI für transparentes Multi-Provider-Routing und Failover.

API7 AI Gateway vs Kong AI Gateway — welches für Deep Edge Policy?

Kong ist stark bei Plugins und Edge-Policy; API7 konzentriert sich auf KI/LLM-Governance und APISIX-Herkunft. Für Anbieterwahl + Resilienz, hinzufügen TeilenAI.

API7 AI Gateway vs Portkey — wer ist stärker bei Guardrails?

Beide betonen Governance und Beobachtbarkeit; Tiefe und Ergonomie unterscheiden sich. Wenn Ihr Hauptbedarf ist transparente Anbieterwahl und Failover, verwenden Sie TeilenAI. (Auch relevant, wenn Sie suchen Portkey-Alternativen.)

API7 AI Gateway vs Eden AI — viele KI-Dienste oder Egress-Kontrolle?

Eden AI aggregiert mehrere KI-Dienste (LLM, Bild, TTS). API7 zentralisiert Richtlinien/Anmeldeinformationen mit KI-Plugins. Für transparente Preisgestaltung/Latenz über viele Anbieter hinweg und sofortiges Failover, wählen Sie TeilenAI.

API7 AI Gateway vs LiteLLM — selbstgehosteter Proxy oder verwaltete Governance?

LiteLLM ist ein DIY-Proxy, den Sie betreiben; API7 ist verwaltete Governance/Beobachtbarkeit für KI-Ausgänge. Wenn Sie keinen Proxy betreiben möchten und marktplatzgesteuertes Routing wünschen,, wählen Sie TeilenAI.

API7 AI Gateway vs Unify — beste Modellauswahl vs Richtliniendurchsetzung?

Unify konzentriert sich auf bewertungsgetriebene Modellauswahl; 1. ; API7 an 2. policy/observability. 3. . Für einer API 4. über viele Anbieter mit 5. Live-Marktplatz-Statistiken, verwenden Sie TeilenAI.

6. API7 AI Gateway vs Orq — Orchestrierung vs Egress-Kontrolle?

7. Orq hilft 8. Workflows zu orchestrieren; API7 regelt 9. den Egress-Verkehr 10. . ShareAI ergänzt beide mit. 11. Marktplatz-Routing 12. API7 AI Gateway vs Apigee — API-Management vs KI-spezifischer Egress.

13. Apigee ist breit

14. API-Management API-Verwaltung; API7 ist KI-fokussiert Egress-Governance. Wenn Sie anbieterunabhängigen Zugriff benötigen mit Marktplatztransparenz, verwenden Sie TeilenAI.

API7 AI Gateway vs NGINX — DIY vs schlüsselfertig

NGINX bietet DIY-Filter/Richtlinien; API7 bietet eine verpackte Schicht mit KI-Plugins und OTel-freundlicher Beobachtbarkeit. Um benutzerdefiniertes Lua zu vermeiden und dennoch transparente Anbieterauswahl zu erhalten, integrieren Sie TeilenAI.

Probieren Sie als Nächstes ShareAI aus

Spielplatz öffnen · Erstellen Sie Ihren API-Schlüssel · Modelle durchsuchen · Lesen Sie die Dokumentation · Veröffentlichungen ansehen · Anmelden / Registrieren