AI Gateway vs Vercel AI Gateway : Pourquoi le BYOI de ShareAI gagne

ShareAI AI Gateway vs Vercel AI Gateway : Ce que c'est, pourquoi c'est important, et comment ShareAI diffère

Passerelle IA devient rapidement la couche manquante entre les applications et un monde désordonné de fournisseurs de modèles, clés, quotas et pannes. Ce guide explique ce qu'est une passerelle AI, résume le Passerelle IA Vercel, et montre comment le réseau ouvert de ShareAI, les paiements aux fournisseurs 70%, et BYOI (Apportez Votre Propre Infrastructure) avec Priorité sur mon appareil créent un chemin différent pour les équipes qui ont besoin de conformité, d'élasticité et de choix.

Qu'est-ce qu'une passerelle AI (et pourquoi les équipes en utilisent une)

Une passerelle AI se situe entre votre application et de nombreux fournisseurs de modèles. Elle offre un point de terminaison unique, un routage basé sur des politiques (coût, latence, conformité), une gestion unifiée des clés et des limites de taux, un basculement automatique et une observabilité de bout en bout. Pour les applications de production (agents, RAG, chat, recherche), elle réduit la dépendance aux fournisseurs et empêche votre code d'être câblé à une seule API.

Vercel AI Gateway : aperçu rapide

Vercel a annoncé sa passerelle le 20 mai 2025 pour unifier l'accès à de nombreux modèles derrière un point de terminaison et le SDK AI. Elle met l'accent sur le changement simple de modèle, le basculement et le routage à faible latence, avec apportez votre propre clé et aucun majoration de jeton mentionné dans une couverture indépendante. Voir le post original et le récapitulatif : Blog Vercel et Résumé InfoQ.

Où Vercel s'intègre le mieux : équipes déjà standardisées sur Vercel + SDK AI qui souhaitent une passerelle unique et raffinée dans cet écosystème avec des journaux, des métriques et un basculement intégrés.

Comment la passerelle de ShareAI diffère

1) Réseau ouvert (pas seulement les grands fournisseurs d'inférence)

ShareAI est l'API IA alimentée par les personnes. Tout fournisseur qualifié (communauté ou entreprise) peut participer, donc vous n'êtes pas limité à une poignée de clouds centralisés. Cela signifie un choix de modèles plus large, du matériel spécialisé et une diversité régionale. Comparez les options sur le Marché des Modèles ou recrutez de nouveaux fournisseurs via le Guide du fournisseur.

2) Économie favorable aux fournisseurs (paiement de 70% par inférence)

ShareAI paie les fournisseurs 70% de chaque inférence. Les incitations pour la disponibilité et la qualité augmentent la capacité du réseau tout en maintenant des prix efficaces. Les fournisseurs peuvent fonctionner en temps d'inactivité ou en permanence, fixer des prix, et même donner un pourcentage à des ONG.

| Élément | Valeur |

|---|---|

| Prix facturé à l'utilisateur | $1.00 |

| Payé au fournisseur (70%) | $0.70 |

| Service ShareAI et frais généraux | $0.30 |

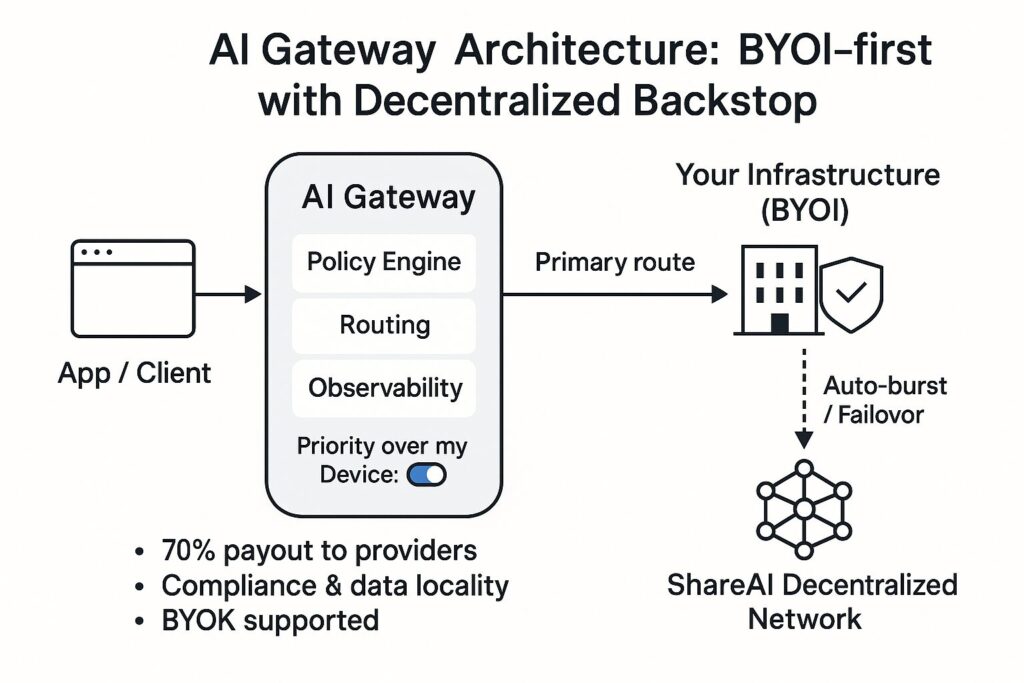

3) BYOI avec routage prioritaire pour la conformité (“ Priorité sur mon appareil ”)

Apportez votre propre infrastructure (sur site ou cloud) et gardez les charges de travail sensibles sous votre contrôle. Avec le Priorité sur mon appareil bascule, votre infrastructure fonctionne en premier ; ShareAI intervient uniquement lorsque vous avez besoin de capacité supplémentaire—agissant comme un répartiteur de charge global. Cela simplifie la localisation des données et la conformité tout en préservant l'élasticité.

Activer Priorité sur mon appareil (par clé API)—ouvrez la page Clé API dans la Console et activez Priorité sur mon appareil pour la clé utilisée par votre application. Lorsque activé, ShareAI dirige d'abord vers vos appareils connectés ; lorsqu'aucun ne convient, les requêtes basculent vers le réseau décentralisé. Voir le guide Priorité sur mon appareil et le Guide de l'utilisateur de la Console.

4) Échelle instantanée + monétisation en veille

Lorsque le trafic augmente, vous accédez au réseau décentralisé de ShareAI sans temps de préchauffage. Lorsque votre infrastructure est inactive, vous pouvez choisir de gagner en contribuant de la capacité au réseau. C’est un gain pour les organisations (échelle instantanée et conformité), un gain pour les fournisseurs (revenus), et un gain pour les utilisateurs (plus de choix sur le coût/la latence).

Vercel AI Gateway vs ShareAI : côte à côte

| Capacité | Passerelle IA Vercel | ShareAI |

|---|---|---|

| Étendue du réseau | Point de terminaison unique pour plusieurs modèles auprès des principaux fournisseurs (détails). | Réseau ouvert : principaux fournisseurs plus fournisseurs indépendants/communautaires (parcourir les modèles). |

| Priorité BYOI et sur site | Focus sur le routage/la fiabilité ; centré sur le SDK. BYOK mis en avant dans la couverture (InfoQ). | BYOI en premier. Bascule par clé Priorité sur mon appareil fait de votre infrastructure le premier saut (comment ça fonctionne). |

| Basculement | Basculement automatique entre les fournisseurs (InfoQ). | Sauvegarde décentralisée à travers de nombreux fournisseurs/régions ; débordement basé sur des politiques. |

| Économie | BYOK avec une majoration de jeton de 0% dans les rapports (InfoQ). | Paiement de 70% aux fournisseurs ; incitations transparentes du marché. |

| Observabilité | Journaux, métriques, suivi des coûts intégrés. | Télémétrie au niveau des requêtes + signaux du marché (latence, disponibilité, réputation). |

| Expérience développeur | Intégration étroite du SDK AI ; code minimal pour changer de modèles. | REST/SDKs, contrôles de politique dans la Console ; démarrage rapide dans le Référence API. |

| Meilleur ajustement | Piles natives Vercel souhaitant une passerelle consolidée + expérience SDK. | Équipes nécessitant une conformité prioritaire BYOI, une élasticité décentralisée et des revenus fournisseurs. |

Comment ShareAI fonctionne en coulisses

Flux de requêtes : (1) Vérification de politique et de clé — le basculement par clé détermine votre premier saut. (2) Routage prioritaire de conformité — si votre cluster/appareil est en ligne et éligible au modèle, il traite la requête. (3) Les vérifications de santé/latence surveillent continuellement les performances. (4) Repli décentralisé — débordement vers le réseau de ShareAI si nécessaire.

Intégration des fournisseurs et qualité : rejoignez en tant que Communauté ou Entreprise avec des installateurs Windows/Ubuntu/macOS/Docker ; la réputation prend en compte la disponibilité, la latence et les niveaux de référence. Les fournisseurs contrôlent les prix et gagnent en visibilité en respectant les SLOs. Voir le Guide du fournisseur.

Démarrage rapide : utilisez ShareAI comme votre passerelle AI

- Créer une clé API dans la Console.

- Basculer Priorité sur mon appareil ACTIVÉ pour cette clé si votre infrastructure doit fonctionner en premier.

- Envoyez une demande en utilisant le démarrage rapide de l'API ou essayez-le dans le Terrain de jeu.

curl -X POST https://api.shareai.now/v1/chat/completions \"À partir de là, échangez les modèles en modifiant l' modèle identifiant. Surveillez la latence, le coût et le routage dans le Guide de l'utilisateur de la Console, puis explorez les nouvelles versions dans Versions.

Quand choisir ShareAI plutôt que Vercel AI Gateway (et quand ne pas le faire)

Choisissez ShareAI si vous avez besoin de BYOI avec un routage axé sur la conformité (Priorité sur mon appareil), une élasticité décentralisée pour les pics de trafic, et des revenus pour les fournisseurs/organisations (paiement 70%, monétisation du temps d'inactivité).

Choisissez Vercel AI Gateway si vous souhaitez une expérience native Vercel avec le SDK AI, une facturation/observabilité consolidée au sein de cette plateforme, et un basculement intégré simplifié (Récapitulatif InfoQ).