Eden AI Alternatif 2026: ShareAI vs OpenRouter, Portkey, Kong AI, Unify, Orq & LiteLLM

Eden AI Alternatif 2026: ShareAI vs OpenRouter, Portkey, Kong AI, Unify, Orq & LiteLLM

Diperbarui Maret 2026

Pengembang menyukai Eden AI karena menawarkan satu API di berbagai penyedia AI dan modalitas—LLM ditambah pembuatan gambar, OCR/pemrosesan dokumen, pengenalan suara-ke-teks, dan terjemahan—bersama dengan tambahan yang berguna seperti perbandingan model, pemantauan biaya & API, pemrosesan batch, caching, dan manajemen multi-kunci API. Harga tanpa komitmen, bayar sesuai penggunaan, dan Anda dapat menggunakan Kotak Pasir token untuk mengembalikan respons dummy saat menghubungkan aplikasi Anda.

Namun, ini bukan satu-satunya jalur. Jika Anda lebih peduli tentang transparansi pasar (dapat memilih penyedia berdasarkan harga, latensi, waktu aktif, ketersediaan sebelum Anda mengarahkan), tata kelola gateway yang ketat, atau hosting mandiri, alternatif Eden AI mungkin lebih cocok. Panduan ini memetakan opsi seperti seorang pembangun—sehingga Anda dapat mengirimkan dengan cepat dan menjaga TCO tetap dapat diprediksi.

- Apa yang sebenarnya dilakukan Eden AI (dan di mana mungkin tidak cocok)

- Cara memilih alternatif Eden AI

- Alternatif Eden AI terbaik (pilihan cepat)

- Penjelasan mendalam: alternatif terbaik

- Quickstart: panggil model dalam hitungan menit (ShareAI)

- Perbandingan sekilas

- FAQ

Apa yang sebenarnya dilakukan Eden AI (dan di mana mungkin tidak cocok)

Apa itu. Eden AI adalah API terpadu melalui banyak penyedia dan modalitas. Anda dapat memanggil chat/completions untuk LLM, menjalankan visi komputer dan pembuatan gambar, memproses dokumen dengan OCR, mengubah ucapan menjadi teks, dan menerjemahkan—tanpa menjahit beberapa SDK vendor. A Perbandingan Model alat membantu Anda menguji penyedia secara berdampingan. Pemantauan Biaya dan Pemantauan API melacak pengeluaran dan penggunaan. Pemrosesan Batch menangani beban kerja besar, dan Caching API mengurangi biaya ulang dan latensi. Anda dapat membawa kunci penyedia Anda sendiri atau membeli kredit melalui Eden. A token Sandbox mengembalikan respons dummy yang aman selama integrasi.

Cara kerja penetapan harga. Eden AI menekankan tidak ada biaya langganan tambahan: Anda membayar per permintaan sesuai tarif penyedia, dan Anda dapat secara opsional menambahkan kredit yang dikonsumsi di berbagai layanan. Banyak tim memulai dengan Sandbox saat menghubungkan permintaan, lalu beralih ke kunci nyata atau kredit untuk produksi.

Di mana itu mungkin tidak cocok. Jika Anda membutuhkan (a) sebuah pasar yang transparan tampilan per penyedia harga, latensi, waktu aktif, dan ketersediaan sebelum setiap rute, (b) tata kelola tingkat gateway (kebijakan di tepi jaringan, jejak mendalam, ekspor yang ramah SIEM), atau (c) sebuah jalur jalur yang sepenuhnya Anda operasikan, Anda mungkin lebih memilih kelas alat yang berbeda (pengumpul pertama di marketplace, gateway, atau proxy sumber terbuka). Alternatif di bawah ini mencakup kekuatan tersebut.

Cara memilih alternatif Eden AI

- Total biaya kepemilikan (TCO). Jangan berhenti di $/1K token. Faktor tingkat cache hit, pengulangan/fallback, antrian, biaya evaluator, dan overhead operasional dari observabilitas.

- Latensi & keandalan. Pilih routing yang sadar wilayah, penggunaan ulang cache hangat (tetap pada penyedia yang sama untuk menggunakan kembali konteks), dan perilaku fallback yang tepat (misalnya, coba ulang pada 429; eskalasi pada timeout).

- Observabilitas & tata kelola. Jika Anda membutuhkan pembatasan, log audit, dan penegakan kebijakan di tepi, sebuah gerbang (misalnya, Portkey atau Kong AI Gateway) bisa lebih kuat daripada pengumpul murni.

- Self-host vs terkelola. Lebih suka Docker/K8s/Helm dan endpoint yang kompatibel dengan OpenAI? LiteLLM adalah pilihan OSS umum; Kong AI Gateway adalah infrastruktur yang Anda operasikan. Lebih suka kecepatan yang di-host dengan transparansi gaya marketplace? Lihat ShareAI, OpenRouter, atau Satukan.

- Luas di luar obrolan. Jika roadmap mencakup OCR, ucapan, dan terjemahan di bawah satu orkestrator, cakupan multi-modal seperti Eden AI dapat menyederhanakan pengiriman.

- Tahan masa depan. Pilih alat yang membuat pergantian penyedia/model menjadi mudah (misalnya, routing dinamis atau API universal) sehingga Anda dapat mengadopsi model yang lebih baru, lebih murah, atau lebih cepat tanpa penulisan ulang.

Alternatif Eden AI terbaik (pilihan cepat)

ShareAI (pilihan kami untuk transparansi marketplace + ekonomi pembangun) — Satu API di seluruh 150+ model dengan failover instan dan marketplace yang menampilkan harga/latensi/waktu aktif/ketersediaan sebelum Anda mengarahkan. Penyedia (komunitas atau perusahaan) mendapatkan 70% pendapatan, menyelaraskan insentif dengan keandalan. Jelajahi: Jelajahi Model • Baca Dokumentasi • Taman bermain • Buat API Key • Panduan Penyedia

OpenRouter — API Terpadu di banyak model; perutean penyedia dan caching prompt optimalkan biaya dan throughput dengan menggunakan konteks hangat di mana didukung.

Portkey — Gateway AI dengan fallback yang dapat diprogram, playbook pembatasan tingkat, dan cache sederhana/semantik, ditambah jejak/metrik. Sangat baik untuk pengaturan berbasis kebijakan dan operasi gaya SRE.

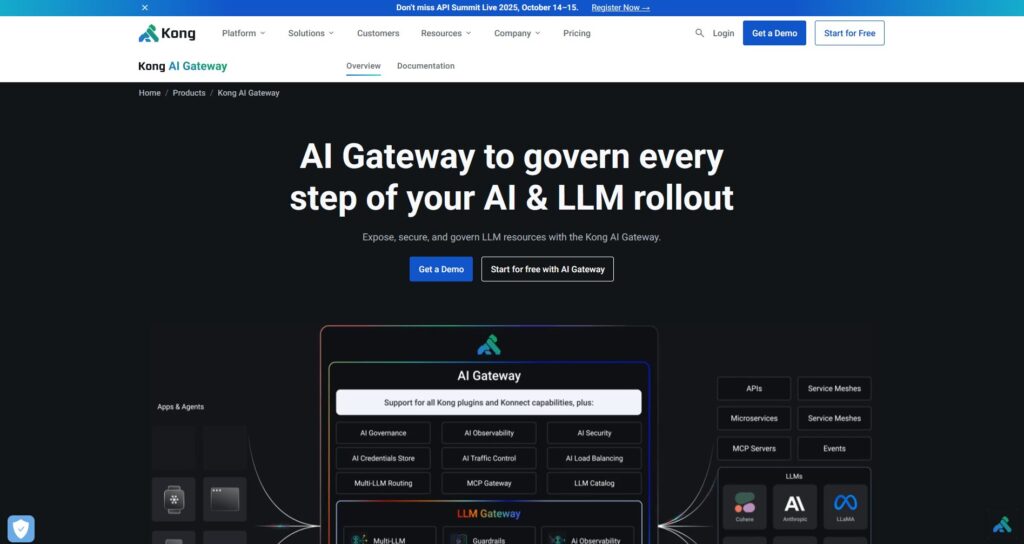

Kong AI Gateway — Tata kelola di tepi dengan plugin AI, analitik, dan kebijakan; cocok dengan agregator jika Anda memerlukan kontrol terpusat.

Satukan — Router berbasis data yang dioptimalkan untuk biaya/kecepatan/kualitas menggunakan kinerja langsung dan API universal.

Orq.ai — Kolaborasi + LLMOps (eksperimen, evaluator—termasuk. RAG), penerapan, RBAC/VPC). Baik saat Anda memerlukan eksperimen + tata kelola.

LiteLLM — Proxy/gateway sumber terbuka dengan endpoint yang kompatibel dengan OpenAI, anggaran/batas tingkat, pencatatan/metrik, dan pengaturan ulang/pengalihan fallback—dapat diterapkan melalui Docker/K8s/Helm.

Penjelasan mendalam: alternatif terbaik

ShareAI (API AI yang Didukung oleh Orang)

Apa itu. Jaringan AI yang mengutamakan penyedia dan API terpadu. Jelajahi katalog besar model/penyedia dan rute dengan failover instan. Marketplace menampilkan harga, latensi, waktu aktif, dan ketersediaan di depan. Ekonomi kirim 70% pengeluaran ke penyedia GPU yang menjaga model tetap online.

Mengapa tim memilihnya. Pasar yang transparan untuk membandingkan penyedia sebelum Anda mengarahkan, ketahanan-secara-default melalui failover cepat, dan ekonomi yang selaras dengan pembangun. Mulai cepat di Taman bermain, buat kunci di Konsol, dan ikuti Memulai cepat API.

Fakta penyedia (menghasilkan dengan menjaga model tetap online). Siapa pun dapat menjadi penyedia (Komunitas atau Perusahaan). Bergabung melalui Windows/Ubuntu/macOS atau Docker; berkontribusi waktu-idle ledakan atau jalankan selalu aktif; pilih insentif: Hadiah (uang), Pertukaran (token/AI Prosumer), atau Misi (sumbangkan % ke LSM). Saat Anda berkembang, tetapkan harga inferensi Anda sendiri dan dapatkan eksposur preferensial. Lihat Panduan Penyedia.

Ideal untuk. Tim produk yang menginginkan transparansi pasar, ketahanan, dan ekonomi yang selaras dengan pembangun, dengan awal yang lancar dan ruang untuk berkembang ke mode penyedia.

OpenRouter

Apa itu. API terpadu di banyak model dengan routing penyedia/model dan caching prompt. Platform dapat menjaga permintaan pada penyedia yang sama untuk menggunakan kembali cache hangat dan kembali ke yang terbaik berikutnya ketika penyedia menjadi tidak tersedia.

Fitur unggulan. Pengarahan yang bias harga dan throughput; penggunaan ulang cache di mana didukung.

Perhatian. Untuk tata kelola gateway mendalam atau pipeline SIEM, banyak tim memasangkan OpenRouter dengan Portkey atau Kong AI Gateway.

Portkey

Apa itu. Sebuah Platform operasi AI + gateway dengan dapat diprogram fallback, batas kecepatan strategi, dan cache sederhana/semantik, ditambah jejak/metrik.

Fitur unggulan. Fallback bersarang dan pengalihan bersyarat; kunci virtual dan anggaran; caching semantik yang disesuaikan untuk prompt dan pesan pendek.

Perhatian. Lebih banyak yang perlu dikonfigurasi dan dioperasikan dibandingkan dengan agregator murni.

Kong AI Gateway

Apa itu. Sebuah gerbang edge yang menambahkan plugin AI, tata kelola, dan analitik ke ekosistem Kong. Ini adalah infrastruktur—sangat baik saat Anda membutuhkan kebijakan dan audit terpusat.

Fitur unggulan. Plugin proxy AI, template rekayasa prompt, dan kontrol cloud melalui Konnect.

Perhatian. Harapkan pengaturan dan pemeliharaan; pasangkan dengan agregator jika Anda juga menginginkan tampilan pasar.

Satukan

Apa itu. A API universal dengan pengalihan berbasis data untuk memaksimalkan biaya/kecepatan/kualitas menggunakan metrik langsung; penekanan kuat pada evaluasi dan tolok ukur.

Fitur unggulan. Pengalihan dinamis dan fallback; pemilihan berbasis tolok ukur yang diperbarui berdasarkan wilayah dan beban kerja.

Perhatian. Default yang berpendapat—validasi dengan prompt Anda sendiri.

Orq.ai

Apa itu. A kolaborasi AI generatif platform: eksperimen, evaluator (termasuk RAG), deployment, RBAC/VPC.

Fitur unggulan. Pustaka evaluator dengan metrik RAG (relevansi konteks, keakuratan, recall, ketahanan).

Perhatian. Permukaan yang lebih luas daripada router “single-endpoint” minimal.

LiteLLM

Apa itu. Sebuah proxy/gateway sumber terbuka dengan endpoint yang kompatibel dengan OpenAI, anggaran/batas tingkat, logging/metrik, dan routing retry/fallback. Self-host melalui Docker/K8s/Helm.

Fitur unggulan. Anggaran & batasan tingkat per proyek/kunci API/tim; UI Admin dan pelacakan pengeluaran.

Perhatian. Anda memiliki operasi dan pembaruan (umum untuk OSS).

Quickstart: panggil model dalam hitungan menit (ShareAI)

Mulai di Taman bermain, lalu ambil kunci API dan kirimkan. Referensi: Memulai cepat API • Beranda Dokumen • Rilis.

#!/usr/bin/env bash"

// ShareAI — Chat Completions (JavaScript, Node 18+);

Perbandingan sekilas

| Platform | Dihosting / Self-host | Routing & Fallbacks | Observabilitas | Luas (LLM + lebih dari itu) | Tata Kelola/Kebijakan | Catatan |

|---|---|---|---|---|---|---|

| Eden AI | Dihosting | Beralih penyedia; batch; caching | Pemantauan API & biaya | LLM, OCR, visi, suara, terjemahan | Penagihan terpusat/manajemen kunci | BYO kunci atau kredit; Token sandbox; endpoint chat gaya OpenAI yang terpadu. |

| ShareAI | Hosted + jaringan penyedia | Failover instan; routing berbasis panduan marketplace | Log penggunaan; statistik marketplace | Katalog model yang luas | Kontrol penyedia | 70% pendapatan untuk penyedia; marketplace “People-Powered”. |

| OpenRouter | Dihosting | Routing penyedia/model; caching prompt | Info tingkat permintaan | Berpusat pada LLM | Kebijakan tingkat penyedia | Penggunaan ulang cache jika didukung; fallback pada ketidaktersediaan. |

| Portkey | Dihostkan & Gateway | Kebijakan fallback; playbook pembatasan kecepatan; cache sederhana/semantik | Jejak/metric | LLM-pertama | Konfigurasi gateway | Bagus untuk kontrol dan guardrails gaya SRE. |

| Kong AI Gateway | Self-host/Perusahaan | Routing upstream melalui plugin AI | Metrik/audit melalui Kong | LLM-pertama | Tata kelola edge yang kuat | Komponen infra; dipasangkan dengan agregator. |

| Satukan | Dihosting | Router berbasis data berdasarkan biaya/kecepatan/kualitas | Penjelajah tolok ukur | Berpusat pada LLM | Preferensi router | Pilihan dipandu oleh benchmark. |

| Orq.ai | Dihosting | Pengulangan/cadangan dalam orkestrasi | Analitik platform; evaluator RAG | LLM + RAG + evaluasi | Opsi RBAC/VPC | Kolaborasi & eksperimen. |

| LiteLLM | Self-host/OSS | Coba ulang/cadangan; anggaran/batas | Logging/metrics; UI admin | Berpusat pada LLM | Kontrol infra penuh | Endpoint kompatibel dengan OpenAI. |

FAQ

Apa itu Eden AI? (“Penjelasan Eden AI”)

Eden AI menggabungkan beberapa penyedia AI di balik API terpadu—mencakup obrolan LLM plus visi/OCR, suara, dan terjemahan—serta menambahkan alat seperti perbandingan model, pemantauan biaya/API, pemrosesan batch, dan caching.

Apakah Eden AI gratis? Apakah saya memerlukan langganan? (“Harga Eden AI / tingkat gratis”)

Eden AI menggunakan bayar sesuai penggunaan harga. Tidak ada persyaratan langganan, dan Anda dapat membawa kunci penyedia Anda sendiri atau membeli kredit. Untuk pengembangan, Kotak Pasir token mengembalikan respons dummy sehingga Anda dapat mengintegrasikan tanpa menimbulkan biaya.

Apakah Eden AI mendukung BYOK/BYOA?

Ya. Anda dapat membawa akun/kunci vendor Anda sendiri untuk penyedia yang didukung dan ditagih langsung oleh mereka, atau membayar melalui kredit Eden.

Apakah Eden AI memiliki pemrosesan batch, caching, dan pemantauan?

Ya—Pemrosesan Batch untuk pekerjaan besar, Caching API untuk permintaan berulang, dan Pemantauan Biaya/API untuk menjaga penggunaan dan pengeluaran tetap terkendali adalah bagian penting dari platform.

Eden AI vs ShareAI: mana yang lebih baik?

Pilih ShareAI jika Anda menginginkan pasar yang transparan yang menampilkan harga/latensi/waktu aktif/ketersediaan sebelum Anda mengarahkan, failover instan, dan ekonomi yang selaras dengan pembangun (70% ke penyedia). Pilih Eden AI jika peta jalan Anda membutuhkan cakupan multimodal yang luas (OCR, suara, terjemahan) di bawah satu API dengan batch/caching/pemantauan.

Eden AI vs OpenRouter: apa perbedaannya?

OpenRouter berfokus pada LLM dengan pengaturan penyedia dan caching prompt, sementara Eden AI mencakup tugas multi-modal di luar obrolan dengan perbandingan model, batch, caching, dan pemantauan. Banyak tim memasangkan router dengan gateway untuk tata kelola—atau memilih ShareAI untuk mendapatkan transparansi pasar dan pengaturan routing yang tangguh di satu tempat.

Eden AI vs Portkey vs Kong AI: router atau gateway?

Portkey dan Kong AI Gateway adalah gateway—hebat untuk kebijakan/panduan (fallback, batasan tingkat, analitik, tata kelola edge). Eden AI adalah sebuah agregator/orchestrator untuk berbagai layanan AI. Beberapa stack menggunakan keduanya: sebuah gateway untuk kebijakan tingkat organisasi dan sebuah agregator untuk pengaturan gaya pasar.

Eden AI vs LiteLLM: dihosting vs dihosting sendiri?

Eden AI di-host. LiteLLM adalah sebuah proxy/gateway sumber terbuka Anda menerapkan diri Anda dengan anggaran/batasan dan permukaan yang kompatibel dengan OpenAI. Pilih berdasarkan apakah Anda menginginkan kenyamanan yang dikelola atau kontrol infrastruktur penuh.

Apa alternatif Eden AI yang baik untuk tata kelola ketat dan isolasi VPC?

Pertimbangkan Kong AI Gateway jika Anda memerlukan tata kelola tingkat perusahaan yang dihosting sendiri di tepi jaringan. Anda juga dapat memasangkan gateway (kebijakan/pengamatan) dengan router bergaya pasar untuk pilihan model dan pengendalian biaya.

Apa alternatif Eden AI terbaik jika saya ingin self-host?

LiteLLM adalah proxy sumber terbuka populer dengan endpoint yang kompatibel dengan OpenAI, anggaran, batasan tingkat, dan pencatatan. Jika Anda sudah menjalankan Kong, Kong AI Gateway menempatkan kebijakan AI ke dalam edge Anda yang sudah ada.

Mana yang paling murah untuk beban kerja saya: Eden AI, ShareAI, OpenRouter, atau LiteLLM?

Itu tergantung pada pilihan model, wilayah, kemampuan cache, dan pola lalu lintas. Aggregator seperti ShareAI dan OpenRouter dapat mengurangi biaya melalui routing dan caching; gateway seperti Portkey menambahkan cache semantik dan buku pedoman pembatasan tingkat; LiteLLM mengurangi overhead platform jika Anda nyaman mengoperasikan proxy Anda sendiri. Benchmark dengan prompt Anda dan lacak biaya efektif per hasil—bukan hanya harga token.

Bagaimana cara saya bermigrasi dari Eden AI ke ShareAI dengan perubahan kode minimal?

Petakan model Anda ke yang setara dengan ShareAI, cerminkan bentuk permintaan/respons, dan mulai di belakang fitur flag. Arahkan persentase kecil lalu lintas terlebih dahulu, bandingkan latensi/biaya/kualitas, lalu tingkatkan. Jika Anda juga menjalankan gateway, pastikan caching/cadangan tidak memicu dua kali di antara lapisan.

Mengapa ShareAI sering menang sebagai “alternatif Eden AI”

9. penegakan kebijakan memilih penyedia yang tepat sebelum Anda mengarahkan—faktoring harga, latensi, waktu aktif, dan ketersediaan—pandangan pasar ShareAI sulit dikalahkan. Ini memasangkan pemilihan transparan dengan failover instan, kemudian menyelaraskan insentif dengan mengembalikan 70% pengeluaran kepada penyedia yang menjaga model tetap online. Bagi tim platform, kombinasi ini mengurangi kejutan, menstabilkan SLA, dan memungkinkan Anda mendapatkan sebagai penyedia ketika GPU Anda tidak digunakan (Hadiah, Token Pertukaran, atau Donasi Misi).

Langkah selanjutnya: Jelajahi Model • Buka Playground • Buat kunci API Anda • Masuk atau Daftar.