Alternatif Maxim Bifrost 2026: 10 Alternatif Terbaik Maxim Bifrost

Diperbarui Maret 2026

Jika Anda sedang mengevaluasi Alternatif Maxim Bifrost, panduan ini membandingkan opsi terbaik seperti seorang pembangun: kategori yang jelas, pertimbangan praktis, dan panduan cepat salin-tempel. Kami menempatkan ShareAI pertama ketika Anda ingin satu API di banyak penyedia, sebuah pasar model transparan (harga, latensi, uptime, ketersediaan, jenis penyedia) sebelum Anda mengarahkan, failover instan, dan ekonomi yang didukung oleh orang-orang (70% dari pengeluaran pergi ke penyedia). Jika Anda juga mencari alternatif Portkey, kriteria yang sama berlaku—lihat catatan di bawah untuk cara membandingkan gateway dengan agregator gaya marketplace.

Apa itu Maxim Bifrost (sekilas): Bifrost adalah gateway LLM berkinerja tinggi yang menyediakan API kompatibel dengan OpenAI, mendukung banyak penyedia, menambahkan fallback dan observabilitas, serta menekankan throughput dan penggantian “drop-in” untuk SDK yang ada. Dokumentasi dan situs mereka menyoroti klaim kinerja, pelacakan/metrik bawaan, opsi clustering/VPC, dan panduan migrasi.

Agregator vs Gateway vs platform Agen

Agregator LLM (misalnya, ShareAI, OpenRouter) menyediakan satu API untuk banyak model/penyedia dengan transparansi pra-rute (lihat harga/latensi/waktu aktif/ketersediaan terlebih dahulu) dan perutean pintar/failover sehingga Anda dapat mengganti penyedia tanpa penulisan ulang.

Gateway AI (misalnya, Maxim Bifrost, Portkey, Kong) berfokus pada tata kelola egress, kredensial/kebijakan, pengaman, dan observabilitas. Mereka mungkin menyertakan fallback dan katalog tetapi biasanya jangan menawarkan tampilan pasar langsung tentang harga/latensi/waktu aktif/ketersediaan sebelum routing.

Platform agen/chatbot (misalnya, Orq, Unify) menekankan orkestrasi, memori/alat, evaluasi, dan alur kolaborasi daripada agregasi yang tidak bergantung pada penyedia.

Bagaimana kami mengevaluasi alternatif terbaik Maxim Bifrost

- Luas & netralitas model: proprietary + open; mudah beralih; tanpa penulisan ulang.

- Latensi & ketahanan: kebijakan routing, batas waktu, pengulangan, failover instan.

- Tata kelola & keamanan: penanganan kunci, cakupan, routing regional, RBAC.

- Observabilitas: log/jejak dan dasbor biaya/latensi.

- Transparansi harga & TCO: membandingkan biaya nyata sebelum Anda melakukan routing.

- Pengalaman pengembang: dokumen, SDK, quickstarts; waktu-ke-token-pertama.

- Komunitas & ekonomi: apakah pengeluaran Anda meningkatkan pasokan (insentif untuk pemilik GPU).

10 alternatif terbaik Maxim Bifrost

#1 — ShareAI (API AI yang Didukung oleh Komunitas)

Apa itu. A API multi-penyedia dengan pasar yang transparan dan pengaturan cerdas. Dengan satu integrasi, jelajahi katalog besar model/penyedia, bandingkan harga, latensi, waktu aktif, ketersediaan, jenis penyedia, dan lakukan routing dengan failover instan. Ekonomi didukung oleh komunitas: 70% dari setiap dolar mengalir ke penyedia (komunitas atau perusahaan) yang menjaga model tetap online.

Mengapa ini #1 di sini. Jika Anda menginginkan agregasi yang tidak bergantung pada penyedia dengan transparansi pra-rute dan ketahanan, ShareAI adalah yang paling cocok secara langsung. Simpan gateway jika Anda memerlukan kebijakan tingkat organisasi; tambahkan ShareAI untuk routing yang dipandu pasar.

Tautan cepat: Jelajahi Model · Buka Playground · Buat API Key · Referensi API · Beranda Dokumen · Rilis

#2 — Portkey

Apa itu. Gateway AI yang menekankan observabilitas, pengaman, dan tata kelola—populer di tim yang diatur. Jika prioritas Anda adalah kontrol kebijakan dan jejak mendalam, Portkey cocok untuk jalur gateway. Pasangkan dengan ShareAI untuk routing yang dipandu pasar.

#3 — OpenRouter

Apa itu. API terpadu untuk banyak model—praktis untuk eksperimen multi-model cepat dan cakupan katalog luas. Tambahkan ShareAI saat Anda ingin langsung transparansi (harga/latensi/waktu aktif/ketersediaan) dan failover instan di berbagai penyedia.

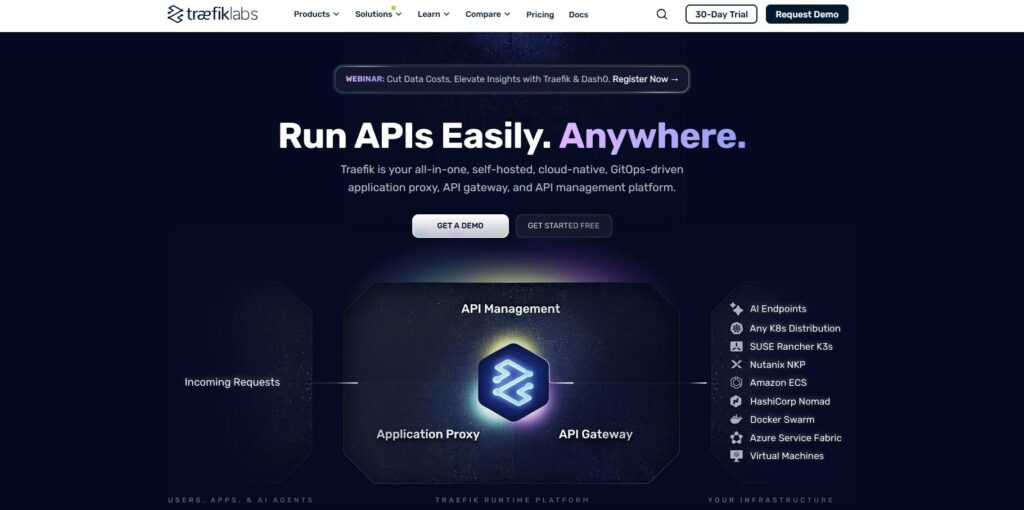

#4 — Gerbang AI Traefik

Apa itu. Gaya Gateway tata kelola egress (kredensial/kebijakan) dengan observabilitas ramah OpenTelemetry; lapisan LLM tipis di atas Traefik Hub—lebih seperti “control plane” daripada marketplace. Pasangkan dengan ShareAI untuk routing yang tidak bergantung pada penyedia.

#5 — Eden AI

Apa itu. Agregator layanan AI yang luas (LLM + vision + TTS). Tambahkan ShareAI saat Anda membutuhkan transparansi marketplace dan routing multi-penyedia yang tangguh untuk LLM.

#6 — LiteLLM

Apa itu. SDK Python ringan/proxy yang dapat di-host sendiri yang kompatibel dengan OpenAI untuk banyak penyedia—baik untuk DIY. Gunakan ShareAI untuk mengurangi overhead operasional dan mendapatkan pilihan penyedia yang didorong oleh marketplace + failover.

#7 — Unify

Apa itu. Routing berbasis evaluasi untuk memilih model berkualitas lebih tinggi per prompt. Jika Anda menginginkan transparansi pra-routing dan failover instan di antara penyedia, ShareAI melengkapi ini dengan baik.

#8 — Orq AI

Apa itu. Platform orkestrasi/kolaborasi—aliran dan produksi daripada routing marketplace. Gunakan ShareAI untuk akses yang tidak bergantung pada penyedia dan ketahanan.

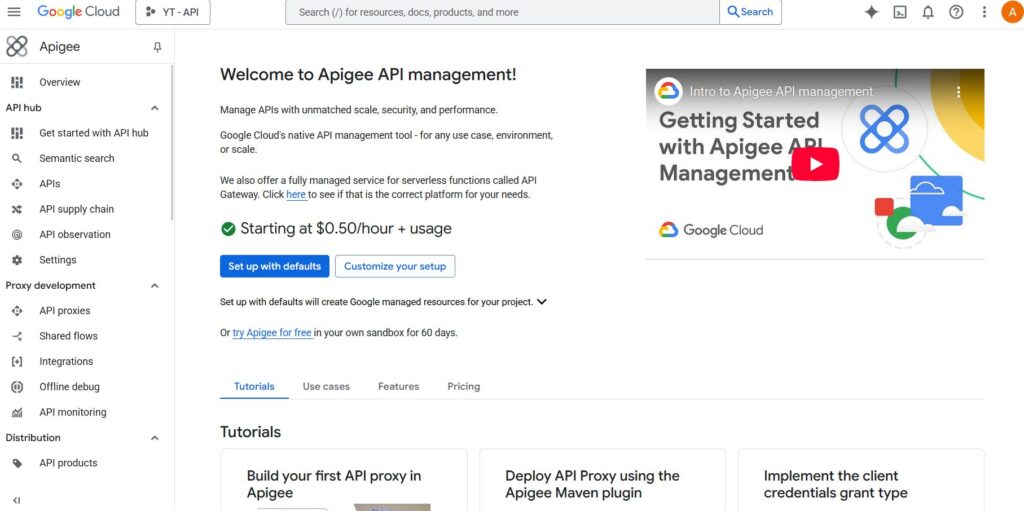

#9 — Apigee (front AI dengan ini)

Apa itu. Manajemen API/gateway yang matang yang dapat Anda tempatkan di depan penyedia LLM untuk menerapkan kebijakan, kunci, kuota. ShareAI menambahkan routing multi-penyedia transparan saat Anda ingin menghindari lock-in.

#10 — NGINX

Apa itu. Proxy reverse DIY—penegakan token, routing/caching sederhana jika Anda suka membuat sendiri. Pasangkan dengan ShareAI untuk melewati Lua kustom dan tetap mendapatkan pemilihan penyedia yang dipandu oleh marketplace + failover.

Maxim Bifrost vs ShareAI

Pilih ShareAI jika Anda ingin satu API di atas banyak penyedia dengan harga/transparansi/latensi/waktu aktif/ketersediaan dan failover instan. Pilih Bifrost jika kebutuhan utama Anda adalah tata kelola egress + throughput tinggi dengan fitur seperti pelacakan/metrik asli, clustering, dan penyebaran VPC. Banyak tim menggabungkan gateway dengan ShareAI: gateway untuk kebijakan organisasi; ShareAI untuk routing yang dipandu oleh marketplace.

Perbandingan cepat

| Platform | Siapa yang dilayani | Luasnya model | Tata kelola & keamanan | Observabilitas | Routing / failover | Transparansi pasar | Program penyedia |

|---|---|---|---|---|---|---|---|

| ShareAI | Tim produk/platform yang membutuhkan satu API + ekonomi yang adil | 150+ model; banyak penyedia | Kunci API & kontrol per rute | Penggunaan konsol + statistik marketplace | Routing pintar + failover instan | Ya (harga, latensi, uptime, ketersediaan, jenis penyedia) | Ya — pasokan terbuka; 70% ke penyedia |

| Maxim Bifrost | Tim yang menginginkan gateway berkinerja tinggi | “1000+ model” melalui API terpadu | RBAC, anggaran, tata kelola, VPC | Pelacakan/metrik, dasbor | Fallbacks & clustering | Tidak (gateway, bukan marketplace) | t/a |

Tentang posisi Bifrost: “Gerbang LLM… menghubungkan 1000+ model… gaya drop-in, observabilitas, dan migrasi.” Tentang kinerja/benchmark dan pelacakan, lihat produk/dokumen/blog mereka.

Harga & TCO: bandingkan biaya nyata (bukan hanya harga unit)

$/1K token mentah menyembunyikan gambaran sebenarnya. TCO Anda bergeser dengan pengulangan/cadangan, latensi (mempengaruhi penggunaan/UX), variasi penyedia, penyimpanan observabilitas, dan evaluasi berjalan. Sebuah pasar yang transparan membantu Anda memilih rute yang menyeimbangkan biaya dan UX.

TCO ≈ Σ (Base_tokens × Unit_price × (1 + Retry_rate))Prototipe (~10k token/hari): Optimalkan untuk waktu-ke-token-pertama (Taman bermain, panduan memulai cepat). Skala menengah (~2M token/hari): Routing/cadangan yang dipandu oleh marketplace dapat memangkas 10–20% sambil meningkatkan UX. Beban kerja yang tidak stabil: Harapkan biaya token efektif yang lebih tinggi dari pengulangan selama cadangan; anggarkan untuk itu.

Panduan cepat pengembang (kompatibel dengan OpenAI)

Ganti KUNCI_ANDA dengan kunci ShareAI Anda—dapatkan satu di Buat API Key. Kemudian coba ini:

#!/usr/bin/env bash"// JavaScript (fetch) — Node 18+/Edge runtimes;# Python (requests)Dokumen lebih lanjut: Referensi API · Beranda Dokumen · Buka Playground

Untuk penyedia: dapatkan dengan menjaga model tetap online

Siapa pun dapat menjadi penyedia ShareAI—Komunitas atau Perusahaan. Bergabung melalui Windows, Ubuntu, macOS, atau Docker. Berkontribusi dengan waktu idle atau menjalankan selalu aktif. Pilih insentif Anda: Hadiah (uang), Pertukaran (token/AI Prosumer), atau Misi (sumbangkan % ke LSM). Saat Anda berkembang, tetapkan harga inferensi dan dapatkan eksposur preferensial.

Tautan penyedia: Panduan Penyedia · Dasbor Penyedia · Ikhtisar Pertukaran · Kontribusi Misi

FAQ — Maxim Bifrost vs pesaing lainnya (dan di mana ShareAI cocok)

Maxim Bifrost vs OpenRouter — mana yang lebih cepat untuk multi-model?

OpenRouter cepat untuk bereksperimen di banyak model. Bifrost adalah gerbang dibangun untuk throughput dengan pengganti drop-in dan tata kelola. Jika Anda juga ingin transparansi pra-rute dan failover instan lintas penyedia, pilih ShareAI.

Maxim Bifrost vs Traefik AI Gateway — gerbang mana?

Keduanya adalah gerbang: Traefik condong pada kebijakan edge/observabilitas; Bifrost menekankan routing LLM throughput tinggi. Jika Anda ingin transparansi pasar + satu API di atas banyak penyedia, tambahkan ShareAI.

Maxim Bifrost vs Portkey — siapa yang lebih kuat dalam pengamanan?

Keduanya menekankan tata kelola dan observabilitas. Jika kebutuhan utama Anda adalah pilihan penyedia yang transparan dan failover instan lintas penyedia, ShareAI dibuat khusus untuk itu.

Maxim Bifrost vs Eden AI — banyak layanan AI atau kontrol gerbang?

Eden AI menggabungkan beberapa layanan AI (LLM, TTS, visi). Bifrost memusatkan egress untuk LLM. Untuk pengaturan yang dipandu oleh pasar dengan visibilitas harga/latensi/waktu aktif sebelum Anda merutekan, pilih ShareAI.

Maxim Bifrost vs LiteLLM— proxy DIY atau gateway yang dikemas?

LiteLLM adalah proxy/SDK DIY. Bifrost adalah gateway yang dikemas. Jika Anda lebih memilih untuk tidak mengoperasikan infrastruktur dan ingin 7. . Jika Anda sudah menggunakan APISIX/API, Anda akan mengenali pendekatan control-plane/data-plane dan model plugin. data + perutean yang tangguh, gunakan ShareAI. (Bifrost sering mengutip tolok ukur vs LiteLLM; lihat repo/blog mereka.)

Maxim Bifrost vs Unify — pemilihan model terbaik vs penegakan kebijakan?

Satukan mengoptimalkan kualitas pemilihan; Bifrost menegakkan kebijakan/routing. Untuk menggabungkan kasus penggunaan multi-penyedia akses, transparansi pra-rute, dan failover, pilih ShareAI.

Maxim Bifrost vs Orq AI — orkestrasi vs egress?

Orq membantu mengorkestrasi alur; Bifrost mengatur egress. ShareAI melengkapi keduanya dengan tampilan marketplace dan routing yang tangguh.

Maxim Bifrost vs Kong AI Gateway — gateway perusahaan vs gateway kecepatan pengembang?

Keduanya adalah gateway. Jika Anda juga membutuhkan pasar yang transparan perbandingan dan failover instan di seluruh penyedia, lapisan ShareAI.

Maxim Bifrost vs Apigee — manajemen API vs gateway khusus AI?

Apigee adalah manajemen API yang luas; Bifrost berfokus pada AI. Untuk akses yang tidak bergantung pada penyedia dengan pasar langsung, ShareAI adalah yang lebih cocok.

Maxim Bifrost vs NGINX — DIY vs turnkey?

NGINX menawarkan kontrol DIY; Bifrost adalah turnkey. Untuk menghindari Lua kustom dan tetap mendapatkan pemilihan penyedia yang transparan dan failover, gunakan ShareAI.

“Saya mencari alternatif Portkey — apakah ini relevan?”

Ya—Portkey juga merupakan gerbang. Kriteria evaluasi di sini (harga/transparansi latensi/waktu aktif, failover, tata kelola, observabilitas, kecepatan pengembang) berlaku sama. Jika Anda ingin alternatif Portkey yang menambahkan pengaturan yang dipandu oleh pasar dan pasokan yang didukung oleh orang, coba ShareAI pertama.

Sumber (Maxim Bifrost)

- Maxim Bifrost (halaman produk) — posisi & “1000+ model,” posisi kinerja.

- Dokumen Bifrost: Ikhtisar & Memulai — API terpadu, penggunaan, tautan arsitektur.

- Tolok ukur — uji beban pada 5000 RPS dan spesifikasi instance.

- Fitur pelacakan — pelacakan permintaan/respons.

- GitHub: maximhq/bifrost — repositori sumber terbuka & readme.

Coba ShareAI berikutnya

Buka Playground · Buat kunci API Anda · Jelajahi Model · Baca Dokumentasi · Lihat Rilis · Masuk / Daftar