Alternatif OpenRouter Terbaik 2026

Diperbarui Maret 2026

Pengembang menyukai OpenRouter karena memberikan satu API untuk ratusan model dan vendor. Tapi ini bukan satu-satunya jalur. Bergantung pada prioritas Anda—harga per token, SLA latensi, tata kelola, hosting mandiri, atau observabilitas—Anda mungkin mendapatkan kecocokan yang lebih baik dari agregator atau gateway yang berbeda.

Daftar isi

- Apa yang dilakukan OpenRouter dengan baik (dan di mana mungkin tidak cocok)

- Cara memilih alternatif OpenRouter

- Alternatif OpenRouter terbaik (pilihan cepat)

- Penjelasan mendalam: alternatif terbaik

- Panduan Cepat: panggil model dalam hitungan menit

- Perbandingan sekilas

- FAQ

Apa yang dilakukan OpenRouter dengan baik (dan di mana mungkin tidak cocok)

Apa yang dilakukannya dengan baik. OpenRouter menyatukan akses ke banyak model di balik antarmuka bergaya OpenAI. Ini mendukung perutean model (termasuk openrouter/auto meta-router) dan perutean penyedia sehingga Anda dapat memprioritaskan harga atau throughput. Ini juga menawarkan fallback dan caching prompt (jika didukung) untuk menggunakan kembali konteks hangat dan mengurangi biaya.

Di mana itu mungkin tidak cocok. Jika Anda membutuhkan observabilitas mendalam, tata kelola gateway yang ketat (kebijakan di tepi jaringan), atau jalur self-hosted, gateway atau proxy open-source mungkin lebih cocok. Jika peta jalan Anda mencakup multi-modalitas di luar teks (visi, OCR, suara, terjemahan) di bawah satu orkestrator, beberapa platform mencakup cakupan itu lebih secara alami.

Cara memilih alternatif OpenRouter

- Total biaya kepemilikan (TCO). Melampaui harga token: tingkat cache hit, kebijakan routing, kontrol throttling/kelebihan—dan apakah Anda dapat mendapatkan kembali saat perangkat keras Anda tidak aktif (keuntungan ShareAI).

- Latensi & keandalan. Routing yang sadar wilayah, pool hangat, dan perilaku cadangan (misalnya, hanya pada

429) untuk menjaga SLA tetap dapat diprediksi. - Observabilitas & tata kelola. Jejak, dasbor biaya, penanganan PII, kebijakan prompt, log audit, dan SIEM/ekspor.

- Self-host vs terkelola. Kubernetes/Helm atau gambar Docker vs layanan yang sepenuhnya di-host.

- Luas di luar obrolan. Pembuatan gambar, OCR/pemrosesan dokumen, suara, terjemahan, dan blok bangunan RAG.

- Tahan masa depan. Tidak terkunci; pergantian penyedia/model cepat; SDK stabil; ekosistem & marketplace yang sehat.

Alternatif OpenRouter terbaik (pilihan cepat)

ShareAI (pilihan kami untuk kontrol pembangun + ekonomi) — Satu API untuk 150+ model, BYOI (Bawa Infrastruktur Anda Sendiri), prioritas penyedia per-kunci (arahkan ke perangkat keras Anda terlebih dahulu), limpahan elastis ke jaringan terdesentralisasi, dan 70% dari aliran pendapatan kembali ke pemilik/penyedia GPU. Ketika GPU Anda tidak aktif, ikut serta sehingga jaringan dapat menggunakannya dan Anda mendapatkan (Tukar token atau uang nyata). Jelajahi: Model • Dokumen • Taman bermain • Buat API Key • Panduan Penyedia

Eden AI — Luas di berbagai modalitas (LLM, visi, OCR, ucapan, terjemahan) dengan bayar sesuai penggunaan kenyamanan.

Portkey — Observabilitas + pengaturan rute berbasis kebijakan (caching, batas kecepatan, fallback/load-balancing) pada lapisan gateway.

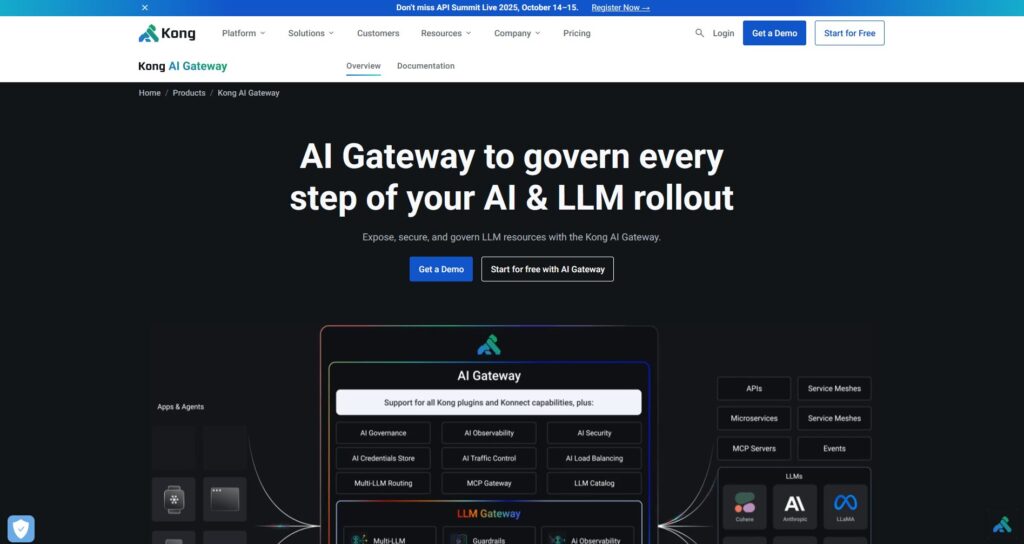

Kong AI Gateway — Tata kelola gateway sumber terbuka dengan plugin AI tanpa kode, template prompt, dan metrik/audit.

Orq.ai — Kolaborasi + LLMOps (eksperimen, evaluator, RAG, penyebaran, RBAC, opsi VPC/on-prem).

Satukan — Pengaturan rute berbasis data yang dioptimalkan untuk biaya/kecepatan/kualitas menggunakan metrik kinerja langsung.

LiteLLM — Proxy/gateway sumber terbuka: Endpoint yang kompatibel dengan OpenAI, anggaran/batasan tingkat, pencatatan/metrik, logika cadangan.

Penjelasan mendalam: alternatif terbaik

ShareAI

Apa itu

A penyedia-pertama Jaringan AI dan API terpadu. Dengan BYOI, organisasi menghubungkan infrastruktur mereka sendiri (di tempat, cloud, atau edge) dan menetapkan prioritas penyedia per kunci API—jadi lalu lintas Anda mencapai perangkat Anda terlebih dahulu. Ketika Anda membutuhkan kapasitas tambahan, jaringan terdesentralisasi ShareAI secara otomatis menangani kelebihan beban. Ketika mesin Anda diam, biarkan jaringan menggunakannya dan mendapatkan—baik Pertukaran token (untuk digunakan nanti pada inferensi Anda sendiri) atau uang nyata. Marketplace dirancang sehingga 70% dari pendapatan kembali kepada pemilik/penyedia GPU yang menjaga model tetap online.

Fitur unggulan

- BYOI + prioritas penyedia per-kunci. Pin permintaan ke infrastruktur Anda secara default untuk privasi, lokasi data, dan latensi yang dapat diprediksi.

- Tumpahan elastis. Melonjak ke jaringan terdesentralisasi tanpa perubahan kode; tangguh selama lonjakan lalu lintas.

- Hasilkan dari kapasitas diam. Monetisasi GPU saat Anda tidak menggunakannya; pilih token Exchange atau uang tunai.

- Pasar yang transparan. Bandingkan model/penyedia berdasarkan biaya, ketersediaan, latensi, dan waktu aktif.

- Awal tanpa hambatan. Uji di Taman bermain, buat kunci di Konsol, lihat Model, dan baca Dokumen. Siap untuk BYOI? Mulai dengan Panduan Penyedia.

Ideal untuk

Tim yang ingin kontrol + elastisitas—jaga lalu lintas sensitif atau kritis latensi di perangkat keras Anda, tetapi manfaatkan jaringan saat permintaan melonjak.

Perhatian

Dapatkan yang terbaik dari ShareAI dengan mengubah prioritas penyedia di mana itu penting dan memilih untuk penghasilan waktu menganggur. Biaya turun saat lalu lintas rendah, dan kapasitas meningkat saat lalu lintas melonjak.

Eden AI

Apa itu

A API terpadu untuk banyak layanan AI—tidak hanya chat LLM tetapi juga pembuatan gambar, OCR/pemrosesan dokumen, suara, dan terjemahan—dengan sebuah bayar sesuai penggunaan model.

Fitur unggulan

- Cakupan multi-modal dalam satu SDK/alur kerja; nyaman ketika peta jalan melampaui teks.

- Penagihan transparan dipetakan ke penggunaan; pilih penyedia/model yang sesuai dengan anggaran Anda.

Ideal untuk

Tim yang ingin cakupan modalitas yang luas tanpa menggabungkan banyak vendor.

Perhatian

Jika Anda membutuhkan kebijakan gateway yang terperinci (misalnya, penggantian khusus kode), gateway khusus mungkin memberi Anda lebih banyak kontrol.

Portkey

Apa itu

Platform operasi AI dengan API Universal dan dapat dikonfigurasi Gateway AI. Ini menawarkan observabilitas (jejak, biaya/latensi) dan dapat diprogram penggantian, penyeimbangan beban, caching, dan batas kecepatan strategi.

Fitur unggulan

- Buku panduan batas kecepatan dan kunci virtual untuk menjaga penggunaan tetap dapat diprediksi saat lonjakan.

- Penyeimbang beban + fallback bersarang + pengalihan bersyarat dari satu permukaan konfigurasi.

- Caching/antrian/pengulangan dapat Anda tambahkan dengan kode minimal.

Ideal untuk

Tim produk yang membutuhkan visibilitas mendalam dan pengalihan berbasis kebijakan dalam skala besar.

Perhatian

Anda memaksimalkan nilai ketika Anda memanfaatkan konfigurasi gateway permukaan dan tumpukan pemantauan.

Kong AI Gateway

Apa itu

Sebuah sumber terbuka ekstensi dari Kong Gateway 1. yang menambahkan 2. plugin AI 3. untuk 4. integrasi multi-LLM, 5. rekayasa prompt/template, 6. , keamanan konten, dan 7. metrik 8. dengan tata kelola terpusat.

Fitur unggulan

- 9. Plugin AI tanpa kode 10. dan template prompt yang dikelola secara terpusat 11. untuk tata kelola. 12. Kebijakan & metrik.

- 13. di lapisan gateway; terintegrasi dengan ekosistem Kong. 14. Tim platform yang menginginkan sebuah.

Ideal untuk

Tim platform yang menginginkan sebuah dihosting sendiri, diatur titik masuk untuk lalu lintas AI—terutama jika Anda sudah menjalankan Kong.

Perhatian

Ini adalah komponen infra—harapkan pengaturan/pemeliharaan. Pengelola agregator lebih sederhana jika Anda tidak memerlukan hosting sendiri.

Orq.ai

Apa itu

A platform kolaborasi AI generatif mencakup eksperimen, evaluator, RAG, penerapan, dan RBAC, dengan API model terpadu dan opsi perusahaan (VPC/on-prem).

Fitur unggulan

- Eksperimen untuk menguji prompt/model/pipeline dengan latensi/biaya yang dilacak per menjalankan.

- Evaluator (termasuk metrik RAG) untuk mengotomatisasi pemeriksaan kualitas dan kepatuhan.

Ideal untuk

Tim lintas fungsi yang membangun produk AI di mana kolaborasi dan ketelitian LLMOps penting.

Perhatian

Permukaan luas → lebih banyak konfigurasi dibandingkan dengan router “single-endpoint” minimal.

Satukan

Apa itu

A API terpadu ditambah dengan router dinamis yang dioptimalkan untuk kualitas, kecepatan, atau biaya menggunakan metrik langsung dan preferensi yang dapat dikonfigurasi.

Fitur unggulan

- Pengaturan rute berbasis data dan fallback yang menyesuaikan saat kinerja penyedia berubah.

- Penjelajah tolok ukur dengan hasil end-to-end berdasarkan wilayah dan beban kerja.

Ideal untuk

Tim yang ingin penyetelan kinerja tanpa intervensi dengan telemetri waktu nyata.

Perhatian

Perutean berbasis tolok ukur bergantung pada kualitas data; validasi dengan prompt Anda sendiri.

LiteLLM

Apa itu

Sebuah proxy/gateway sumber terbuka dengan endpoint yang kompatibel dengan OpenAI, anggaran, batasan tingkat, pelacakan pengeluaran, pencatatan/metrik, dan pengulangan/cadangan perutean—dapat diterapkan melalui Docker/K8s/Helm.

Fitur unggulan

- Hosting mandiri dengan gambar Docker resmi; hubungkan 100+ penyedia.

- Anggaran & batasan tingkat per proyek/kunci API/model; antarmuka gaya OpenAI mempermudah migrasi.

Ideal untuk

Tim yang membutuhkan kontrol penuh dan ergonomi kompatibel dengan OpenAI—tanpa lapisan kepemilikan.

Perhatian

Anda akan memiliki operasi (pemantauan, pembaruan, rotasi kunci), meskipun antarmuka admin/UI dokumen membantu.

Panduan Cepat: panggil model dalam hitungan menit

# cURL"// JavaScript (fetch);Tip: Buat/rotasi kunci di Konsol → Kunci API.

Perbandingan sekilas

| Platform | Dihosting / Self-host | Routing & Fallbacks | Observabilitas | Luas (LLM + lebih dari itu) | Tata Kelola/Kebijakan | Catatan |

|---|---|---|---|---|---|---|

| OpenRouter | Dihosting | Auto-router; routing penyedia/model; fallbacks; caching prompt | Info permintaan dasar | Berpusat pada LLM | Kebijakan tingkat penyedia | Akses satu endpoint yang hebat; bukan self-host. |

| ShareAI | Dihosting + BYOI | Prioritas penyedia per-kunci (infrastruktur Anda terlebih dahulu); limpahan elastis ke jaringan terdesentralisasi | Log penggunaan; telemetri marketplace (waktu aktif/latensi per penyedia) | Katalog model yang luas | Marketplace + kontrol BYOI | 70% pendapatan untuk pemilik/penyedia GPU; dapatkan melalui Pertukaran token atau uang tunai. |

| Eden AI | Dihosting | Beralih penyedia dalam API terpadu | Visibilitas penggunaan/biaya | LLM, OCR, visi, suara, terjemahan | Penagihan terpusat/manajemen kunci | Multi-modal + bayar sesuai penggunaan. |

| Portkey | Dihostkan & Gateway | Fallback/load-balancing berbasis kebijakan; caching; buku pedoman batas kecepatan | Jejak/metric | LLM-pertama | Konfigurasi tingkat gateway | Kontrol mendalam + operasi gaya SRE. |

| Kong AI Gateway | Self-host/OSS (+Enterprise) | Routing upstream melalui plugin; cache | Metrik/audit melalui ekosistem Kong | LLM-pertama | Plugin AI tanpa kode; tata kelola template | Ideal untuk tim platform & kepatuhan. |

| Orq.ai | Dihosting | Pengulangan/cadangan; versi | Jejak/dashboard; evaluator RAG | LLM + RAG + evaluator | Selaras dengan SOC; RBAC; VPC/on-prem | Kolaborasi + suite LLMOps. |

| Satukan | Dihosting | Routing dinamis berdasarkan biaya/kecepatan/kualitas | Penjelajah benchmark langsung | Berpusat pada LLM | Preferensi router per kasus penggunaan | Penyesuaian kinerja secara real-time. |

| LiteLLM | Self-host/OSS | Pengulangan/routing fallback; anggaran/batas | Logging/metrics; UI admin | Berpusat pada LLM | Kontrol infra penuh | Endpoint kompatibel dengan OpenAI. |

FAQ

ShareAI vs OpenRouter: mana yang lebih murah untuk beban kerja saya?

Itu tergantung pada model, wilayah, dan kemampuan cache. OpenRouter mengurangi pengeluaran dengan routing penyedia/model dan caching prompt (jika didukung). ShareAI menambahkan BYOI untuk menjaga lebih banyak lalu lintas pada perangkat keras Anda (mengurangi egress/latensi) dan menggunakan jaringan terdesentralisasi hanya untuk kelebihan beban—sehingga Anda menghindari overprovisioning. Anda juga dapat mendapatkan saat GPU tidak digunakan (Tukar token atau uang tunai), mengimbangi biaya.

Bisakah saya memaksa lalu lintas ke infrastruktur saya sendiri terlebih dahulu dengan ShareAI?

Ya—atur prioritas penyedia per kunci API sehingga permintaan mengenai perangkat Anda terlebih dahulu. Ketika Anda jenuh, limpahan secara otomatis masuk ke jaringan ShareAI, tanpa perubahan kode.

Apakah ShareAI mengunci saya?

Tidak. BYOI berarti infrastruktur Anda tetap milik Anda. Anda mengontrol di mana lalu lintas mendarat dan kapan harus meledak ke jaringan.

Bagaimana cara pembayaran bekerja jika saya berbagi kapasitas yang tidak terpakai?

Aktifkan mode penyedia dan ikut serta dalam insentif. Anda dapat menerima Pertukaran token (untuk digunakan nanti pada inferensi Anda sendiri) atau uang nyata. Marketplace dirancang sehingga 70% dari pendapatan kembali kepada pemilik/penyedia GPU yang menjaga model tetap online.

OpenRouter vs ShareAI untuk latensi dan keandalan?

Routing/fallback OpenRouter membantu menjaga throughput. ShareAI menambahkan sebuah mode “lebih suka infrastruktur saya” per kunci” untuk lokalitas dan latensi yang dapat diprediksi, lalu meledak ke jaringan saat diperlukan—berguna untuk lalu lintas yang melonjak dan SLA yang ketat.

Bisakah saya menumpuk gateway dengan agregator?

Ya. Banyak tim menjalankan gerbang (misalnya, Portkey atau Kong) untuk kebijakan/pengamatan dan memanggil endpoint agregator di belakangnya. Dokumentasikan di mana caching/fallback terjadi untuk menghindari double-caching atau konflik pengulangan.

Apakah OpenRouter mendukung caching prompt?

Ya—OpenRouter mendukung caching prompt pada model yang kompatibel dan mencoba menggunakan kembali cache yang hangat; ini akan kembali ke default jika penyedia menjadi tidak tersedia.