APIParkの代替案2026: トップ10のAPIPark代替案

更新日 2026年3月

あなたが探している場合 APIParkの代替案, 、このガイドはビルダーの視点からその状況を分解します。APIPark(AIゲートウェイ)がどこに位置するかを明確にします—AIトラフィックの出口/ガバナンス層—その後、比較します 10 の最良の代替案. を配置します シェアAI チームが望む場合に最初に 多くのプロバイダーにわたる1つのAPI, 、 透明なマーケットプレイス (価格、遅延、稼働時間、可用性、プロバイダータイプ 前に ルーティング)、, 即時フェイルオーバー, 、そして 人々による経済学 (支出の70%はモデルをオンラインに保つプロバイダーに向けられます)。.

クイックリンク

APIParkとは何か(そして何ではないか)

それが何であるか。. APIParkは AIゲートウェイ/制御層として位置付けられています:キーを集中管理し、ポリシー/ガードレールを適用し、API表面としてAIトラフィックを観察する場所です。それは、既に使用しているプロバイダー間で 管理する AI出口を管理したいチームに役立ちます。.

何でないか。. APIParkは 核となる仕事ではない ルーティングする前に多くのプロバイダーにわたる透明なモデルマーケットプレイスを提供します。優先事項が 価格/遅延/稼働時間/可用性 である場合 プロバイダーに依存しない選択 と 耐障害性のあるマルチプロバイダールーティング, 、ゲートウェイをマーケットプレイスAPIと組み合わせるか、ガバナンスの必要性が最小限であればゲートウェイを置き換える可能性があります。.

アグリゲーター vs ゲートウェイ vs エージェントプラットフォーム

- LLMアグリゲーター(マーケットプレイス): 多くのモデル/プロバイダーにわたる1つのAPI 事前ルートの透明性 と スマートルーティング/フェイルオーバー. 。例: シェアAI (マルチプロバイダー、マーケットプレイスビュー)。.

- AIゲートウェイ: エッジでのポリシー/ガバナンス(キー、レート制限、ガードレール)と可観測性。 プロバイダーを持ち込むことができます. 。例:APIPark、Kong AI Gateway、Traefik、Apache APISIX(AIバックエンド付き)。.

- エージェント/チャットボットプラットフォーム: パッケージ化されたUX、メモリ/ツール、チャネル—プロバイダーに依存しないアグリゲーションではなく、エンドユーザーアシスタント向け。例:Orq(オーケストレーション優先)。.

最適なAPIPark代替案を評価する方法

- モデルの幅広さと中立性: 独自 + オープン; 簡単な切り替え; 再書き込み不要。.

- レイテンシーとレジリエンス: ルーティングポリシー、タイムアウト、リトライ、, 即時フェイルオーバー.

- ガバナンスとセキュリティ: キーの取り扱い、スコープ、地域ルーティング、ガードレール。.

- 可観測性: ログ/トレース + コスト/遅延ダッシュボード。.

- 価格の透明性とTCO: 比較する 実際の コスト 前に ルート設定を行う。.

- 開発者体験: ドキュメント、SDK、クイックスタート;初回トークンまでの時間。.

- コミュニティと経済: 支出が供給(GPU所有者/プロバイダーへのインセンティブ)を増やすかどうか。.

トップ10のAPIPark代替案

#1 — ShareAI(人々が支えるAI API)

それが何であるか。. A マルチプロバイダーAPI と 透明なマーケットプレイス と スマートルーティング. 1つの統合で、モデルとプロバイダーの大規模なカタログを閲覧し、比較 価格、遅延、稼働時間、可用性、プロバイダータイプ, 、そしてルート設定を行う 即時フェイルオーバー. 経済は人々によって支えられています: 70%のすべてのドルがプロバイダーに流れる (コミュニティまたは企業)モデルをオンラインで維持する人々へ。.

なぜここが#1なのか。. もしあなたが望むなら プロバイダーに依存しない集約 と 事前ルートの透明性 と 耐障害性, 、ShareAIが最も直接的に適合します。組織全体のポリシーが必要な場合はゲートウェイを維持し、マーケットプレイス主導のルーティングにはShareAIを追加してください。.

- 一つのAPI → 150以上のモデル 多くのプロバイダーにわたって; 書き換えなし、ロックインなし.

- 透明なマーケットプレイス: 選択基準 価格、遅延、稼働時間、可用性、プロバイダータイプ.

- デフォルトでの回復力: ルーティングポリシー + 即時フェイルオーバー.

- 公正な経済: 70% 支出の一部はプロバイダー(コミュニティまたは企業)に渡ります。.

- クイックリンク — モデルを閲覧 · プレイグラウンドを開く · APIキーを作成 · APIリファレンス · ドキュメント · リリース

プロバイダー向け:モデルをオンラインに保つことで収益を得る

誰でもShareAIプロバイダーになることができる—コミュニティ または 企業. 。オンボードする方法 Windows、Ubuntu、macOS、またはDocker. 。貢献する アイドルタイムバースト または実行 常時オン. 。インセンティブを選択してください: 報酬 (お金)、, 交換 (トークン/AIプロシューマー)、または ミッション (%をNGOに寄付)。スケールするにつれて、 独自の推論価格を設定できます そして得る 市場での優先的な露出.

#2 — OpenRouter

それが何であるか。. 多くのモデルにわたる統一API;広範なカタログでの迅速な実験に最適。.

それが輝く場所: 開発者向けの迅速なマルチモデルアクセス; 簡単な交換。.

ShareAIとのトレードオフ: マーケットプレイスの透明性とルーティング/フェイルオーバーの深さは異なる; ShareAIは追加 事前ルートの価格/遅延/稼働時間 と 即時フェイルオーバー.

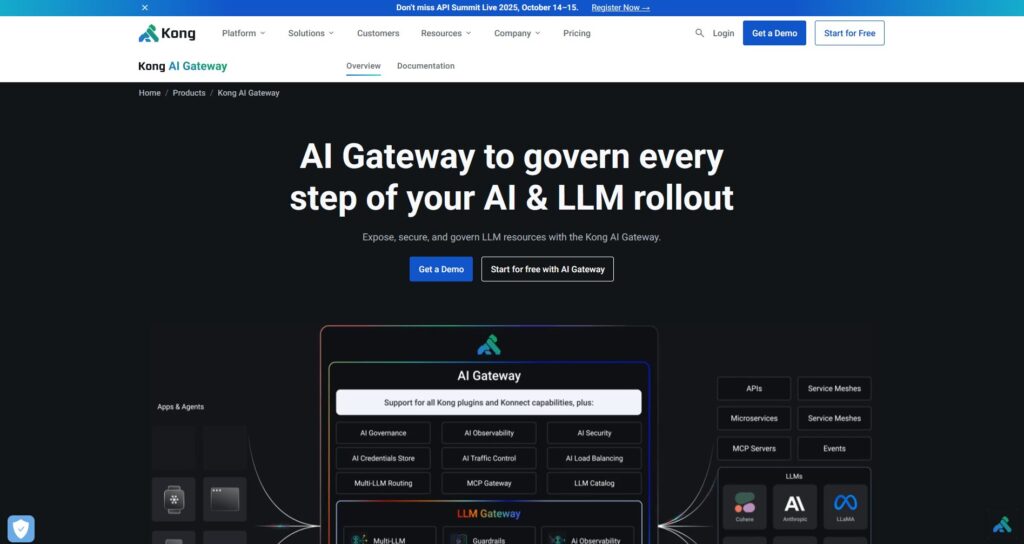

#3 — Kong AIゲートウェイ

それが何であるか。. エンタープライズAI/LLMゲートウェイ—ガバナンス、ポリシー/プラグイン、分析、エッジでのAIトラフィックの可観測性。.

それが輝く場所: 強力なゲートウェイレベルの制御を必要とする組織。.

ShareAIとのトレードオフ: Kongはコントロールプレーンです; それはマーケットプレイスではありません.

#4 — ポートキー

それが何であるか。. 可観測性、ガードレール、ガバナンスを強調したAIゲートウェイ—規制産業で人気があります。.

それが輝く場所: コンプライアンス/ガードレール、深いトレース。.

ShareAIとのトレードオフ: ガバナンス優先 vs プロバイダーに依存しないルーティングと透明性.

#5 — エデンAI

それが何であるか。. LLMとより広範なAI(画像、翻訳、TTS)を集約し、フォールバック、キャッシング、バッチ処理を提供。.

それが輝く場所: LLMを超えた多機能ワークロード。.

ShareAIとのトレードオフ: 幅広いカタログ vs マーケットプレイス統計 と フェイルオーバー 深さ。.

#6 — ライトLLM

それが何であるか。. 軽量なPython SDK + 多くのプロバイダーに対応するOpenAI互換インターフェースを持つセルフホスト可能なプロキシ。.

それが輝く場所: DIYコントロール、セルフホスティング。.

ShareAIとのトレードオフ: プロキシを運用/スケールするのはあなた; ShareAIは 管理された と 即時フェイルオーバー と 使用ケース.

#7 — ユニファイ

それが何であるか。. プロンプトごとにより良いモデルを選択するための品質指向のルーティングと評価。.

それが輝く場所: 評価駆動型の選択。.

ShareAIとのトレードオフ: 評価重視 vs マーケットプレイス + プロバイダー選択 そして回復力。.

#8 — Orq AI

それが何であるか。. 実験から本番環境への移行を低コードフローで実現するオーケストレーション/コラボレーションプラットフォーム。.

それが輝く場所: ワークフローオーケストレーション。.

ShareAIとのトレードオフ: オーケストレーション vs マルチプロバイダーマーケットプレイスルーティング.

#9 — Apigee(その背後にLLMを搭載)

それが何であるか。. LLMプロバイダーの前に配置してポリシー、キー、クォータを適用できる成熟したAPI管理/ゲートウェイ.

それが輝く場所: エンタープライズAPI管理の幅広さ.

ShareAIとのトレードオフ: ガバナンスの幅広さ vs モデル/プロバイダーの透明性.

#10 — Apache APISIX

それが何であるか。. プラグイン、レート制限、ルーティング、観測性を備えたオープンソースゲートウェイでAIバックエンドを前面に配置可能.

それが輝く場所: オープンソースの柔軟性とプラグインエコシステム.

ShareAIとのトレードオフ: DIYゲートウェイエンジニアリング vs ターンキーのマーケットプレイス + フェイルオーバー.

APIPark vs ShareAI: どちらを選ぶべきか?

- 選択する シェアAI 必要な場合 多くのプロバイダーにわたる1つのAPI と 透明な価格設定/レイテンシー/稼働時間/可用性 と 即時フェイルオーバー.

- 選択する APIPark あなたの 最優先事項が出口ガバナンスである場合—集中管理された資格情報、ポリシーの適用、エッジでの観測性.

- 多くのチームが実行します 両方: 組織ポリシーのゲートウェイ + シェアAI 用の マーケットプレイス主導のルーティング.

クイック比較(一目で)

| プラットフォーム | 対象者 | モデルの幅広さ | ガバナンスとセキュリティ | 可観測性 | ルーティング / フェイルオーバー | マーケットプレイスの透明性 | プロバイダープログラム |

|---|---|---|---|---|---|---|---|

| シェアAI | 1つのAPI + 公正な経済性を必要とする製品/プラットフォームチーム | 150以上のモデル、多くのプロバイダー | APIキー & ルートごとのコントロール | コンソール使用 + マーケットプレイス統計 | スマートルーティング + 即時フェイルオーバー | はい (価格、遅延、稼働時間、可用性、プロバイダータイプ) | はい — オープンサプライ; 70% プロバイダーへ |

| APIPark | 出口ガバナンスを求めるチーム | BYOプロバイダー | 集中管理された資格情報/ポリシー | メトリクス/トレーシング | ポリシーによる条件付きルーティング | いいえ(インフラツールであり、マーケットプレイスではありません)。 | 該当なし |

| コングAIゲートウェイ | ゲートウェイレベルのポリシーを必要とする企業 | 持ち込み可 | 強力なエッジポリシー/プラグイン | 分析 | プロキシ/プラグイン、リトライ | いいえ(インフラ) | 該当なし |

| ポートキー | 規制/企業チーム | 広範囲 | ガードレールとガバナンス | 深いトレース | 条件付きルーティング | 部分的 | 該当なし |

| オープンルーター | マルチモデルアクセスを望む開発者 | 幅広いカタログ | 基本的なAPIコントロール | アプリ側 | フォールバック | 部分的 | 該当なし |

| エデンAI | LLM + 他のAIサービスを必要とするチーム | 広範囲 | 標準的なコントロール | 変動する | フォールバック/キャッシング | 部分的 | 該当なし |

| LiteLLM | DIY/セルフホストプロキシ | 多くのプロバイダー | 設定/キーの制限 | あなたのインフラ | 再試行/フォールバック | 該当なし | 該当なし |

| 統一 | 品質重視のチーム | マルチモデル | 標準APIセキュリティ | プラットフォーム分析 | 最適モデル選択 | 該当なし | 該当なし |

| Orq | オーケストレーション優先のチーム | 幅広いサポート | プラットフォーム制御 | プラットフォーム分析 | オーケストレーションフロー | 該当なし | 該当なし |

| アピジー | 企業 / API管理 | 持ち込み可 | ポリシー | アドオン | カスタム | 該当なし | 該当なし |

| アパッチAPISIX | オープンソース / DIY | 持ち込み可 | ポリシー / プラグイン | Prometheus / Grafana | カスタム | 該当なし | 該当なし |

ヒント: 組織ポリシーのためのゲートウェイを保持している場合でも リクエストごとにルートを設定できます ShareAIを介してマーケットプレイスデータ(価格、遅延、稼働時間、可用性、プロバイダータイプ)を使用して 最適なプロバイダーとフェイルオーバーターゲットを選択する.

価格とTCO: 実際のコストを比較(単価だけではありません)

生の $/1K トークン 実際の状況を隠します。TCOは変化します リトライ/フォールバック, レイテンシー (使用に影響を与える)、, プロバイダーのばらつき, 可観測性ストレージ, 、そして 評価実行. 。A 透明なマーケットプレイス コストとUXのバランスを取るルート選択を支援します。.

TCO ≈ Σ (Base_tokens × Unit_price × (1 + Retry_rate)) + Observability_storage + Evaluation_tokens + Egress

- プロトタイプ(約10kトークン/日): 最初のトークンまでの時間を最適化する(Playground、クイックスタート)。.

- 中規模(約2Mトークン/日): Marketplace-guided routing/failoverは削減できます 10–20% UX を改善しながら。.

- スパイク型ワークロード: フェイルオーバー中のリトライによる効果的なトークンコストの増加を予期してください。; そのための予算を確保する.

移行ガイド

APIPark → ShareAI(補完または置換)

ゲートウェイレベルのポリシーを活用しつつ、ShareAI を追加して マーケットプレイスルーティング + 即時フェイルオーバー. 一般的なパターン: ゲートウェイ認証/ポリシー → ShareAI モデルごとのルート → マーケットプレース統計を測定 → ポリシーを強化.

OpenRouterから

モデル名をマッピングし、プロンプトの均等性を確認してから シャドウ10% トラフィックとランプ 25% → 50% → 100% レイテンシー/エラーバジェットが維持される限り。マーケットプレイスデータは プロバイダーの切り替えを簡単にします。.

LiteLLMから

置き換える 自己ホスト型プロキシ 本番ルートでは操作したくない場合; 必要に応じて開発用にLiteLLMを保持。比較 運用オーバーヘッド 対 管理されたルーティングの利点.

Unify / Portkey / Orq / Kong / APISIX / Apigee から

定義する 機能の均等性に関する期待 (分析、ガードレール、オーケストレーション、プラグイン)。多くのチームが実行しています ハイブリッド: 専門的な機能を最も強力な場所に保持; ShareAIを使用して 透明なプロバイダー選択とフェイルオーバー.

開発者クイックスタート(コピー&ペースト)

以下を使用します OpenAI互換 サーフェスを使用します。置き換えてください YOUR_KEY あなたのShareAIキーに—取得する場所は APIキーを作成.

#!/usr/bin/env bash"

// JavaScript (fetch) — Node 18+/Edge ランタイム;

セキュリティ、プライバシー & コンプライアンスチェックリスト(ベンダー非依存)

- キーの取り扱い: 回転頻度; 最小スコープ; 環境分離。.

- データ保持: プロンプト/レスポンスが保存される場所と期間; 編集のデフォルト設定。.

- PIIおよび機密コンテンツ: マスキング;アクセス制御;; 地域ルーティング データローカリティのために。.

- 可観測性: プロンプト/レスポンスのログ記録; フィルタリングまたは仮名化の能力; 伝播 トレースID 一貫して。.

- インシデント対応: エスカレーションパスと プロバイダーSLA.

FAQ — APIPark 対 他の競合他社 (および ShareAI の位置付け)

APIPark 対 ShareAI — マルチプロバイダーのルーティングにはどちらが適しているか?

ShareAI。. それは構築されています 使用ケース (価格、遅延、稼働時間、可用性、プロバイダータイプ)と スマートルーティング/フェイルオーバー 多くのプロバイダーにわたって。APIParkは 出力ガバナンスである場合 (集中化された認証情報/ポリシー; 可観測性)。多くのチームが両方を使用。.

APIPark 対 OpenRouter — クイックなマルチモデルアクセスまたはガバナンス?

OpenRouterはマルチモデルアクセスを迅速に行い、APIParkはポリシーと可観測性を集中化します。また、もし 事前ルートの透明性 と 即時フェイルオーバー, 、ShareAIは組み合わせます マルチプロバイダーアクセス と マーケットプレイスビューを提供します と 耐障害性のあるルーティング.

APIPark 対 Kong AI Gateway — ゲートウェイ対マーケットプレース?

APIParkとKongの両方が ゲートウェイです (ポリシー、プラグイン、分析)、マーケットプレイスではありません。ゲートウェイを組み合わせて シェアAI 透明性のために マルチプロバイダールーティング と フェイルオーバー.

APIPark対Portkey — ガードレールでどちらが強い?

両者ともガバナンス/可観測性を重視していますが、深さと使いやすさが異なります。主なニーズが 透明なプロバイダー選択を行います。 と フェイルオーバー, 、追加する シェアAI どちらのゲートウェイとも併用可能です。.

APIPark対Apache APISIX — オープンソースDIYか管理されたコントロールか?

APISIXはプラグインが豊富なオープンソースゲートウェイコントロールを提供し、APIParkは管理されたガバナンスを提供します。DIYの複雑さを避けつつ、 透明なプロバイダー選択を得るために, 、レイヤーを追加してください シェアAI.

APIPark対Traefik — 2つのゲートウェイ、異なるエコシステム

両方ともポリシーと可観測性でAIの出口を管理します。もしあなたが 多くのプロバイダーにわたる1つのAPI ライブで マーケットプレイス統計, シェアAI どちらにも補完的です。.

APIPark対NGINX — DIYフィルター対ターンキーAIレイヤー

NGINXはDIYフィルター/ポリシーを提供し、APIParkはパッケージ化されたレイヤーを提供します。 カスタムスクリプトを省略して それでも得られる 透明なプロバイダー選択を行います。, の場合、使用してください シェアAI.

APIPark対Apigee — 幅広いAPI管理対AI特化の出口

Apigeeは幅広いAPI管理を提供し、APIParkはAIに特化した出口ガバナンスを提供します。 プロバイダーに依存しないアクセス と 使用ケース, を選択し、 シェアAI.

APIPark vs LiteLLM — セルフホストプロキシまたは管理されたガバナンス?

LiteLLMはDIYプロキシであり、APIParkは管理されたガバナンス/可観測性です。プロキシを運用したくない場合や、 マーケットプレイス駆動のルーティングを希望する場合, を選択し、 シェアAI.

APIPark vs Unify — ベストモデル評価 vs ポリシー施行?

Unifyは評価主導のモデル選択に焦点を当て、APIParkはポリシー/可観測性に焦点を当てています。 多くのプロバイダーにわたる1つのAPI と ライブマーケットプレース統計, の場合、使用してください シェアAI.

APIPark vs Eden AI — 多くのAIサービスまたは出口制御?

Eden AIは複数のAIサービス(LLM、画像、TTS)を統合します。APIParkはポリシー/資格情報を専門的なAIミドルウェアで集中管理します。 プロバイダー間での透明な価格設定/レイテンシー と 即時フェイルオーバー, を選択し、 シェアAI.

OpenRouter vs Apache APISIX — アグリゲーター vs オープンソースゲートウェイ

OpenRouterは モデルアクセスを簡素化します; 。APISIXは ゲートウェイ制御を提供します. 。追加 シェアAI 必要な場合 事前ルートの透明性 と フェイルオーバー 自分のゲートウェイを運用せずにプロバイダー間で。.

次にShareAIを試してください

- プレイグラウンドを開く — 数分で任意のモデルにライブリクエストを実行

- APIキーを作成する

- モデルを閲覧

- ドキュメントを読む

- リリースを見る

- サインイン / サインアップ