Orq AI Proxy 대안 2026: 상위 10개

업데이트됨 2026년 3월

연구 중이라면 Orq AI Proxy 대안, 이 가이드는 건축가가 풍경을 그리는 방식으로 지도를 작성합니다. 우리는 Orq가 어디에 적합한지 빠르게 정의할 것입니다(협업 흐름을 통해 실험에서 프로덕션으로 이동하도록 돕는 오케스트레이션 우선 프록시), 그런 다음 비교합니다. 10가지 최고의 대안 집계, 게이트웨이 및 오케스트레이션 전반에 걸쳐. 우리는 공유AI 팀이 원하는 경우 첫 번째 여러 제공업체에 걸친 하나의 API, 투명한 마켓플레이스 신호(가격, 지연 시간, 가동 시간, 가용성, 제공자 유형)를 라우팅 전에 배치합니다., 즉각적인 장애 조치, 그리고 사람 중심 경제학 (제공자—커뮤니티 또는 회사—는 모델을 온라인 상태로 유지할 때 지출의 대부분을 얻습니다).

Orq AI Proxy란 무엇인가 (그리고 무엇이 아닌가)

Orq AI 프록시 는 오케스트레이션 우선 플랫폼에 위치합니다. 이는 협업, 흐름, 그리고 프로토타입을 프로덕션으로 가져가는 것을 강조합니다.. 여기에는 다단계 작업을 조정하기 위한 도구, 실행에 대한 분석, 팀이 작업을 간소화하는 프록시가 포함됩니다. 이는 투명한 모델 마켓플레이스: 사전 라우트 가시성 가격/지연시간/가동시간/가용성 전반적으로 여러 제공업체—추가로 스마트 라우팅 및 즉각적인 장애 조치—와 같은 다중 제공자 API와는 다릅니다. 공유AI 빛납니다.

간단히 말해서:

- 오케스트레이션 우선 (Orq): 워크플로를 배포하고, 실행을 관리하며, 협업—핵심 요구가 흐름 도구라면 유용합니다.

- 마켓플레이스 우선 (ShareAI): 선택 최적의 제공자/모델 와 함께 실시간 신호 그리고 자동 복원력—핵심 요구가 있다면 유용합니다. 제공자 간 라우팅 잠금 없이.

집계자 vs. 게이트웨이 vs. 오케스트레이션 플랫폼

LLM 집계자 (예: ShareAI, OpenRouter, Eden AI): 여러 제공자/모델을 아우르는 하나의 API. ShareAI를 사용하면 라우팅 전에 가격, 지연 시간, 가동 시간, 가용성, 제공자 유형을 비교할 수 있습니다., 그 다음 즉시 장애 조치 공급자가 저하되는 경우.

AI 게이트웨이 (예: Kong, Portkey, Traefik, Apigee, NGINX): 정책/거버넌스 엣지에서 (중앙화된 자격 증명, WAF/속도 제한/가드레일), 추가로 관찰 가능성. 일반적으로 자체 공급자를 가져옵니다.

오케스트레이션 플랫폼 (예: Orq, Unify; LiteLLM이 자체 호스팅 프록시 버전인 경우): 초점은 플로우, 도구, 그리고 때로는 품질 선택—팀이 프롬프트, 도구 및 평가를 구조화하도록 돕습니다.

도움이 될 때 함께 사용하세요: 많은 팀이 조직 전체 정책을 위한 게이트웨이를 유지합니다 동시에 ShareAI를 통한 라우팅 시장의 투명성과 회복력을 위해.

최고의 Orq AI Proxy 대안을 평가한 방법

- 모델 범위 및 중립성: 독점적 + 개방적; 쉽게 전환 가능; 최소한의 재작성.

- 지연 시간 및 복원력: 라우팅 정책, 시간 초과/재시도, 즉각적인 장애 조치.

- 거버넌스 및 보안: 키 처리, 범위, 지역 라우팅.

- 관찰 가능성: 로그/추적 및 비용/지연 대시보드.

- 가격 투명성 및 TCO: 보기 실제 비용/UX 절충 라우팅 전에 비교하세요.

- 개발자 경험: 문서, SDK, 빠른 시작; 첫 번째 토큰까지의 시간.

- 커뮤니티 및 경제: 지출이 공급을 증가시키나요 (GPU 소유자/제공자를 위한 인센티브)?

상위 10개의 Orq AI Proxy 대안

#1 — ShareAI (사람이 주도하는 AI API)

그것이 무엇인지. A 다중 제공자 API 와 함께 투명한 마켓플레이스 그리고 스마트 라우팅. 하나의 통합으로, 모델과 제공자의 대규모 카탈로그를 탐색, 비교, 가격, 지연 시간, 가동 시간, 가용성, 제공자 유형, 그리고 즉각적인 장애 조치로 라우팅. 경제는 사람 중심입니다: 제공자(커뮤니티 또는 회사)가 지출의 대부분을 벌어들임 모델을 온라인 상태로 유지할 때.

왜 그것이 여기에서 #1인지. 원한다면 제공자에 구애받지 않는 집계 와 함께 사전 경로 투명성 그리고 복원력, ShareAI는 가장 직접적인 적합성입니다. 조직 전체 정책이 필요하다면 게이트웨이를 유지하고 추가하십시오. 공유AI 마켓플레이스 기반 라우팅과 더 나은 가동 시간/지연 시간.

- 하나의 API → 여러 제공업체의 150개 이상의 모델; 재작성 없음, 고착화 없음.

- 투명한 마켓플레이스: 선택 기준 가격, 지연 시간, 가동 시간, 가용성, 제공자 유형.

- 기본 복원력: 라우팅 정책 + 즉각적인 장애 조치.

- 공정한 경제: 사람 중심—제공업체가 수익을 얻습니다. 모델을 사용할 수 있게 유지할 때.

빠른 링크:

제공업체를 위해: 모델을 온라인 상태로 유지하여 수익 창출

누구나 ShareAI 제공업체가 될 수 있습니다—커뮤니티 또는 회사. 온보드 방법 Windows, Ubuntu, macOS 또는 Docker. 기여 유휴 시간 폭발 또는 실행 항상 켜짐. 인센티브를 선택하세요: 1. 보상 (돈), 교환 (토큰/AI Prosumer), 또는 5. 미션 (NGO에 % 기부). 확장하면서, 자체 추론 가격을 설정할 수 있습니다 11. 그리고 얻을 수 있습니다 12. 시장에서의 우선 노출.

#2 — OpenRouter

그것이 무엇인지. A 통합 API 여러 모델에 걸쳐; 광범위한 카탈로그에서 빠른 실험에 적합합니다.

선택 시기. 최소한의 설정으로 다양한 모델에 빠르게 액세스하고 싶다면.

ShareAI와 비교. ShareAI는 추가합니다. 사전 라우트 마켓플레이스 투명성. 그리고 즉각적인 장애 조치 여러 제공자에 걸쳐.

#3 — 포트키

그것이 무엇인지. 오픈 소스 AI 게이트웨이 9. 강조하며 관측 가능성, 가드레일 및 거버넌스.

선택 시기. 심층적인 정책/안전장치 제어가 필요한 규제 환경.

ShareAI와 비교. ShareAI는 초점을 맞춥니다. 다중 제공업체 라우팅 + 마켓플레이스 투명성; 조직 전체 정책이 필요하다면 게이트웨이와 함께 사용하세요.

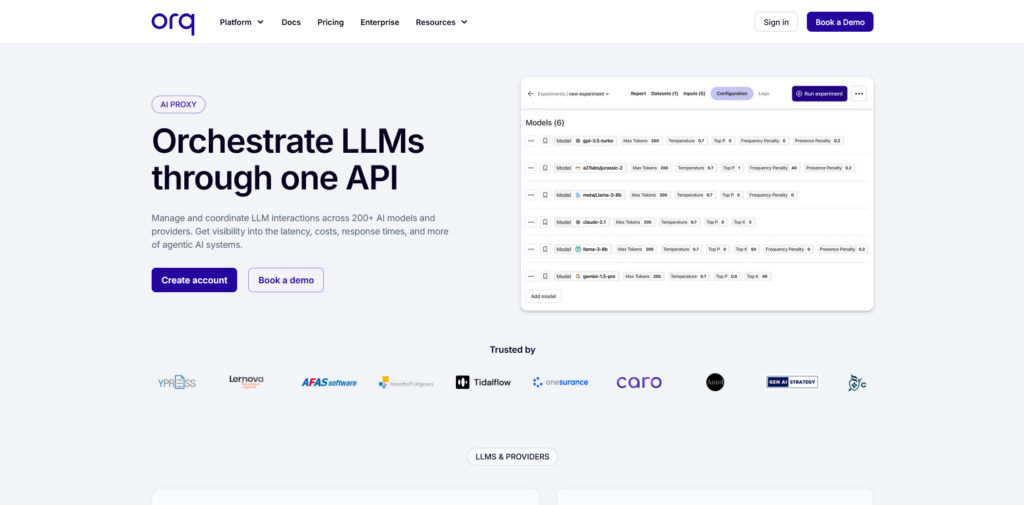

#4 — Kong AI Gateway

그것이 무엇인지. 오픈 소스 엔터프라이즈 게이트웨이: 정책/플러그인, 분석 및 AI 트래픽을 위한 엣지 거버넌스.

선택 시기. 귀하의 조직이 이미 Kong을 운영하거나 풍부한 API 거버넌스가 필요한 경우.

ShareAI와 비교. ShareAI 추가 투명한 제공자 선택 그리고 장애 조치; Kong을 유지하십시오 제어 플레인.

#5 — 에덴 AI

그것이 무엇인지. 오픈 소스 애그리게이터 LLM 및 광범위한 AI 서비스(비전, TTS, 번역)를 위해.

선택 시기. 하나의 키 뒤에 여러 AI 모달리티가 필요한 경우.

ShareAI와 비교. ShareAI는 전문적으로 마켓플레이스 투명성 을 위한 모델 라우팅 공급업체 전반에 걸쳐.

#6 — 라이트LLM

그것이 무엇인지. A 경량 SDK + 자체 호스팅 가능한 프록시 여러 제공자와 OpenAI 호환 인터페이스를 지원합니다.

선택 시기. 로컬 프록시를 직접 운영하고자 하는 DIY 팀.

ShareAI와 비교. ShareAI는 관리형 와 함께 마켓플레이스 데이터 그리고 장애 조치; 원하면 개발용으로 LiteLLM을 유지하십시오.

#7 — 유니파이

그것이 무엇인지. 품질 지향 선택 각 프롬프트에 더 나은 모델을 선택하기 위한 평가.

선택 시기. 원한다면 평가 기반 라우팅.

ShareAI와 비교. ShareAI는 추가합니다. 실시간 마켓플레이스 신호 그리고 즉각적인 장애 조치 여러 제공자에 걸쳐.

#8 — Orq (플랫폼)

그것이 무엇인지. 오케스트레이션/협업 팀이 실험에서 프로덕션으로 이동할 수 있도록 돕는 플랫폼 로우코드 플로우.

선택 시기. 가장 필요한 것이 워크플로우 오케스트레이션 그리고 팀 협업.

ShareAI와 비교. ShareAI는 공급자에 구애받지 않는 라우팅 와 함께 사전 경로 투명성 그리고 장애 조치; 많은 팀들이 Orq를 ShareAI와 함께 사용.

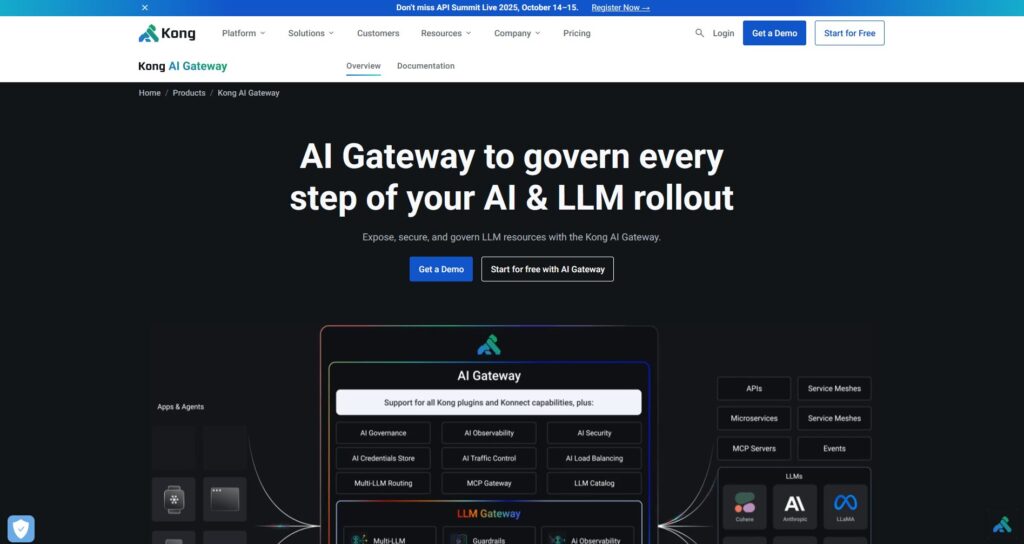

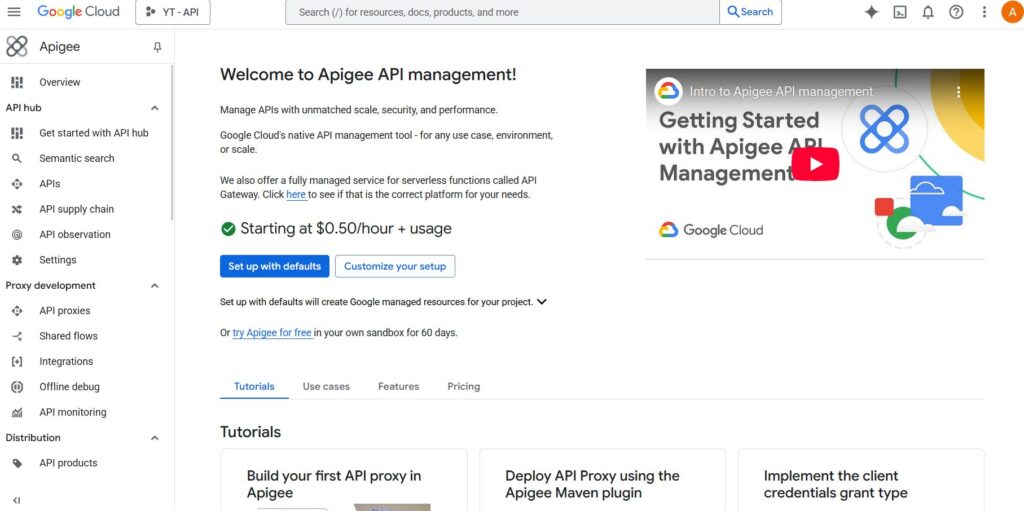

#9 — Apigee (LLM 백엔드 포함)

그것이 무엇인지. A 성숙한 API 관리 LLM 제공자 앞에 배치하여 적용할 수 있는 플랫폼 정책, 키, 할당량.

선택 시기. API 제어를 위해 Apigee를 표준화하는 엔터프라이즈 조직들.

ShareAI와 비교. ShareAI를 추가하여 얻기 투명한 제공자 선택 그리고 즉각적인 장애 조치.

#10 — NGINX (DIY)

그것이 무엇인지. A 직접 설정하는 엣지: 경로 게시, 토큰 적용, 사용자 정의 로직을 사용한 캐싱.

선택 시기. 선호한다면 완전 DIY 그리고 운영 대역폭이 있다면.

ShareAI와 비교. ShareAI와의 페어링은 맞춤형 로직을 피합니다 제공자 선택 그리고 장애 조치.

Orq AI Proxy vs ShareAI (빠른 보기)

필요한 경우 여러 제공자에 대한 하나의 API 와 함께 투명한 가격/지연 시간/가동 시간/가용성 그리고 즉각적인 장애 조치, 선택하고 공유AI. 최우선 요구 사항이 오케스트레이션 및 협업—플로우, 다단계 작업, 팀 중심의 생산화—Orq 해당 영역에 적합합니다. 많은 팀들이 이를 결합합니다: Orq 내부의 오케스트레이션 + ShareAI에서의 마켓플레이스 기반 라우팅.

빠른 비교

| 플랫폼 | 대상 | 모델 폭 | 거버넌스 및 보안 | 관측 가능성 | 라우팅 / 장애 조치 | 마켓플레이스 투명성 | 제공자 프로그램 |

|---|---|---|---|---|---|---|---|

| 공유AI | 제품/플랫폼 팀이 필요로 하는 가능하게 하는 방법을 보여줍니다 + 공정한 경제성 | 150개 이상의 모델, 많은 제공자 | API 키 및 경로별 제어 | 콘솔 사용 + 마켓플레이스 통계 | 스마트 라우팅 + 즉각적인 장애 조치 | 가격, 지연 시간, 가동 시간, 가용성, 제공자 유형 | 예—공급 개방; 제공자는 수익을 얻습니다 |

| Orq (프록시) | 오케스트레이션 우선 팀 | 플로우를 통한 광범위한 지원 | 플랫폼 제어 | 분석 실행 | 오케스트레이션 중심 | 마켓플레이스가 아님 | 해당 없음 |

| 오픈라우터 | 하나의 키를 원하는 개발자 | 광범위한 카탈로그 | 기본 API 제어 | 앱 측면 | 대체 옵션 | 부분적인 | 해당 없음 |

| 포트키 | 규제/기업 팀 | 광범위한 | 가드레일 및 거버넌스 | 깊은 추적 | 조건부 라우팅 | 부분적인 | 해당 없음 |

| 콩 AI 게이트웨이 | 게이트웨이 정책이 필요한 기업 | BYO | 강력한 엣지 정책/플러그인 | 분석 | 프록시/플러그인, 재시도 | 아니요 (infra 도구) | 해당 없음 |

| 에덴 AI | LLM 및 기타 AI 서비스를 필요로 하는 팀 | 광범위한 | 표준 제어 | 다양함 | 대체 옵션/캐싱 | 부분적인 | 해당 없음 |

| 라이트LLM | DIY/셀프 호스팅 프록시 | 많은 제공자 | 구성/키 제한 | 귀하의 인프라 | 재시도/대체 | 해당 없음 | 해당 없음 |

| 통합 | 품질 중심 팀 | 다중 모델 | 표준 API 보안 | 플랫폼 분석 | 최적 모델 선택 | 해당 없음 | 해당 없음 |

| Apigee / NGINX | 기업 / DIY | BYO | 정책 | 애드온 / 사용자 정의 | 사용자 정의 | 해당 없음 | 해당 없음 |

가격 및 TCO: 실제 비용 비교 (단위 가격만이 아님)

원시 $/1K 토큰 실제 상황을 숨깁니다. 총 소유 비용 (TCO) 와 함께 이동 재시도/대체, 지연 시간 (최종 사용자 사용에 영향을 미침), 공급자 변동성, 관측 가능성 저장소, 그리고 평가 실행. A 투명한 마켓플레이스 선택하는 데 도움을 줌 경로 균형을 맞추는 비용 그리고 UX.

TCO ≈ Σ (Base_tokens × Unit_price × (1 + Retry_rate)) + Observability_storage + Evaluation_tokens + Egress

- 프로토타입 (~10k 토큰/일): 최적화하세요 첫 번째 토큰까지의 시간 (놀이터, 빠른 시작).

- 중간 규모 (~2M 토큰/일): 마켓플레이스 안내 라우팅 + 장애 조치 줄일 수 있음 10–20% UX를 개선하면서 줄일 수 있습니다.

- 급증하는 작업 부하: 더 높은 기대 효과적인 장애 조치 중 재시도에서 발생하는 토큰 비용; 예산 그것을 위해.

마이그레이션 가이드: ShareAI로 이동

Orq에서

Orq의 오케스트레이션을 빛나는 곳에 유지; ShareAI 추가 을 위한 공급자에 구애받지 않는 라우팅 그리고 투명한 선택을 제공합니다. 패턴: 오케스트레이션 → 모델당 ShareAI 경로 → 마켓플레이스 통계 관찰 → 정책 강화.

OpenRouter에서

모델 이름을 매핑하고, 프롬프트 동등성을 확인한 후 섀도우 10% 트래픽 및 램프 25% → 50% → 100% 지연/오류 예산을 유지합니다. 마켓플레이스 데이터는 공급자 교체를 간단하게 만듭니다.

LiteLLM에서

운영하고 싶지 않은 프로덕션 경로에서 자체 호스팅 프록시를 교체; 원하는 경우 개발용으로 LiteLLM 유지. 비교 운영 오버헤드 대. 관리형 라우팅 이점.

Unify / Portkey / Kong / Traefik / Apigee / NGINX에서

기능 동등성 기대치를 정의하세요 (분석, 가드레일, 오케스트레이션, 플러그인). 많은 팀이 하이브리드 방식을 운영합니다: 특화된 기능은 가장 강력한 곳에 유지하고, 공유AI 을 위한 투명한 제공자 선택 + 장애 조치.

개발자 빠른 시작(복사-붙여넣기)

다음은 사용합니다. OpenAI 호환 인터페이스. 교체하십시오. YOUR_KEY ShareAI 키로—ShareAI 키는 다음에서 얻을 수 있습니다 API 키 생성.

#!/usr/bin/env bash"// JavaScript (fetch) — Node 18+/Edge 런타임;보안, 개인정보 보호 및 준수 체크리스트 (벤더 독립적)

- 키 처리: 회전 주기; 최소 범위; 환경 분리.

- 데이터 보존: 프롬프트/응답이 저장되는 위치와 저장 기간; 기본 수정 설정.

- PII 및 민감한 콘텐츠: 마스킹; 접근 제어; 지역 라우팅 데이터 지역성에 대해.

- 관찰 가능성: 프롬프트/응답 로깅; 필터링 또는 가명화; 추적 ID를 일관되게 전파.

- 사고 대응: 문제 해결 경로 및 제공자 SLA.

FAQ — Orq AI Proxy vs 다른 경쟁사

Orq AI Proxy vs ShareAI — 다중 제공자 라우팅을 위한 선택?

ShareAI. 그것은 다음을 위해 설계되었습니다. 마켓플레이스 투명성 (가격, 지연 시간, 가동 시간, 가용성, 제공업체 유형) 및 스마트 라우팅/장애 조치 여러 제공자에 걸쳐. Orq 초점을 맞춥니다 오케스트레이션 및 협업. 많은 팀이 Orq + ShareAI 함께 실행합니다.

Orq AI Proxy vs OpenRouter — 빠른 다중 모델 접근 또는 마켓플레이스 투명성?

OpenRouter는 멀티 모델 접근을 빠르게; 공유AI 계층에서 사전 경로 투명성 그리고 즉각적인 장애 조치 공급업체 전반에 걸쳐.

Orq AI Proxy vs Portkey — 가드레일/거버넌스 또는 마켓플레이스 라우팅?

Portkey는 강조합니다 거버넌스 및 관찰 가능성. 필요하다면 투명한 제공자 선택 그리고 장애 조치 와 함께 가능하게 하는 방법을 보여줍니다, 선택 공유AI (그리고 여전히 게이트웨이를 유지할 수 있습니다).

Orq AI Proxy vs Kong AI Gateway — 게이트웨이 제어 또는 마켓플레이스 가시성?

Kong은 중앙 집중화합니다. 정책/플러그인; 공유AI 제공합니다. 공급자에 구애받지 않는 라우팅 와 함께 실시간 마켓플레이스 통계—종종 함께 사용됩니다.

Orq AI Proxy vs Traefik AI Gateway — 얇은 AI 레이어 또는 마켓플레이스 라우팅?

Traefik의 AI 레이어는 추가합니다. AI 전용 미들웨어 그리고 OTel 친화적인 관측 가능성. 에 대한 투명한 공급자 선택 그리고 즉각적인 장애 조치, 사용하십시오 공유AI.

Orq AI Proxy vs Eden AI — 다수의 AI 서비스 또는 제공자 중립성?

Eden은 여러 AI 서비스를 집계합니다. 공유AI 초점을 맞춥니다 중립적인 모델 라우팅 와 함께 사전 경로 투명성.

Orq AI Proxy vs LiteLLM — 자체 호스팅 프록시 또는 관리형 마켓플레이스?

LiteLLM은 DIY; 공유AI 는 관리형 와 함께 마켓플레이스 데이터 그리고 장애 조치. 개발용으로 LiteLLM을 유지하세요, 원하신다면.

Orq AI Proxy 대 Unify — 평가 기반 모델 선택 또는 마켓플레이스 라우팅?

Unify는 품질 평가에 중점을 둡니다; 공유AI 추가합니다 실시간 가격/지연/가동 시간 신호 그리고 즉각적인 장애 조치 공급업체 전반에 걸쳐.

Orq AI Proxy 대 Apigee — API 관리 또는 공급자에 구애받지 않는 라우팅?

Apigee는 광범위한 API 관리. 공유AI 제공합니다 투명한 다중 공급자 라우팅 배치할 수 있습니다 뒤에 위치할 수 있습니다. 게이트웨이를.

Orq AI Proxy 대 NGINX — DIY 엣지 또는 관리형 라우팅?

NGINX는 제공합니다 DIY 필터/정책. 공유AI 사용자 정의 로직을 피합니다 제공자 선택 그리고 장애 조치.

Orq AI Proxy 대 Apache APISIX — 플러그인 생태계 또는 마켓플레이스 투명성?

APISIX는 제공합니다 플러그인 풍부한 게이트웨이. 공유AI 제공합니다 사전 라우트 제공자/모델 가시성 그리고 복원력 있는 라우팅을. 둘 다 사용하고 싶다면 사용하세요 엣지에서의 정책 그리고 투명한 다중 제공자 접근.