Alternativas ao Maxim Bifrost 2026: Top 10 Alternativas ao Maxim Bifrost

Atualizado Março 2026

Se você está avaliando Alternativas ao Maxim Bifrost, este guia compara as melhores opções como um construtor faria: categorias claras, trade-offs práticos e inícios rápidos de copiar e colar. Nós colocamos ShareAI primeiro quando você quer uma API entre muitos provedores, um mercado de modelos transparente (preço, latência, tempo de atividade, disponibilidade, tipo de provedor) antes você roteia, failover instantâneo, e economia impulsionada por pessoas (70% dos gastos vão para os provedores). Se você também está procurando por alternativas ao Portkey, os mesmos critérios se aplicam—veja as notas abaixo para saber como comparar gateways com agregadores estilo marketplace.

O que é o Maxim Bifrost (em resumo): Bifrost é um gateway LLM de alto desempenho que expõe uma API compatível com OpenAI, suporta múltiplos provedores, adiciona alternativas e observabilidade, e enfatiza throughput e substituição “drop-in” para SDKs existentes. Seus documentos e site destacam alegações de desempenho, rastreamento/métricas nativas, opções de clustering/VPC e guias de migração.

Agregadores vs Gateways vs Plataformas de Agentes

Agregadores de LLM (por exemplo, ShareAI, OpenRouter) fornecem uma API para muitos modelos/provedores com transparência pré-rota (veja preço/latência/tempo de atividade/disponibilidade primeiro) e roteamento inteligente/failover para que você possa trocar de provedores sem reescritas.

Gateways de IA (por exemplo, Maxim Bifrost, Portkey, Kong) focam em governança de saída, credenciais/políticas, guardrails e observabilidade. Eles podem incluir alternativas e catálogos, mas tipicamente não oferecer uma visão de mercado ao vivo de preço/latência/tempo de atividade/disponibilidade antes roteamento.

Plataformas de agente/chatbot (por exemplo, Orq, Unify) enfatizam orquestração, memória/ferramentas, avaliação e fluxos de colaboração em vez de agregação independente de provedores.

Como avaliamos as melhores alternativas ao Maxim Bifrost

- Amplitude e neutralidade do modelo: proprietário + aberto; troca fácil; sem reescritas.

- Latência e resiliência: políticas de roteamento, tempos limite, novas tentativas, failover instantâneo.

- Governança e segurança: gerenciamento de chaves, escopos, roteamento regional, RBAC.

- Observabilidade: logs/traces e dashboards de custo/latência.

- Transparência de preços & TCO: comparar custos reais antes de você rotear.

- Experiência do desenvolvedor: docs, SDKs, quickstarts; tempo-para-primeiro-token.

- Comunidade & economia: se seus gastos aumentam a oferta (incentivos para proprietários de GPU).

Top 10 alternativas ao Maxim Bifrost

#1 — ShareAI (API de IA impulsionada por pessoas)

O que é. A API multi-fornecedor com um mercado transparente and roteamento inteligente. Com uma integração, navegue por um grande catálogo de modelos/provedores, compare preço, latência, tempo de atividade, disponibilidade, tipo de provedor, e roteie com failover instantâneo. A economia é impulsionada por pessoas: 70% de cada dólar flui para provedores (comunidade ou empresa) que mantêm modelos online.

Por que é #1 aqui. Se você deseja agregação independente de provedores com transparência pré-rota e resiliência, ShareAI é o ajuste mais direto. Mantenha um gateway se precisar de políticas em toda a organização; adicione ShareAI para roteamento guiado pelo mercado.

Links rápidos: Navegar Modelos · Abrir Playground · Criar Chave de API · Referência da API · Página Inicial da Documentação · Lançamentos

#2 — Chave de Portal

O que é. Um gateway de IA que enfatiza observabilidade, limites e governança—popular em equipes regulamentadas. Se sua prioridade for controles de políticas e rastreamentos profundos, Portkey se encaixa na categoria de gateway. Combine com ShareAI para roteamento guiado pelo mercado.

#3 — OpenRouter

O que é. Uma API unificada sobre muitos modelos—útil para experimentos rápidos com vários modelos e ampla cobertura de catálogo. Adicione ShareAI quando quiser tempo real transparência (preço/latência/tempo de atividade/disponibilidade) e failover instantâneo entre provedores.

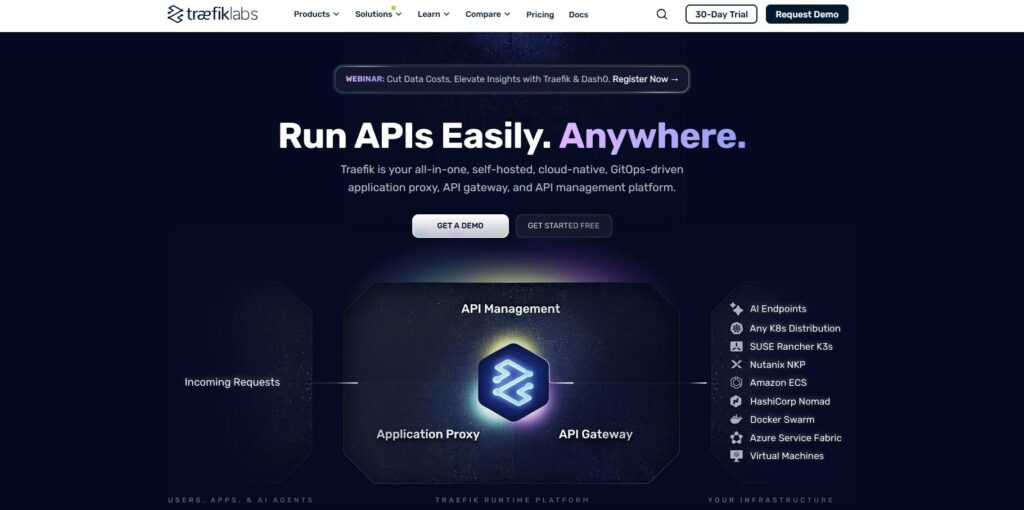

#4 — Traefik AI Gateway

O que é. Estilo Gateway governança de saída (credenciais/políticas) com observabilidade compatível com OpenTelemetry; uma camada LLM fina sobre o Traefik Hub—mais “plano de controle” do que marketplace. Combine com ShareAI para roteamento agnóstico de provedores.

#5 — Eden AI

O que é. Um amplo agregador de serviços de IA (LLM + visão + TTS). Adicione ShareAI quando precisar de transparência de marketplace e roteamento resiliente multi-provedor para LLMs.

#6 — LiteLLM

O que é. Um SDK Python leve/proxy auto-hospedável que fala compatível com OpenAI para muitos provedores—bom para DIY. Use ShareAI para reduzir a sobrecarga de operações e obter escolha de provedores orientada por marketplace + failover.

#7 — Unify

O que é. Roteamento orientado por avaliação para escolher modelos de maior qualidade por prompt. Se você quiser transparência pré-roteamento e failover instantâneo entre provedores, ShareAI complementa bem isso.

#8 — Orq AI

O que é. Plataforma de orquestração/colaboração—fluxos e produção em vez de roteamento de marketplace. Use ShareAI para acesso agnóstico de provedores e resiliência.

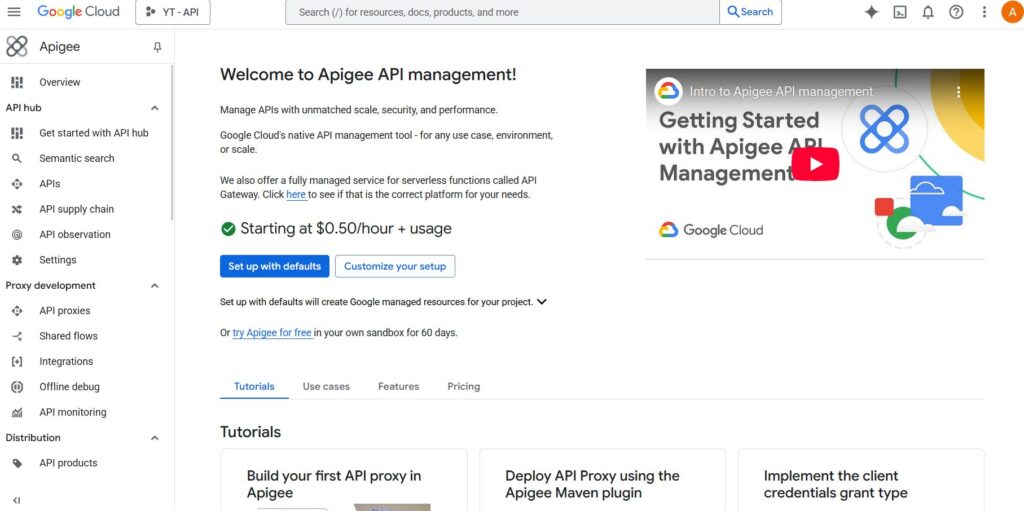

#9 — Apigee (coloque IA na frente com ele)

O que é. Gerenciamento de API/gateway maduro que você pode colocar na frente de provedores de LLM para aplicar políticas, chaves, cotas. ShareAI adiciona roteamento transparente multi-provedor quando você quer evitar lock-in.

#10 — NGINX

O que é. Proxy reverso DIY—aplicação de token, roteamento/cache simples se você gosta de criar o seu próprio. Combine com ShareAI para evitar Lua personalizada e ainda obter seleção de provedores guiada por marketplace + failover.

Maxim Bifrost vs ShareAI

Escolha ShareAI se você quiser uma API sobre muitos provedores com preços/transparência/latência/disponibilidade and failover instantâneo. Escolha Bifrost se sua principal necessidade for governança de saída + alta taxa de transferência com recursos como rastreamento/métricas nativas, clustering e implantações VPC. Muitas equipes combinam um gateway com ShareAI: gateway para política organizacional; ShareAI para roteamento guiado pelo marketplace.

Comparação rápida

| Plataforma | Quem atende | Amplitude do modelo | 2. Governança e segurança | Observabilidade | Roteamento / failover | Transparência do marketplace | Programa de provedores |

|---|---|---|---|---|---|---|---|

| ShareAI | Equipes de produto/plataforma que precisam de uma API + economia justa | 150+ modelos; muitos provedores | Chaves de API e controles por rota | Uso do console + estatísticas do marketplace | Roteamento inteligente + failover instantâneo | Sim (preço, latência, tempo de atividade, disponibilidade, tipo de provedor) | Sim — fornecimento aberto; 70% para provedores |

| Maxim Bifrost | Equipes que desejam um gateway de alto desempenho | “1000+ modelos” via API unificada | RBAC, orçamentos, governança, VPC | Rastreamento/métricas, painéis | Alternativas & clustering | Não (gateway, não um marketplace) | n/d |

Sobre o posicionamento do Bifrost: “Gateway LLM... conecta 1000+ modelos... estilo drop-in, observabilidade e migração.” Sobre desempenho/benchmarks e rastreamento, veja seus produtos/docs/blog.

Preços e TCO: compare custos reais (não apenas preços unitários)

Raw $/1K tokens oculta o verdadeiro panorama. Seu TCO muda com tentativas/alternativas., latência (impactos no uso/UX), variação do provedor, armazenamento de observabilidade, e avaliação executa. Um mercado transparente ajuda você a escolher rotas que equilibram custo e UX.

TCO ≈ Σ (Base_tokens × Unit_price × (1 + Retry_rate))Protótipo (~10k tokens/dia): Otimizar para o tempo até o primeiro token (Playground, quickstarts). Escala média (~2M tokens/dia): O roteamento/failover guiado pelo marketplace pode reduzir 10–20% enquanto melhora o UX. Cargas de trabalho irregulares: Espere custos efetivos mais altos de tokens devido a tentativas durante o failover; planeje o orçamento para isso.

Início rápido para desenvolvedores (compatível com OpenAI)

Substituir SUA_CHAVE pela sua chave ShareAI—obtenha uma em Criar Chave de API. Então experimente estes:

#!/usr/bin/env bash"// JavaScript (fetch) — Node 18+/Edge runtimes;# Python (requests)Mais documentos: Referência da API · Página Inicial da Documentação · Abrir Playground

Para provedores: ganhe mantendo modelos online

Qualquer pessoa pode se tornar um provedor ShareAI—Comunidade ou Empresa. Integre-se via Windows, Ubuntu, macOS ou Docker. Contribua com rajadas de tempo ocioso ou opere sempre ativo. Escolha seu incentivo: Recompensas (dinheiro), Trocar (tokens/AI Prosumer), ou Missão (doe um % para ONGs). Conforme você escala, defina preços de inferência e ganhe exposição preferencial.

Links de provedores: Guia do Provedor · Painel do Provedor · Visão Geral da Troca · Contribuição da Missão

FAQ — Maxim Bifrost vs outros concorrentes (e onde o ShareAI se encaixa)

Maxim Bifrost vs OpenRouter — qual é melhor para velocidade multi-modelo?

OpenRouter é rápido para experimentar com vários modelos. Bifrost é um gateway construído para throughput com substituição direta e governança. Se você também quiser transparência pré-rota and failover instantâneo entre provedores, escolha ShareAI.

Maxim Bifrost vs Traefik AI Gateway — qual gateway?

Ambos são gateways: Traefik inclina-se para políticas de borda/observabilidade; Bifrost enfatiza o roteamento de LLM de alta capacidade. Se você quiser transparência de marketplace + uma API sobre muitos provedores, adicione ShareAI.

Maxim Bifrost vs Portkey — quem é mais forte em guardrails?

Ambos enfatizam governança e observabilidade. Se sua principal necessidade é escolha transparente de provedores and failover instantâneo entre provedores, ShareAI é construído especificamente para isso.

Maxim Bifrost vs Eden AI — muitos serviços de IA ou controle de gateway?

Eden IA agrega múltiplos serviços de IA (LLM, TTS, visão). Bifrost centraliza o egress para LLMs. Para roteamento guiado por marketplace com visibilidade de preço/latência/disponibilidade antes você roteia, escolha ShareAI.

Maxim Bifrost vs LiteLLM — proxy DIY ou gateway empacotado?

LiteLLM é um proxy/SDK DIY. Bifrost é um gateway empacotado. Se você preferir não operar infraestrutura e quiser 7. . Se você já usa APISIX/APIs, reconhecerá a abordagem de plano de controle/plano de dados e o modelo de plugins. dados + roteamento resiliente, use ShareAI. (Bifrost frequentemente cita benchmarks vs LiteLLM; veja seu repositório/blog.)

Maxim Bifrost vs Unify — seleção do melhor modelo vs aplicação de políticas?

Unificar otimiza a qualidade da seleção; Bifrost aplica política/roteamento. Para combinar multi-provedor acesso, transparência pré-rota, e failover, escolha ShareAI.

Maxim Bifrost vs Orq AI — orquestração vs saída?

Orq ajuda a orquestrar fluxos; Bifrost governa a saída. ShareAI complementa ambos com uma visão de marketplace e roteamento resiliente.

Maxim Bifrost vs Kong AI Gateway — gateway empresarial vs gateway de velocidade de desenvolvimento?

Ambos são gateways. Se você também precisar mercado transparente comparações e failover instantâneo entre provedores, camada ShareAI.

Maxim Bifrost vs Apigee — gerenciamento de API vs gateway específico para IA?

Apigee é gerenciamento amplo de API; Bifrost é focado em IA. Para acesso independente de provedor com um mercado ao vivo, ShareAI é a melhor opção.

Maxim Bifrost vs NGINX — faça você mesmo vs pronto para uso?

NGINX oferece controles faça você mesmo; Bifrost é pronto para uso. Para evitar Lua personalizada e ainda obter seleção de provedor transparente and failover, use ShareAI.

“Eu procurei por alternativas ao Portkey — isso é relevante?”

Sim—Portkey também é um gateway. Os critérios de avaliação aqui (preço/latência/transparência de uptime, failover, governança, observabilidade, velocidade do desenvolvedor) se aplicam igualmente. Se você quiser alternativas ao Portkey que adicionam roteamento guiado por marketplace and fornecimento impulsionado por pessoas, experimente ShareAI primeiro.

Fontes (Maxim Bifrost)

- Maxim Bifrost (página do produto) — posicionamento & “1000+ modelos,” posicionamento de desempenho.

- Documentação do Bifrost: Visão Geral & Introdução — API unificada, uso, links de arquitetura.

- Benchmarks — testes de carga a 5000 RPS e especificações de instância.

- Recurso de rastreamento — rastreamento de solicitação/resposta.

- GitHub: maximhq/bifrost — repositório de código aberto & readme.

Experimente o ShareAI a seguir

Abrir Playground · Crie sua chave de API · Navegar Modelos · Leia a Documentação · Ver lançamentos · Entrar / Registrar-se