Eden AI Alternativas 2026: ShareAI vs OpenRouter, Portkey, Kong AI, Unify, Orq & LiteLLM

Eden AI Alternativas 2026: ShareAI vs OpenRouter, Portkey, Kong AI, Unify, Orq & LiteLLM

Atualizado Março 2026

Desenvolvedores gostam Eden IA porque oferece uma única API para muitos provedores e modalidades de IA—LLMs mais geração de imagens, OCR/análise de documentos, conversão de fala para texto e tradução—junto com extras úteis, como comparação de modelos, monitoramento de custos e API, processamento em lote, cache, e gerenciamento de várias chaves de API. A precificação é sem compromisso, pague conforme o uso, e você pode usar um Caixa de areia token para retornar respostas fictícias enquanto conecta seu aplicativo.

Não é a única rota, no entanto. Se você se importa mais com a transparência do mercado (ser capaz de escolher provedores por preço, latência, tempo de atividade, disponibilidade antes de encaminhar), governança rigorosa de gateway ou auto-hospedagem, uma alternativa ao Eden AI pode se encaixar melhor. Este guia mapeia as opções como um construtor faria—para que você possa lançar rapidamente e manter o TCO previsível.

- O que o Eden AI realmente faz (e onde pode não se encaixar)

- Como escolher uma alternativa ao Eden AI

- Melhores alternativas ao Eden AI (escolhas rápidas)

- Análises detalhadas: principais alternativas

- Início rápido: chame um modelo em minutos (ShareAI)

- Comparação de relance

- Perguntas frequentes

O que o Eden AI realmente faz (e onde pode não se encaixar)

O que é. Eden AI é um API unificada sobre muitos provedores e modalidades. Você pode chamar chat/completions para LLMs, executar visão computacional e geração de imagens, analisar documentos com OCR, converter fala em texto e traduzir—sem integrar vários SDKs de fornecedores. Um Comparação de Modelos ferramenta ajuda você a testar provedores lado a lado. Monitoramento de Custos and Monitoramento de API acompanhar gastos e uso. Processamento em Lote lida com grandes cargas de trabalho, e Cache de API reduz custos repetidos e latência. Você pode trazer suas próprias chaves de provedor ou comprar créditos através do Eden. Um token Sandbox retorna respostas fictícias seguras durante a integração.

Como funciona o preço. Eden AI enfatiza nenhuma sobrecarga de assinatura: você paga por solicitação nas taxas do provedor, e pode opcionalmente adicionar créditos que são consumidos entre serviços. Muitas equipes começam com Sandbox enquanto configuram solicitações, depois trocam para chaves reais ou créditos para produção.

Onde pode não se encaixar. Se você precisar (a) de uma mercado transparente visão por provedor preço, latência, tempo de atividade e disponibilidade antes de cada rota, (b) governança em nível de gateway (política na borda da rede, rastreamentos profundos, exportações compatíveis com SIEM), ou (c) um caminho auto-hospedado caminho que você opera totalmente, você pode preferir uma classe de ferramenta diferente (agregador de marketplace, gateway ou proxy de código aberto). As alternativas abaixo cobrem essas forças.

Como escolher uma alternativa ao Eden AI

- Custo total de propriedade (TCO). Não pare em $/1K tokens. Considere taxas de acerto de cache, tentativas/recuos, enfileiramento, custos de avaliador e a sobrecarga operacional de observabilidade.

- Latência e confiabilidade. Prefira roteamento sensível à região, reutilização de cache aquecido (permaneça no mesmo provedor para reutilizar o contexto) e comportamento de fallback preciso (por exemplo, tentar novamente em 429s; escalar em timeouts).

- Observabilidade e governança. Se você precisar de trilhos de segurança, logs de auditoria e aplicação de políticas na borda, um gateway (por exemplo, Portkey ou Kong AI Gateway) pode ser mais forte do que um agregador puro.

- Auto-hospedado vs gerenciado. Prefere endpoints compatíveis com Docker/K8s/Helm e OpenAI? LiteLLM é uma escolha OSS comum; Kong IA Gateway é infraestrutura que você opera. Prefere velocidade hospedada com transparência estilo marketplace? Veja ShareAI, OpenRouter, ou Unificar.

- Amplitude além do chat. Se o roteiro abrange OCR, fala e tradução sob um único orquestrador, uma cobertura multimodal como a do Eden AI pode simplificar a entrega.

- Preparação para o futuro. Prefira ferramentas que tornem as trocas de provedor/modelo indolores (por exemplo, roteamento dinâmico ou APIs universais) para que você possa adotar modelos mais novos, baratos ou rápidos sem reescritas.

Melhores alternativas ao Eden AI (escolhas rápidas)

ShareAI (nossa escolha para transparência de marketplace + economia para desenvolvedores) — Uma API em mais de 150 modelos com failover instantâneo e um marketplace que destaca preço/latência/disponibilidade/tempo de atividade antes de você rotear. Provedores (comunidade ou empresa) ganham 70% receita, alinhando incentivos com confiabilidade. Explore: Navegar Modelos • Leia a Documentação • Playground • Criar Chave de API • Guia do Provedor

OpenRouter — API unificada sobre muitos modelos; roteamento de provedor and cache de prompt otimize custo e throughput reutilizando contextos aquecidos onde suportado.

Portkey — Gateway de IA com alternativas programáveis, playbooks de limite de taxa, e cache simples/semântico, além de rastreamentos/métricas. Ótimo para roteamento baseado em políticas e operações estilo SRE.

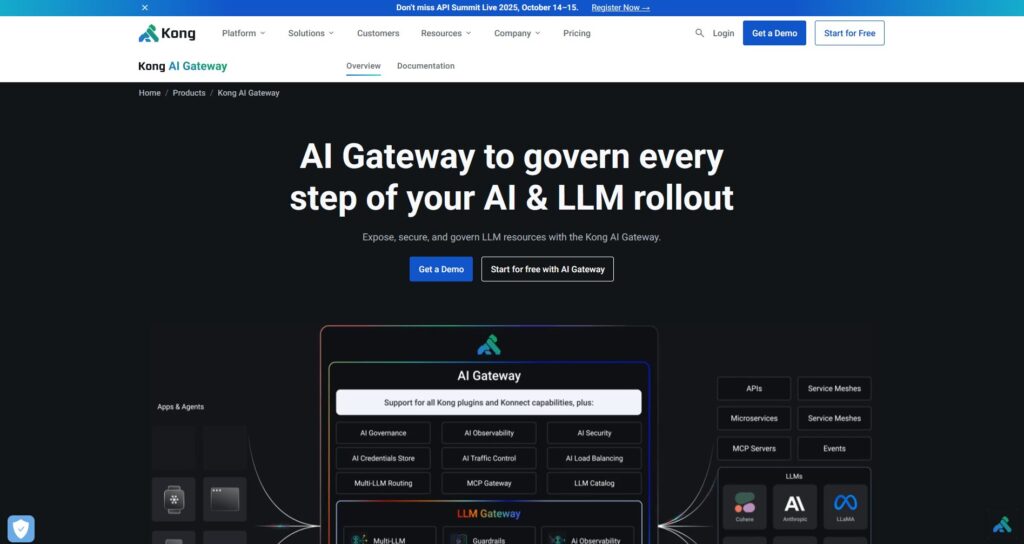

Kong IA Gateway — Governança na borda com plugins de IA, análises e políticas; combina bem com agregadores se você precisar de controle centralizado.

Unificar — Roteador orientado por dados que otimiza custo/velocidade/qualidade usando desempenho ao vivo e uma API universal.

Orq.ia — Colaboração + LLMOps (experimentos, avaliadores—incl. RAG), implantações, RBAC/VPC). Bom quando você precisa de experimentação + governança.

LiteLLM — Proxy/gateway de código aberto com endpoints compatíveis com OpenAI, orçamentos/limites de taxa, registro/métricas e roteamento de retry/fallback—implantável via Docker/K8s/Helm.

Análises detalhadas: principais alternativas

ShareAI (API de IA impulsionada por pessoas)

O que é. Uma rede de IA orientada ao provedor e API unificada. Navegue por um grande catálogo de modelos/provedores e roteie com failover instantâneo. O marketplace exibe preço, latência, tempo de atividade e disponibilidade antecipadamente. Economia envia 70% de gastos para provedores de GPU que mantêm modelos online.

Por que as equipes escolhem isso. Mercado transparente para comparar provedores antes de rotear, resiliência por padrão via failover rápido, e economia alinhada ao construtor. Comece rápido no Playground, crie chaves no Console e siga o Início rápido da API.

Fatos do provedor (ganhe mantendo os modelos online). Qualquer pessoa pode se tornar um provedor (Comunidade ou Empresa). Integre-se via Windows/Ubuntu/macOS ou Docker; contribua com rajadas de tempo ocioso ou execute sempre ativo; escolha incentivos: Recompensas (dinheiro), Trocar (tokens/AI Prosumer), ou Missão (doe 1% para ONGs). À medida que você escala, defina seus próprios preços de inferência e ganhe exposição preferencial. Veja o Guia do Provedor.

Ideal para. Equipes de produto que desejam transparência no marketplace, resiliência e economia alinhada ao construtor, com um início sem atritos e espaço para crescer no modo provedor.

OpenRouter

O que é. Uma API unificada para muitos modelos com roteamento de provedor/modelo and cache de prompt. A plataforma pode manter solicitações no mesmo provedor para reutilizar caches aquecidos e recorrer ao próximo melhor quando um provedor se torna indisponível.

Recursos de destaque. Roteamento com viés de preço e throughput; reutilização de cache onde suportado.

Atenção. Para governança de gateway profundo ou pipelines SIEM, muitas equipes combinam OpenRouter com Portkey ou Kong AI Gateway.

Portkey

O que é. Uma Plataforma de operações de IA + gateway com programação alternativas, limite de taxa estratégias, e cache simples/semântico, além de rastreamentos/métricas.

Recursos de destaque. Recuos aninhados e roteamento condicional; chaves virtuais e orçamentos; cache semântico ajustado para prompts e mensagens curtas.

Atenção. Mais para configurar e operar do que um agregador puro.

Kong IA Gateway

O que é. Uma gateway de borda que adiciona plugins de IA, governança e análises ao ecossistema Kong. É infraestrutura—ótima quando você precisa de política centralizada e auditoria.

Recursos de destaque. Plugins de proxy de IA, modelos de engenharia de prompts e um plano de controle em nuvem via Konnect.

Atenção. Espere configuração e manutenção; combine com um agregador se você também quiser uma visão de mercado.

Unificar

O que é. A API universal com roteamento orientado por dados para maximizar custo/velocidade/qualidade usando métricas ao vivo; forte ênfase em avaliação e benchmarks.

Recursos de destaque. Roteamento dinâmico e recuos; seleção guiada por benchmarks que atualiza por região e carga de trabalho.

Atenção. Padrões opinativos—valide com seus próprios prompts.

Orq.ia

O que é. A colaboração de IA generativa plataforma: experimentos, avaliadores (incluindo RAG), implantações, RBAC/VPC.

Recursos de destaque. Biblioteca de avaliador com métricas RAG (relevância do contexto, fidelidade, recall, robustez).

Atenção. Superfície mais ampla do que um roteador “single-endpoint” minimalista.

LiteLLM

O que é. Uma proxy/gateway de código aberto com endpoints compatíveis com OpenAI, orçamentos/limites de taxa, registro/métricas e roteamento de tentativa/fallback. Auto-hospede via Docker/K8s/Helm.

Recursos de destaque. Orçamentos e limites de taxa por projeto/chave de API/equipe; UI de administração e rastreamento de gastos.

Atenção. Você gerencia operações e atualizações (típico para OSS).

Início rápido: chame um modelo em minutos (ShareAI)

Comece no Playground, então pegue um chave de API e envie. Referência: Início rápido da API • Página Inicial da Documentação • Lançamentos.

#!/usr/bin/env bash"

// ShareAI — Conclusões de Chat (JavaScript, Node 18+);

Comparação de relance

| Plataforma | Hospedado / Auto-hospedado | Roteamento e Alternativas | Observabilidade | Amplitude (LLM + além) | Governança/Política | Notas |

|---|---|---|---|---|---|---|

| Eden IA | Hospedado | Trocar provedores; lote; cache | Monitoramento de API e custos | LLM, OCR, visão, fala, tradução | Faturamento centralizado/gerenciamento de chaves | Traga suas próprias chaves ou créditos; Token de sandbox; endpoint de chat unificado no estilo OpenAI. |

| ShareAI | Hospedado + rede de provedores | Failover instantâneo; roteamento guiado por marketplace | Logs de uso; estatísticas do marketplace | Catálogo amplo de modelos | Controles do provedor | Receita de 70% para provedores; mercado “Movido por Pessoas”. |

| OpenRouter | Hospedado | Roteamento de provedor/modelo; cache de prompt. | Informações em nível de solicitação | Centrado em LLM | Políticas em nível de provedor | Reutilização de cache onde suportado; fallback em indisponibilidade. |

| Portkey | Hospedado & Gateway | Políticas de fallback; playbooks de limite de taxa; cache simples/semântico. | Rastreamentos/métricas | LLM-primeiro | Configurações de gateway | Ótimo para controle e diretrizes no estilo SRE. |

| Kong IA Gateway | Auto-hospedado/Empresarial | Roteamento upstream via plugins de IA | Métricas/auditoria via Kong | LLM-primeiro | Governança forte na borda | Componente de infraestrutura; combina com agregadores. |

| Unificar | Hospedado | Roteador orientado por dados por custo/velocidade/qualidade. | Explorador de benchmarks | Centrado em LLM | Preferências de roteador | Escolhas guiadas por benchmarks. |

| Orq.ia | Hospedado | Repetições/alternativas na orquestração | Análise de plataforma; avaliadores RAG | LLM + RAG + avaliações | Opções RBAC/VPC | Colaboração e experimentação. |

| LiteLLM | Auto-hospedagem/OSS | Repetir/tolerância a falhas; orçamentos/limites | Registro/métricas; interface administrativa | Centrado em LLM | Controle total da infraestrutura | Endpoints compatíveis com OpenAI. |

Perguntas frequentes

O que é Eden AI? (“Eden AI explicado”)

Eden AI agrega vários provedores de IA por trás de uma API unificada—cobrindo chat LLM além de visão/OCR, fala e tradução—e adiciona ferramentas como comparação de modelos, monitoramento de custos/API, processamento em lote e cache.

Eden AI é gratuito? Preciso de uma assinatura? (“Preços do Eden AI / camada gratuita”)

Eden AI utiliza pague conforme o uso preços. Não há necessidade de assinatura, e você pode trazer suas próprias chaves de provedor ou comprar créditos. Para desenvolvimento, o Caixa de areia token retorna respostas fictícias para que você possa integrar sem incorrer em custos.

O Eden AI suporta BYOK/BYOA?

Sim. Você pode trazer suas próprias contas/chaves de fornecedores para provedores compatíveis e ser cobrado diretamente por eles, ou pagar através de créditos Eden.

A Eden AI possui processamento em lote, cache e monitoramento?

Sim—Processamento em Lote para grandes tarefas, Cache de API para solicitações repetidas e Monitoramento de Custo/API para manter o uso e os gastos sob controle são partes essenciais da plataforma.

Eden AI vs ShareAI: qual é melhor?

Escolha o ShareAI se você quiser um mercado transparente que apresenta preço/latência/disponibilidade/tempo de atividade antes de você rotear, failover instantâneo, e economia alinhada ao construtor (70% para provedores). Escolha Eden AI se o seu roteiro precisar ampla cobertura multimodal (OCR, fala, tradução) sob uma API com processamento em lote/cache/monitoramento.

Eden AI vs OpenRouter: qual é a diferença?

OpenRouter foca em LLMs com roteamento de provedores e cache de prompts, enquanto Eden IA abrange tarefas multimodais além do chat com comparação de modelos, lote, cache e monitoramento. Muitas equipes combinam um roteador com um gateway para governança—ou escolhem ShareAI obter transparência de mercado e roteamento resiliente em um só lugar.

Eden AI vs Portkey vs Kong AI: roteador ou gateway?

Portkey and Kong IA Gateway são gateways—ótimo para política/limites (alternativas, limites de taxa, análises, governança de borda). Eden IA é um agregador/orquestrador para múltiplos serviços de IA. Algumas pilhas usam ambos: um gateway para política organizacional e um agregador para roteamento estilo marketplace.

Eden AI vs LiteLLM: hospedado vs auto-hospedado?

Eden IA é hospedado. LiteLLM é um proxy/gateway de código aberto você se implementa com orçamentos/limites e uma superfície compatível com OpenAI. Escolha com base em se você deseja conveniência gerenciada ou controle total da infraestrutura.

Qual é uma boa alternativa ao Eden AI para governança rigorosa e isolamento VPC?

Considere Kong IA Gateway se você precisa de governança autônoma de nível empresarial na borda da rede. Você também pode combinar um gateway (política/observabilidade) com um roteador estilo marketplace para escolha de modelo e controle de custos.

Qual é a melhor alternativa ao Eden AI se eu quiser hospedar localmente?

LiteLLM é um proxy popular de código aberto com endpoints compatíveis com OpenAI, orçamentos, limites de taxa e registro. Se você já utiliza o Kong, Kong IA Gateway insere políticas de IA na sua borda existente.

Qual é o mais barato para minha carga de trabalho: Eden AI, ShareAI, OpenRouter ou LiteLLM?

Depende da escolha do modelo, região, capacidade de cache e padrões de tráfego. Agregadores como ShareAI and OpenRouter podem reduzir custos através de roteamento e cache; gateways como Portkey adicionam cache semântico e playbooks de limitação de taxa; LiteLLM reduz a sobrecarga da plataforma se você estiver confortável operando seu próprio proxy. Faça benchmarks com seus prompts e acompanhe o custo efetivo por resultado—não apenas o preço por token.

Como faço para migrar do Eden AI para o ShareAI com mudanças mínimas no código?

Mapeie seus modelos para equivalentes do ShareAI, espelhe os formatos de solicitação/resposta e comece atrás de um recurso de controle. Direcione uma pequena porcentagem do tráfego primeiro, compare latência/custo/qualidade e, em seguida, aumente. Se você também operar um gateway, certifique-se de que o cache/recursos de fallback não sejam acionados duas vezes entre as camadas.

Por que o ShareAI frequentemente vence como uma “alternativa ao Eden AI”

9. aplicação de políticas escolhendo o provedor certo antes de rotear—fatoração preço, latência, tempo de atividade e disponibilidade—A visão de mercado do ShareAI é difícil de superar. Ela combina seleção transparente com failover instantâneo, depois alinha os incentivos retornando 70% dos gastos para provedores que mantêm os modelos online. Para equipes de plataforma, essa combinação reduz surpresas, estabiliza os SLAs e permite que você ganhar como um provedor quando suas GPUs estão ociosas (Recompensas, Tokens de troca ou Doações de Missão).

Próximos passos: Navegar Modelos • Abrir Playground • Crie sua chave de API • Entrar ou Cadastrar-se.