Альтернативы Eden AI 2026: ShareAI vs OpenRouter, Portkey, Kong AI, Unify, Orq & LiteLLM

Альтернативы Eden AI 2026: ShareAI vs OpenRouter, Portkey, Kong AI, Unify, Orq & LiteLLM

Обновлено Март 2026

Разработчикам нравится Eden AI потому что он предлагает единый API для многих поставщиков ИИ и модальностей — LLMs плюс генерация изображений, OCR/разбор документов, преобразование речи в текст и перевод — вместе с полезными дополнениями, такими как сравнение моделей, мониторинг стоимости и API, пакетная обработка, кэширование, и управление несколькими API-ключами. Цены без обязательств, оплатой по мере использования, и вы можете использовать Песочница токен для возврата фиктивных ответов при подключении вашего приложения.

Однако это не единственный путь. Если вам важнее прозрачность рынка (возможность выбирать поставщиков по цену, задержку, время безотказной работы, доступность перед маршрутизацией), строгая политика шлюза или самостоятельный хостинг, альтернатива Eden AI может подойти лучше. Это руководство описывает варианты так, как это сделал бы разработчик — чтобы вы могли быстро запустить и сохранить предсказуемую TCO.

- Что на самом деле делает Eden AI (и где он может не подойти)

- Как выбрать альтернативу Eden AI

- Лучшие альтернативы Eden AI (быстрый выбор)

- Подробный обзор: лучшие альтернативы

- Быстрый старт: вызов модели за минуты (ShareAI)

- Сравнение с первого взгляда

- Часто задаваемые вопросы

Что на самом деле делает Eden AI (и где он может не подойти)

Что это. Eden AI — это унифицированный API у многих поставщиков и модальностей. Вы можете вызывать chat/completions для LLMs, запускать компьютерное зрение и генерацию изображений, анализировать документы с помощью OCR, преобразовывать речь в текст и переводить — без объединения нескольких SDK поставщиков. A Сравнение моделей инструмент помогает тестировать поставщиков бок о бок. Мониторинг затрат и Мониторинг API отслеживать расходы и использование. Пакетная обработка обрабатывает большие рабочие нагрузки, и Кэширование API снижает повторные затраты и задержки. Вы можете использовать свои собственные ключи поставщика или покупать кредиты через Eden. A Токен песочницы возвращает безопасные фиктивные ответы во время интеграции.

Как работает ценообразование. Eden AI подчеркивает отсутствие накладных расходов на подписку: вы платите за запрос по тарифам поставщика, и вы можете дополнительно добавить кредиты, которые расходуются на различные услуги. Многие команды начинают с песочницы при настройке запросов, затем переходят на реальные ключи или кредиты для производства.

Где это может не подойти. Если вам нужен (a) прозрачный рынок обзор по каждому поставщику цену, задержку, время безотказной работы и доступность перед каждым маршрутом, (b) управление на уровне шлюза (политика на границе сети, глубокие трассировки, экспорт, совместимый с SIEM), или (c) автономный путь, который вы полностью управляете, вы можете предпочесть другой класс инструментов (агрегатор с приоритетом на маркетплейс, шлюз или прокси с открытым исходным кодом). Альтернативы ниже охватывают эти преимущества.

Как выбрать альтернативу Eden AI

- Общая стоимость владения (TCO). Не останавливайтесь на $/1K токенах. Учитывайте коэффициенты попадания в кэш, повторные попытки/резервные варианты, очереди, затраты на оценку и операционные накладные расходы на наблюдаемость.

- Задержка и надежность. Отдавайте предпочтение маршрутизации с учетом региона, повторному использованию теплого кэша (оставайтесь у того же провайдера для повторного использования контекста) и точному поведению при сбоях (например, повторная попытка при 429; эскалация при таймаутах).

- Наблюдаемость и управление. Если вам нужны защитные механизмы, журналы аудита и обеспечение политики на границе, шлюз (например, Portkey или Kong AI Gateway) могут быть сильнее, чем чистый агрегатор.

- Самостоятельный хостинг vs управляемый. Предпочитаете Docker/K8s/Helm и совместимые с OpenAI конечные точки? LiteLLM является распространенным выбором OSS; Kong AI Gateway это инфраструктура, которой вы управляете. Предпочитаете хостинговую скорость с прозрачностью в стиле маркетплейса? Смотрите ShareAI, OpenRouter, или Унифицировать.

- Широта за пределами чата. Если дорожная карта охватывает OCR, речь и перевод под одним оркестратором, мультимодальное покрытие, такое как у Eden AI, может упростить доставку.

- Защита на будущее. Отдавайте предпочтение инструментам, которые делают замену провайдера/модели безболезненной (например, динамическая маршрутизация или универсальные API), чтобы вы могли использовать новые, более дешевые или быстрые модели без переписывания.

Лучшие альтернативы Eden AI (быстрый выбор)

ShareAI (наш выбор для прозрачности маркетплейса + экономики разработчиков) — Один API через 150+ моделей с мгновенное переключение и маркетплейс, который отображает ценой/задержкой/временем работы/доступностью перед маршрутизацией. Провайдеры (сообщество или компания) зарабатывают 70% доход, согласуя стимулы с надежностью. Исследуйте: Просмотреть модели • Прочитать документацию • Песочница • Создать ключ API • Руководство для провайдера

OpenRouter — Унифицированный API для многих моделей; маршрутизацию провайдеров и кэширование запросов оптимизируйте стоимость и пропускную способность, повторно используя теплые контексты, где это поддерживается.

Portkey — Шлюзом ИИ с программируемыми резервными механизмами, ограничение скорости плейбуков, и простой/семантический кэш, плюс трассировки/метрики. Отлично подходит для маршрутизации, управляемой политикой, и операций в стиле SRE.

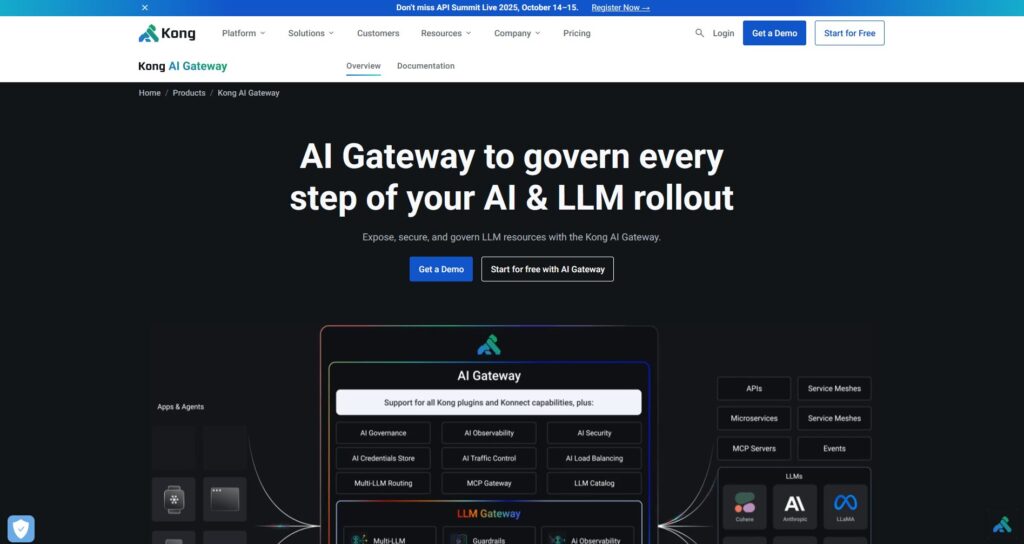

Kong AI Gateway — Управление на границе с AI-плагинами, аналитикой и политикой; хорошо сочетается с агрегаторами, если вам нужен централизованный контроль.

Унифицировать — Маршрутизатор, основанный на данных который оптимизирует стоимость/скорость/качество, используя живую производительность и универсальный API.

Orq.ai — Сотрудничество + LLMOps (эксперименты, оценщики—включая. RAG), развертывания, RBAC/VPC). Хорошо, когда вам нужны эксперименты + управление.

LiteLLM — Прокси/шлюз с открытым исходным кодом с совместимыми с OpenAI конечными точками, бюджеты/ограничения скорости, ведение журнала/метрики и маршрутизация с повторной попыткой/резервированием — развертываемые через Docker/K8s/Helm.

Подробный обзор: лучшие альтернативы

ShareAI (API искусственного интеллекта, управляемый людьми)

Что это. Сеть искусственного интеллекта, ориентированная на провайдеров, и унифицированный API. Просматривайте большой каталог моделей/провайдеров и маршрутизируйте с мгновенное переключение. Торговая площадка отображает цену, задержку, время безотказной работы и доступность заранее. Экономика отправляет 70% расходы поставщикам GPU, которые поддерживают модели онлайн.

Почему команды выбирают его. Прозрачный рынок чтобы сравнить поставщиков перед маршрутизацией, устойчивость по умолчанию через быстрое переключение, и экономика, согласованная с разработчиком. Начните быстро в Песочница, создайте ключи в Консоли и следуйте быстрому старту API.

Факты о провайдерах (зарабатывают, поддерживая модели онлайн). Любой может стать поставщиком (Сообщество или Компания). Подключайтесь через Windows/Ubuntu/macOS или Docker; вносите вклад в периоды простоя или запускайте всегда включен; выбирайте стимулы: Награды (деньги), Обмен (токены/AI Prosumer), или Миссия (пожертвуйте % НПО). По мере масштабирования устанавливайте свои собственные цены на вывод и получайте привилегированное внимание. Смотрите Руководство для провайдера.

Идеально для. Команды продуктов, которые хотят прозрачности рынка, устойчивости и экономики, ориентированной на разработчиков, с легким стартом и возможностью роста до режима поставщика.

OpenRouter

Что это. Единый API для многих моделей с маршрутизацией провайдера/модели и кэширование запросов. Платформа может сохранять запросы на одном поставщике для повторного использования горячих кешей и переключаться на следующий лучший вариант, когда поставщик становится недоступным.

Выдающиеся функции. Маршрутизация с учетом цены и пропускной способности; повторное использование кеша, где это поддерживается.

Предупреждения. Для глубокого управления шлюзами или конвейеров SIEM многие команды используют OpenRouter вместе с Portkey или Kong AI Gateway.

Portkey

Что это. Открытый Платформа для операций с ИИ + шлюз с программируемыми резервные варианты, ограничение скорости стратегии, и простой/семантический кэш, плюс трассировки/метрики.

Выдающиеся функции. Вложенные резервные механизмы и условная маршрутизация; виртуальные ключи и бюджеты; семантическое кэширование, настроенное для коротких запросов и сообщений.

Предупреждения. Больше настроек и управления, чем у чистого агрегатора.

Kong AI Gateway

Что это. Открытый пограничный шлюз который добавляет AI-плагины, управление и аналитику в экосистему Kong. Это инфраструктура — отлично подходит, когда требуется централизованная политика и аудит.

Выдающиеся функции. AI-прокси плагины, шаблоны для проектирования запросов и облачная панель управления через Konnect.

Предупреждения. Ожидайте настройки и обслуживания; используйте с агрегатором, если вам также нужен обзор маркетплейса.

Унифицировать

Что это. A универсальный API с маршрутизацией на основе данных для максимизации стоимость/скорость/качество используя живые метрики; сильный акцент на оценке и сравнительных тестах.

Выдающиеся функции. Динамическая маршрутизация и резервные механизмы; выбор, основанный на сравнительных тестах, обновляемый по регионам и нагрузке.

Предупреждения. Мнение по умолчанию — проверяйте с помощью собственных запросов.

Orq.ai

Что это. A совместная работа с генеративным ИИ платформа: эксперименты, оценщики (включая RAG), развертывания, RBAC/VPC.

Выдающиеся функции. Библиотека Evaluator с метриками RAG (релевантность контекста, достоверность, полнота, устойчивость).

Предупреждения. Более широкая поверхность, чем минимальный “одноточечный” маршрутизатор.

LiteLLM

Что это. Открытый прокси/шлюз с открытым исходным кодом с совместимыми с OpenAI конечными точками, бюджеты/ограничения скорости, логирование/метрики и маршрутизация с повторной попыткой/резервированием. Самостоятельный хостинг через Docker/K8s/Helm.

Выдающиеся функции. Бюджеты и лимиты скорости на проект/API ключ/команду; Административный интерфейс и отслеживание расходов.

Предупреждения. Вы управляете операциями и обновлениями (типично для OSS).

Быстрый старт: вызов модели за минуты (ShareAI)

Начните в Песочница, затем возьмите ключ API и отправьте. Ссылка: быстрому старту API • Главная страница документации • Релизы.

#!/usr/bin/env bash"

// ShareAI — Завершение чата (JavaScript, Node 18+);

Сравнение с первого взгляда

| Платформа | Хостинг / Самостоятельный хостинг | Маршрутизация и резервные варианты | Наблюдаемость | Широта (LLM + за его пределами) | Управление/Политика | Заметки |

|---|---|---|---|---|---|---|

| Eden AI | Хостинг | Переключение провайдеров; пакетная обработка; кэширование; | Мониторинг API и затрат | LLM, OCR, зрение, речь, перевод | Центральное выставление счетов/управление ключами | Используйте свои ключи или кредиты; Токен песочницы; унифицированная конечная точка чата в стиле OpenAI. |

| ShareAI | Хостинг + сеть провайдеров | Мгновенное переключение; маршрутизация, управляемая маркетплейсом | Журналы использования; статистика торговой площадки; | Широкий каталог моделей | Управление провайдерами | Доход 70% для поставщиков; рынок “управляемый людьми”. |

| OpenRouter | Хостинг | Маршрутизация поставщиков/моделей; кэширование запросов. | Информация на уровне запросов; | Ориентированность на LLM | Политики на уровне провайдера | Повторное использование кэша, где поддерживается; резервное решение при недоступности;. |

| Portkey | Хостинг и шлюз | Резервные политики; плейбуки ограничения скорости; простой/семантический кэш. | Трассировки/метрики | LLM-первый | Конфигурации шлюза; | Отлично подходит для контроля и ограничений в стиле SRE. |

| Kong AI Gateway | Самостоятельный хостинг/Корпоративное решение | Маршрутизация вверх по потоку через AI плагины | Метрики/аудит через Kong | LLM-первый | Сильное управление на границе | Инфраструктурный компонент; сочетается с агрегаторами. |

| Унифицировать | Хостинг | Маршрутизатор, основанный на данных, по стоимости/скорости/качеству. | Исследователь эталонов | Ориентированность на LLM | Предпочтения маршрутизатора | Выбор, основанный на тестировании. |

| Orq.ai | Хостинг | Повторные попытки/резервные варианты в оркестрации | Аналитика платформы; оценщики RAG | LLM + RAG + оценки | Опции RBAC/VPC | Сотрудничество и эксперименты. |

| LiteLLM | Самостоятельный хостинг/OSS | Повтор/резерв; бюджеты/лимиты | Логирование/метрики; административный интерфейс | Ориентированность на LLM | Полный контроль инфраструктуры | Совместимые с OpenAI конечные точки. |

Часто задаваемые вопросы

Что такое Eden AI? (“Объяснение Eden AI”)

Eden AI объединяет нескольких поставщиков ИИ за единой API — охватывая LLM-чат, а также зрение/OCR, речь и перевод — и добавляет инструменты, такие как сравнение моделей, мониторинг затрат/API, пакетная обработка и кэширование.

Eden AI бесплатен? Нужна ли подписка? (“Цены Eden AI / бесплатный уровень”)

Eden AI использует оплатой по мере использования ценообразование. Подписка не требуется, и вы можете использовать свои собственные ключи провайдера или приобрести кредиты. Для разработки Песочница токен возвращает фиктивные ответы, чтобы вы могли интегрироваться без затрат.

Поддерживает ли Eden AI BYOK/BYOA?

Да. Вы можете использовать свои собственные учетные записи/ключи поставщиков для поддерживаемых провайдеров и оплачивать их напрямую, либо оплачивать через кредиты Eden.

Умеет ли Eden AI выполнять пакетную обработку, кэширование и мониторинг?

Да — пакетная обработка для больших задач, кэширование API для повторяющихся запросов и мониторинг затрат/API для контроля использования и расходов являются ключевыми частями платформы.

Eden AI против ShareAI: что лучше?

Выберите ShareAI если вы хотите прозрачный рынок который отображает ценой/задержкой/временем работы/доступностью прежде чем вы направите, мгновенное переключение, и экономика, согласованная с разработчиком (70% для поставщиков). Выберите Eden AI если вашему плану развития требуется широкое мультимодальное покрытие (OCR, речь, перевод) под одним API с пакетной обработкой/кэшированием/мониторингом.

Eden AI против OpenRouter: в чем разница?

OpenRouter фокусируется на LLM с маршрутизацией провайдера и кэшированием подсказок, в то время как Eden AI охватывает многомодальные задачи за пределами чата с сравнением моделей, пакетной обработкой, кэшированием и мониторингом. Многие команды сочетают маршрутизатор с шлюзом для управления — или выбирают ShareAI получить прозрачность рынка и устойчивую маршрутизацию в одном месте.

Eden AI против Portkey против Kong AI: маршрутизатор или шлюз?

Portkey и Kong AI Gateway являются шлюзами—отлично подходит для политике/ограничениях (резервные варианты, ограничения скорости, аналитика, управление на уровне периферии). Eden AI является агрегатор/оркестратор для нескольких AI-сервисов. Некоторые стеки используют оба: шлюз для политики на уровне организации и агрегатор для маршрутизации в стиле маркетплейса.

Eden AI против LiteLLM: размещенный или самостоятелный?

Eden AI размещен. LiteLLM является прокси/шлюз с открытым исходным кодом вы развертываете себя с бюджетами/лимитами и совместимой с OpenAI поверхностью. Выбирайте в зависимости от того, хотите ли вы управляемое удобство или полный контроль над инфраструктурой.

Какова хорошая альтернатива Eden AI для строгого управления и изоляции VPC?

Рассмотрите Kong AI Gateway если вам нужна корпоративного уровня, автономно размещенная система управления на границе сети. Вы также можете сочетать шлюз (политика/наблюдаемость) с маршрутизатором в стиле маркетплейса для выбора модели и контроля затрат.

Какой лучший аналог Eden AI, если я хочу разместить его самостоятельно?

LiteLLM является популярным прокси с открытым исходным кодом с совместимыми с OpenAI конечными точками, бюджетами, ограничениями скорости и логированием. Если вы уже используете Kong, Kong AI Gateway внедряет политику ИИ в ваш существующий edge.

Что дешевле для моей рабочей нагрузки: Eden AI, ShareAI, OpenRouter или LiteLLM?

Это зависит от выбора модели, региона, кэшируемости и шаблонов трафика. Агрегаторы, такие как ShareAI и OpenRouter могут снизить затраты за счет маршрутизации и кэширования; шлюзы, такие как Portkey добавляют семантический кэш и плейбуки ограничения скорости; LiteLLM снижает накладные расходы платформы, если вы готовы управлять собственным прокси. Тестируйте с вашими запросами и отслеживайте эффективную стоимость за результат — не только цену токена.

Как мне перейти с Eden AI на ShareAI с минимальными изменениями кода?

Сопоставьте свои модели с эквивалентами ShareAI, отразите формы запросов/ответов и начните за флагом функции. Сначала направьте небольшой процент трафика, сравните задержку/стоимость/качество, затем увеличьте. Если вы также управляете шлюзом, убедитесь, что кэширование/резервные механизмы не срабатывают дважды между слоями.

Почему ShareAI часто выигрывает как “альтернатива Eden AI”

Если ваш приоритет — выбор правильного провайдера перед маршрутизацией—факторинг цену, задержку, время безотказной работы и доступность—Обзор рынка ShareAI трудно превзойти. Он сочетает прозрачный выбор с мгновенное переключение, затем выравнивает стимулы, возвращая 70% расходы провайдерам, которые поддерживают модели в сети. Для платформенных команд эта комбинация снижает неожиданности, стабилизирует SLA и позволяет вам зарабатывать быть провайдером, когда ваши GPU простаивают (Вознаграждения, Токены обмена или Пожертвования на миссию).

Следующие шаги: Просмотреть модели • Открыть песочницу • Создайте свой API-ключ • Войти или зарегистрироваться.