RouteLLM Alternatifleri 2026: ShareAI'yi Ne Zaman Seçmeli (ve Başka Neleri Düşünmeli)

Güncellendi Mart 2026

Geliştiriciler seçiyor RouteLLM istemleri daha ucuz modellere yönlendirirken neredeyse GPT-4 kalitesini hedeflemek—özellikle öğrenilmiş bir yönlendiricinin güvenle düşürebileceği benchmark benzeri görevler için. Ancak, daha çok önemsiyorsanız her yönlendirme öncesinde pazar yeri şeffaflığı (canlı fiyat, gecikme, çalışma süresi, kullanılabilirlik), birden fazla sağlayıcı arasında anında yedekleme, uç politika ve denetim, veya bir kendi kendine barındırılan proxy/geçit, bu RouteLLM alternatifleri yığınınıza daha iyi uyabilir.

Bu alıcı rehberi, bir yapıcı gibi yazılmıştır: belirli ödünleşimler, hızlı seçimler, derinlemesine incelemeler, yan yana karşılaştırmalar ve bugün gönderebilmeniz için kopyala-yapıştır ShareAI hızlı başlangıcı.

RouteLLM'yi anlamak (ve nerede uygun olmayabileceğini)

RouteLLM nedir. RouteLLM, LLM yönlendiricilerini sunmak ve değerlendirmek için açık kaynaklı bir çerçevedir. OpenAI uyumlu bir istemci/sunucu olarak kolayca entegre edilebilir ve daha basit sorguları daha ucuz modellere yönlendirebilen eğitimli yönlendirme modelleri sunar—yaygın benchmarklarda (~MT-Bench gibi) GPT-4 performansının ~'ini korurken maliyetin 'e kadar azaltıldığı bildirilmiştir.

Ekiplerin bunu seçme nedeni.

- Maliyet odaklı yönlendirme araştırma destekli politikalarla.

- Açık kaynak ve Python'da genişletilebilir.

- OpenAI-uyumlu ağır SDK yeniden yazımları olmadan deneme yönlendirme yolu.

RouteLLM'in uygun olmayabileceği yerler.

- İstiyorsunuz canlı pazar yeri şeffaflığı (fiyat, gecikme, çalışma süresi, kullanılabilirlik) her rota öncesinde—sadece öğrenilmiş bir politika değil.

- İhtiyacınız var çok sağlayıcılı yedekleme

- Yol haritanız şunları kapsar çok modlu API'ler OCR, konuşma, çeviri ve belge ayrıştırma gibi her şey tek bir çatı altında.

Bir RouteLLM alternatifini nasıl seçersiniz

- Sahip Olma Toplam Maliyeti (TCO). $/1K token ile durmayın. Önbellek isabet oranlarını, yeniden denemeleri/yedeklemeleri, sıralamayı, değerlendirici maliyetlerini ve günlükler/uyarılar için operasyonel yükü sayın. Anlamsal önbelleğe sahip önbellek farkında yönlendiriciler ve ağ geçitleri, “daha pahalı liste fiyatını” pratikte daha ucuz hale getirebilir.

- Gecikme ve güvenilirlik. Bölge farkında yönlendirmeyi, önbellek sıcakken sağlayıcıya bağlılığı ve kesin yedeklemeleri (429'ları yeniden dene, zaman aşımında yükselt) tercih edin. Sıcak bağlamlar için sizi aynı sağlayıcıda tutan ve bir sağlayıcıda kesinti olduğunda yedekleme yapan barındırılan yönlendiriciler genellikle kazanır.

- Gözlemlenebilirlik ve yönetim. Eğer koruma önlemleri, redaksiyon, denetim günlükleri ve uçta politika önemliyse, bir AI ağ geçidi (Portkey veya Kong AI Gateway) genellikle yalnızca bir yönlendiriciden daha güçlüdür. Birçok ekip yönlendirici + ağ geçidini birleştirir.

- Kendin barındır vs. yönetilen. Docker/K8s/Helm ve OpenAI uyumlu bir proxy mi tercih ediyorsunuz? LiteLLM'i deneyin. Barındırılan hız + pazar yeri görünürlüğü mü istiyorsunuz? ShareAI veya OpenRouter'ı düşünün.

- Sohbetin ötesinde genişlik. LLM sohbetinin yanında OCR, konuşma, çeviri veya belge ayrıştırmaya ihtiyacınız varsa, Eden AI gibi çok modlu bir düzenleyici yardımcı olur.

- Veri odaklı yönlendirme. Bölgeye veya iş yüküne göre maliyet/hız/kaliteyi yönlendirmek için canlı karşılaştırmaları tercih ediyorsanız, Unify'ı değerlendirin.

En iyi RouteLLM alternatifleri (hızlı seçimler)

ShareAI (pazar yeri şeffaflığı + yapıcı ekonomiler için bizim seçimimiz)

Anında yedekleme ve yüzeye çıkan bir pazar yeri ile geniş bir model/sağlayıcı kataloğu üzerinde tek bir API fiyat, gecikme, çalışma süresi, kullanılabilirlik yönlendirmeden önce. Hızlı başlayın Playground'da, anahtarları alın Konsol, göz atın Belgeler, ve seçenekleri karşılaştırın Modeller.

Eden AI (çok modlu düzenleyici)

LLM'ler arasında birleşik API artı görüntü, OCR/belge ayrıştırma, konuşma ve çeviri—model karşılaştırma, izleme, önbellekleme ve toplu işleme ile birlikte.

OpenRouter (önbellek farkında yönlendirme)

Birçok LLM üzerinde barındırılan yönlendirici, istem önbellekleme ve sağlayıcı bağlılığı ile sıcak bağlamları yeniden kullanır; bir sağlayıcı kullanılamadığında geri döner.

Portkey (geçit politikası ve SRE operasyonları)

Programlanabilir geri dönüşler, hız sınırı oyun kitapları ve anlamsal önbellek ile AI geçidi—artı üretim kontrolü için ayrıntılı izler/metrikler.

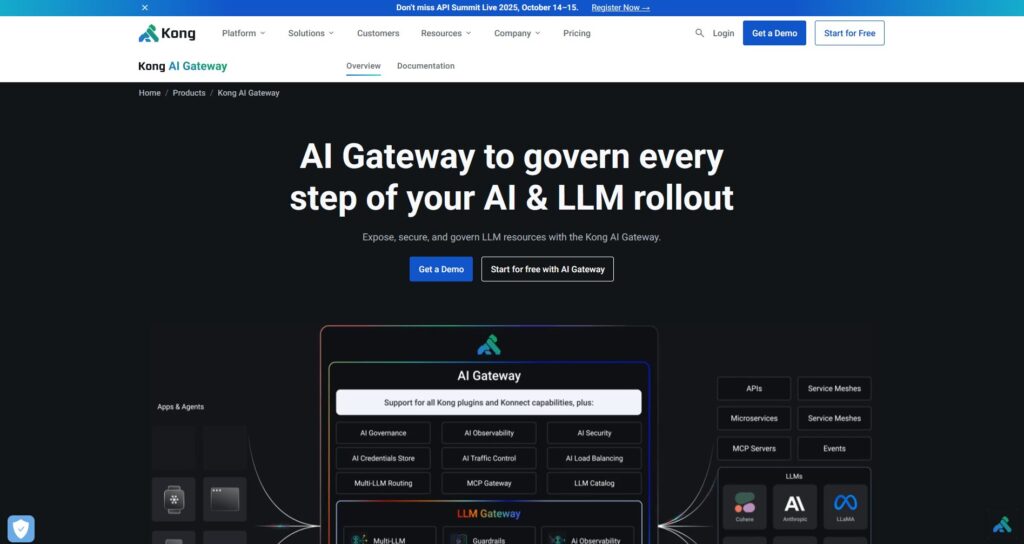

Kong AI Gateway (uç yönetimi ve denetim)

Kong ekosistemine AI eklentileri, politika ve analizler getirin; ekipler arasında merkezi kenar kontrollerine ihtiyaç duyduğunuzda güçlü bir uyum sağlar.

Birleştir (veri odaklı yönlendirici)

Bölge ve iş yüküne göre maliyet/hız/kaliteyi optimize etmek için canlı karşılaştırmalarla evrensel API.

Orq.ai (deneyler ve LLMOps)

Deneyler, değerlendiriciler (RAG metrikleri dahil), dağıtımlar ve RBAC/VPC—değerlendirme ve yönetimin bir arada olması gerektiğinde harika.

LiteLLM (kendi kendine barındırılan proxy/geçit)

Bütçeler/sınırlamalar, günlük kaydı/metrikler ve bir Yönetici UI ile açık kaynaklı, OpenAI uyumlu proxy. Docker/K8s/Helm ile dağıtın; operasyonlar size ait.

Derinlemesine incelemeler: en iyi RouteLLM alternatifleri

ShareAI (İnsan Gücüyle Çalışan AI API'si)

Ne olduğunu. Sağlayıcı odaklı bir AI ağı ve birleşik API. Büyük bir model/sağlayıcı kataloğunu gözden geçirin ve anında hata toleransı ile yönlendirin. Pazar yeri fiyat, gecikme, çalışma süresi ve kullanılabilirliği tek bir yerde gösterir, böylece her yönlendirme öncesinde doğru sağlayıcıyı seçebilirsiniz. Başlayın Playground'da, anahtarlar oluşturun Konsol, ve API hızlı başlangıcını takip edin Belgeler. Göz atın Model Pazarı.

- Pazar yeri şeffaflığı — fiyat/gecikme/çalışma süresi/kullanılabilirliği önceden görün.

- Varsayılan olarak dayanıklılık — bir sağlayıcıda kesinti olduğunda bir sonraki en iyi sağlayıcıya hızlı geçiş.

- Yapıcıya uyumlu ekonomi — harcamaların çoğu modelleri çevrimiçi tutan GPU sağlayıcılarına akar.

- Sürtünmesiz başlangıç — Playground'da test edin, ardından gönderin.

Sağlayıcı gerçekleri (modelleri çevrimiçi tutarak kazanın). Herkes bir sağlayıcı olabilir (Topluluk veya Şirket). Windows/Ubuntu/macOS veya Docker üzerinden katılın. Boş zaman patlamalarını katkıda bulunun veya her zaman açık çalıştırın. Teşvikleri seçin: Ödüller (para), Takas (tokenler/AI Prosumer) veya Misyon (NGO'lara %1 bağış yapın). Görün Sağlayıcı Kılavuzu veya açın Sağlayıcı Panosu.

İçin ideal. Pazar yeri şeffaflığı, dayanıklılık ve sağlayıcı moduna geçiş için büyüme alanı isteyen ürün ekipleri—satıcıya bağımlı olmadan.

Eden AI

Ne olduğunu. LLM'ler + görüntü oluşturma + OCR/belge ayrıştırma + konuşma + çeviri gibi alanları kapsayan birleşik bir API, böylece birden fazla satıcı SDK'sını birleştirmenize gerek kalmaz. Ayrıca model karşılaştırması, izleme ve toplu işlemeye vurgu yaparlar.

Uygun olduğunda. Yol haritanız çok modlu ve LLM sohbetinin yanında OCR/konuşma/çeviriyi düzenlemek istiyorsunuz.

Dikkat edilmesi gerekenler. Eğer bir şeye ihtiyacınız varsa talep başına pazar yeri görünümü (fiyat/gecikme/süreklilik/kullanılabilirlik) veya sağlayıcı düzeyinde ekonomi için, ShareAI gibi bir pazar yeri yönlendiricisi eşleştirin.

OpenRouter

Ne olduğunu. Sağlayıcı/model yönlendirme ile birleşik bir LLM yönlendirici. istem önbellekleme. Önbellek etkinleştirildiğinde, OpenRouter genellikle sıcak bağlamları yeniden kullanmak için sizi aynı sağlayıcıda tutar; eğer o sağlayıcı kullanılamazsa, yedek bir sağlayıcıya geçer. Ayrıca strateji ipuçlarını destekler (örneğin, fiyat ağırlıklı).

Uygun olduğunda. Özellikle yüksek QPS sohbet iş yüklerinde tekrarlayan istemlerle maliyeti düşürmek ve verimi artırmak için barındırılan hız ve önbellek farkındalığına sahip yönlendirme istiyorsunuz.

Dikkat edilmesi gerekenler. Derin kurumsal yönetim (SIEM dışa aktarımları, organizasyon genelinde politika) için birçok ekip OpenRouter'ı Portkey veya Kong AI Gateway ile eşleştirir.

Portkey

Ne olduğunu. Programlanabilir yedekler, hız sınırı oyun planları ve basit/semantik önbellek ile bir AI geçidi, ayrıca SRE tarzı kontrol için izler/metrikler. Semantik önbellek, özellikle benzerlik eşikleri iyi ayarlandığında kısa istemler/mesajlar için oldukça faydalıdır.

Uygun olduğunda. Birinci sınıf gözlemlenebilirlik ile politika odaklı yönlendirmeye ihtiyacınız var ve bir veya daha fazla yönlendirici/pazar yerinin önünde bir geçit katmanı işletmekte rahatsınız.

Kong AI Gateway

Ne olduğunu. AI eklentilerini, politikayı ve analitiği Kong ekosistemine (Konnect veya kendi kendine yönetilen yoluyla) getiren bir uç geçit. API platformunuz zaten Kong etrafında dönüyorsa ve merkezi politika/denetim ihtiyacınız varsa, bu güçlü bir uyum sağlar.

Uygun olduğunda. Uç yönetimi, denetlenebilirlik, veri yerleşimi ve merkezi kontroller ortamınızda vazgeçilmezdir.

Birleştir

Ne olduğunu. Canlı karşılaştırmaları kullanarak maliyet/hız/kaliteyi optimize eden, bölgeye ve iş yüküne göre ayarlama yapan veri odaklı bir yönlendirici.

Uygun olduğunda. Gerçek dünya performansına sürekli uyum sağlayan karşılaştırma rehberli seçim istiyorsunuz.

Orq.ai

Ne olduğunu. Bir üretken AI iş birliği + LLMOps platformu: deneyler, değerlendiriciler (RAG metrikleri dahil), dağıtımlar ve RBAC/VPC. Değerlendirme ve yönetimin bir arada olması gerektiğinde harika.

Uygun olduğunda. Deney ve değerlendirme süreçlerini yönetişimle bir arada yapmanız gerekiyor—ardından aynı yüzeyden doğrudan dağıtım yapın.

LiteLLM

Ne olduğunu. OpenAI uyumlu uç noktalar, bütçeler ve hız sınırları, günlük/kriterler ve bir Yönetici UI ile açık kaynaklı bir proxy/geçit. Docker/K8s/Helm ile dağıtın; trafiği kendi ağınızda tutun.

Uygun olduğunda. Popüler OpenAI tarzı SDK'larla kolay uyumluluk sağlayarak kendi barındırma ve tam altyapı kontrolü istiyorsunuz.

Dikkat edilmesi gerekenler. Herhangi bir OSS geçidi gibi, operasyonlar ve yükseltmeler sizin sorumluluğunuzda.

Hızlı başlangıç: bir modeli dakikalar içinde çağırın (ShareAI)

Başlayın Playground'da, ardından bir API anahtarı alın ve gönderin. Referanslar: API hızlı başlangıç • Belgeler Ana Sayfası • Sürümler.

#!/usr/bin/env bash"

// ShareAI — Sohbet Tamamlamaları (JavaScript, Node 18+);

Geçiş ipucu. Mevcut RouteLLM seçili modellerinizi ShareAI eşdeğerlerine eşleyin, istek/yanıt şekillerini yansıtın ve bir özellik bayrağı arkasında başlayın. Önce trafiğin %5–10'unu gönderin, gecikme/maliyet/kaliteyi karşılaştırın, ardından artırın. Ayrıca bir geçit (Portkey/Kong) çalıştırıyorsanız, katmanlar arasında önbellekleme/yedeklemelerin çift tetiklenmediğinden emin olun.

Bir bakışta karşılaştırma

| Platform | Barındırılan / Kendi kendine barındırma | Yönlendirme ve Yedekleme | Gözlemlenebilirlik | Genişlik (LLM + ötesi) | Yönetim / Politika | Notlar |

|---|---|---|---|---|---|---|

| RouteLLM | OSS | Öğrenen yönlendirici; OpenAI uyumlu istemci/sunucu | CLI/günlükler; araştırma odaklı | LLM-merkezli | Altyapınız üzerinden politika | Araştırma düzeyinde maliyet tasarrufları için harika; kendi uç kontrolünüzü getirin. |

| ShareAI | Barındırılan + sağlayıcı ağı | Anında yedekleme; pazar rehberli seçim | Kullanım günlükleri; pazar yeri istatistikleri | Geniş model kataloğu | Sağlayıcı düzeyinde kontroller | İnsan Gücüyle Çalışan pazar yeri; ile başlayın Playground'da ve Modeller. |

| Eden AI | Barındırılan | Sağlayıcıları değiştir; toplu; önbellekleme | Maliyet ve API izleme | LLM + görüntü + OCR + konuşma + çeviri | Merkezi faturalama/anahtar yönetimi | Çok modlu düzenleyici. |

| OpenRouter | Barındırılan | Sağlayıcı/model yönlendirme; istem önbelleği; sağlayıcı bağlılığı | İstek düzeyinde bilgi | LLM-merkezli | Sağlayıcı politikaları | Önbellek yeniden kullanımı; kullanılabilirlik olmadığında geri dönüş. |

| Portkey | Barındırılan Ağ Geçidi | Politika geri dönüşleri; hız sınırı oyun kitapları; anlamsal önbellek | İzler/metrikler | LLM-öncelikli | Ağ geçidi yapılandırmaları | SRE tarzı koruma önlemleri. |

| Kong AI Gateway | Kendi kendine barındırma/Enterprise | AI eklentileri aracılığıyla yukarı akış yönlendirme | Kong aracılığıyla metrikler/denetim | LLM-öncelikli | Güçlü uç yönetimi | Altyapı bileşeni; yönlendiriciler/pazar yerleri ile eşleşir. |

| Birleştir | Barındırılan | Maliyet/hız/kaliteye göre veri odaklı yönlendirme | Karşılaştırma keşfi | LLM-merkezli | Yönlendirici politikaları | Kıyaslama rehberli seçim. |

| Orq.ai | Barındırılan | Orkestrasyonda yeniden denemeler/yedekler | Platform analitiği; RAG değerlendiriciler | LLM + RAG + değerlendirmeler | RBAC/VPC seçenekleri | İş birliği ve deney odaklılık. |

| LiteLLM | Kendi kendine barındırma/OSS | Yeniden deneme/yedekleme; bütçeler/sınırlamalar | Günlük kaydı/metrikler; Yönetici UI | LLM-merkezli | Tam altyapı kontrolü | OpenAI-uyumlu; Docker/K8s/Helm dağıtımı. |

SSS: RouteLLM ve diğerleri

RouteLLM ve ShareAI — hangisi daha iyi?

Seç ShareAI şeffaf bir pazar yeri istiyorsanız, ortaya çıkaran gecikme/süreklilik/kullanılabilirlik her rota öncesinde, artı anında yedekleme ve yapıcıya uyumlu ekonomi. Seç RouteLLM eğer araştırma odaklı, öğrenilmiş bir yönlendirici tercih ediyorsanız ve çevresindeki altyapıyı (geçitler, günlük kaydı, denetim) işletmekte rahatsanız. Şununla başlayın Playground'da ve Model Pazarı.

RouteLLM vs Eden AI — fark nedir?

Eden AI LLM'leri kapsar ve karşılaştırma ve izleme ile çok modlu (görsel/OCR, konuşma, çeviri). RouteLLM LLM'ler için öğrenilmiş yönlendirmeye odaklanır. Yol haritanız tek bir API altında OCR/konuşma/çeviri gerektiriyorsa, Eden AI teslimatı basitleştirir; yönlendirme araştırması öncelikliyse, RouteLLM uygundur. Her istek için pazar yeri şeffaflığı istediğinizde ShareAI ile eşleştirin.

RouteLLM vs OpenRouter — her birini ne zaman seçmeli?

Seç OpenRouter ne zaman istem önbellekleme ve sıcak önbellek yeniden kullanımı önemlidir (bu genellikle sizi aynı sağlayıcıda tutar ve kesintilerde geri döner). Seç RouteLLM kendi işlettiğiniz öğrenilmiş politikalar için. Birçok yığın, politika/gözlemlenebilirlik için bir geçit ile OpenRouter'ı eşleştirir—ve yine de her rota öncesinde pazar yeri şeffaflığı istediklerinde ShareAI kullanır.

RouteLLM vs Portkey — yönlendirici mi yoksa geçit mi?

RouteLLM bir yönlendiricidir. Portkey bir geçit: politika/kılavuzlar (geri dönüş planları, anlamsal önbellek) ve ayrıntılı izler/metriklerde mükemmeldir. Birçok ekip her ikisini de çalıştırır: model seçimi ve maliyet kontrolü için bir yönlendirici/pazar yeri + organizasyon genelinde politika için bir geçit. Ön rota pazar yeri görünürlüğü istediğinizde ShareAI burada iyi bir eşleşme sağlar.

RouteLLM vs Kong AI Gateway — kim hangisine ihtiyaç duyar?

Seç Kong AI Gateway ne zaman uç yönetimi (merkezi politika/denetim, veri yerleşimi) tartışılmazdır. Şunu koruyun RouteLLM fiyat/performans için hala öğrenilmiş yönlendirme istiyorsanız bunun arkasında. Kullanın ShareAI sağlayıcıları seçmek istediğinizde yanında gecikme/süreklilik/kullanılabilirlik her rotadan önce.

RouteLLM vs Unify — Unify'i benzersiz kılan nedir?

Birleştir optimize etmek için canlı karşılaştırmalar ve dinamik politikalar kullanır maliyet/hız/kalite için. Bölge/yük tarafından gelişen veri odaklı seçim istiyorsanız, Unify etkileyicidir; RouteLLM barındırdığınız öğrenilmiş yönlendirme modellerine odaklanır. Kullan ShareAI sağlayıcıları bir pazar görünümü ve anında yedekleme ile seçmeyi tercih ettiğinizde.

RouteLLM vs Orq.ai — değerlendirme ve RAG için hangisi?

Orq.ai deney/ değerlendirme yüzeyi sağlar (RAG değerlendiriciler dahil), ayrıca dağıtımlar ve RBAC/VPC. LLMOps + değerlendiricilere ihtiyacınız varsa, Orq.ai saf bir yönlendiriciyi erken aşamada tamamlayabilir veya değiştirebilir. Getir ShareAI üretimde pazar şeffaflığı ve dayanıklılık ile sağlayıcı seçimi istediğinizde.

RouteLLM vs LiteLLM — barındırılan mı yoksa kendi barındırdığınız mı?

RouteLLM OSS yönlendirme mantığıdır; LiteLLM bütçeler, hız sınırları ve bir Yönetici UI ile OpenAI uyumlu bir proxy/geçittir—trafiği VPC'nizin içinde tutmak ve kontrol düzlemini sahiplenmek istiyorsanız harikadır. Ekipler genellikle LiteLLM'yi kendi barındırma için ShareAI sağlayıcılar arasında pazar görünürlüğü ve anında yedekleme için birleştirir.

İş yüküm için en ucuzu hangisi: RouteLLM, ShareAI, OpenRouter, LiteLLM?

Model seçimine, bölgeye, önbelleğe alınabilirliğe ve trafik desenlerine bağlıdır. Router'lar gibi ShareAI/OpenRouter yönlendirme ve önbellek farkındalığı ile maliyeti azaltabilir; geçitler gibi Portkey anlamsal önbellekleme ekleyin; LiteLLM işletim platformu yükünü azaltır, eğer bunu çalıştırmaktan rahatsanız. Şununla karşılaştırın altyapınız istemleri ve izlemeleri sonuç başına etkili maliyet—sadece liste fiyatı değil.

RouteLLM nedir?

LLM router'larını sunmak ve değerlendirmek için açık kaynaklı bir çerçeve; eğitilmiş router'lar ve OpenAI uyumlu yollar sunar; MT-Bench benzeri görevlerde maliyeti önemli ölçüde azaltırken GPT-4'e yakın kaliteyi koruduğu sıkça belirtilir.

ShareAI'yi tam bir entegrasyon olmadan denemenin en hızlı yolu nedir?

Açın Playground'da, bir model/sağlayıcı seçin ve istemleri tarayıcıda çalıştırın. Hazır olduğunda, bir anahtar oluşturun ve yukarıdaki cURL/JS parçacıklarını uygulamanıza bırakın.

ShareAI sağlayıcısı olabilir ve kazanç elde edebilir miyim?

Evet. Herkes Topluluk veya Şirket Windows/Ubuntu/macOS veya Docker kullanarak sağlayıcı. Katkıda bulunun boş zaman patlamaları veya çalıştırın her zaman açık. Teşvikleri seçin: Ödüller (para), Takas (tokenler/AI Tüketici), veya Misyon seçin (NGO'lara %1 bağış yapın). Şuraya bakın Sağlayıcı Kılavuzu veya açın Sağlayıcı Panosu.

Sonuç

İken RouteLLM güçlü bir OSS router'dır, en iyi seçiminiz önceliklere bağlıdır:

- Pazar yeri şeffaflığı + dayanıklılık: ShareAI

- Tek bir API altında çok modlu kapsama: Eden AI

- Barındırılan formda önbellek farkındalığı yönlendirme: OpenRouter

- Uçta politika/kılavuzlar: Portkey veya Kong AI Gateway

- Veri odaklı yönlendirme: Birleştir

- LLMOps + değerlendiriciler: Orq.ai

- Kendinden barındırılan kontrol düzlemi: LiteLLM

Eğer gecikme/süreklilik/kullanılabilirlik her rota öncesinde, anında yedekleme, ve oluşturucuya uyumlu ekonomi kontrol listenizde varsa, açın Playground'da, bir API anahtarı oluşturun, ve göz atın Model Pazarı bir sonraki isteğinizi akıllı bir şekilde yönlendirmek için.