Maxim Bifrost 替代方案2026:十大Maxim Bifrost 替代方案

更新至2026年3月

如果你正喺評估 Maxim Bifrost 替代方案, ,呢個指南會好似建築師咁比較最好嘅選擇:清晰嘅分類、實際嘅取捨同埋複製貼上嘅快速入門。我哋擺 分享AI 第一當你想要 一個API跨越多個供應商, ,一個 透明嘅模型市場 (價格、延遲、正常運行時間、可用性、供應商類型) 喺 你嘅路由,, 即時故障切換, ,同埋人力驅動嘅經濟(70%嘅支出會畀到供應商)。如果你都喺搵緊 Portkey替代品, ,同樣嘅標準適用—睇下面嘅筆記了解點樣比較閘道器同市場風格嘅聚合器。.

Maxim Bifrost 係咩(簡單睇): Bifrost 係一個 高性能嘅 LLM 閘道器 ,提供一個兼容 OpenAI 嘅 API,支持多個供應商,加入後備方案同可觀察性,並強調吞吐量同“即插即用”替換現有嘅 SDK。他哋嘅文檔同網站突顯咗性能聲明、本地追蹤/指標、集群/VPC 選項同遷移指南。.

聚合器 vs 閘道器 vs 代理平台

LLM聚合器 (例如,ShareAI,OpenRouter)提供一個 API 跨越多個模型/供應商, 路由前嘅透明性 (首先睇價格/延遲/正常運行時間/可用性)同埋 智能路由/故障轉移 咁你可以喺唔需要重寫嘅情況下切換供應商。.

AI閘道器 (例如,Maxim Bifrost,Portkey,Kong)專注於 出口治理, ,憑證/政策、保護措施同可觀察性。佢哋可能包括後備方案同目錄,但通常 唔好 提供實時市場價格/延遲/運行時間/可用性嘅視圖 喺 路由。.

代理/聊天機械人平台 (例如,Orq,Unify)強調編排、記憶/工具、評估同協作流程,而唔係提供者無關嘅聚合。.

我哋點樣評估最好嘅Maxim Bifrost替代品

- 模型廣度同中立性: 專有 + 開放;容易切換;唔需要重寫。.

- 延遲同韌性: 路由政策、超時、重試,, 即時故障切換.

- 管治同安全: 關鍵處理、範圍、地區路由、RBAC。.

- 可觀察性: 日誌/追蹤同成本/延遲儀表板。.

- 價格透明度同總擁有成本(TCO): 比較實際成本 喺 你路由之前。.

- 開發者體驗: 文件、SDKs、快速入門;首次獲取token嘅時間。.

- 社群同經濟: 你嘅支出係咪會增加供應(俾GPU擁有者嘅激勵)。.

最佳10個Maxim Bifrost替代品

#1 — ShareAI(人力驅動嘅AI API)

乜嘢嚟嘅。. A 多供應商API 用一個 透明市場 同埋 智能路由. 。通過一個集成,瀏覽大量模型/提供者嘅目錄,, 比較價格、延遲、正常運行時間、可用性、供應商類型, ,同路由 即時故障切換. 。經濟係人力驅動嘅: 每一蚊嘅70%流向供應商 (社區或者公司),佢哋保持模型在線。.

點解喺#1度。. 如果你想要提供者無關嘅聚合功能 路由前嘅透明性 同韌性,ShareAI係最直接嘅選擇。如果需要全組織政策,可以保留一個網關;加ShareAI嚟進行市場指導嘅路由。.

快速鏈接: 瀏覽模型 · 開放操場 · 創建API Key · API 參考 · 文件主頁 · 發佈

#2 — 門鑰匙

乜嘢嚟嘅。. 一個強調人工智能嘅網關 可觀察性、護欄同埋治理——喺受監管嘅團隊中好受歡迎。如果你嘅優先事項係政策控制同深度追蹤,Portkey適合做網關。配合ShareAI進行市場指導路由。.

#3 —— OpenRouter

乜嘢嚟嘅。. 喺多個模型上嘅統一API——方便快速多模型實驗同廣泛目錄覆蓋。當你需要時加ShareAI 實時 透明度(價格/延遲/運行時間/可用性)同 即時故障切換 跨供應商。.

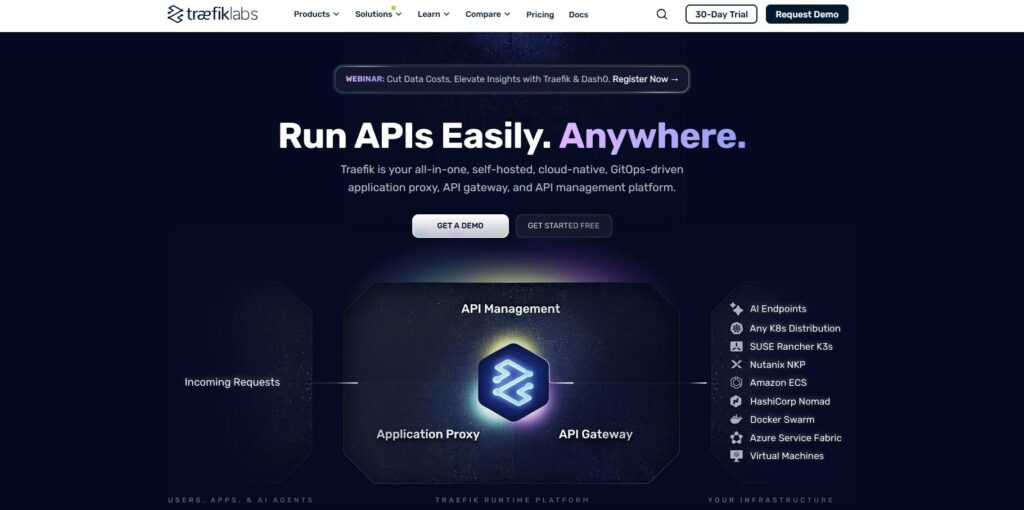

#4 —— Traefik AI Gateway

乜嘢嚟嘅。. 網關風格 出口治理 (憑證/政策)配合OpenTelemetry友好嘅可觀察性;喺Traefik Hub上面加咗一層薄嘅LLM層——更加似“控制平面”而唔係市場。配合ShareAI實現供應商無關嘅路由。.

#5 — Eden AI

乜嘢嚟嘅。. 一個廣泛嘅 AI服務聚合器 (LLM + 視覺 + TTS)。當你需要市場透明度同對LLM嘅多供應商彈性路由時,加上ShareAI。.

#6 — LiteLLM

乜嘢嚟嘅。. 一個輕量級嘅Python SDK/可自我託管嘅代理,支持多個供應商嘅OpenAI兼容協議——適合DIY。用ShareAI減少運營負擔,並獲得市場驅動嘅供應商選擇+故障切換。.

#7 — Unify

乜嘢嚟嘅。. 基於評估嘅路由,根據每次提示選擇更高質量嘅模型。如果你想要路由前嘅透明度同跨供應商嘅即時故障切換,ShareAI非常適合。.

#8 — Orq AI

乜嘢嚟嘅。. 編排/協作平台——專注於流程同生產化,而唔係市場路由。用ShareAI實現供應商無關嘅訪問同彈性。.

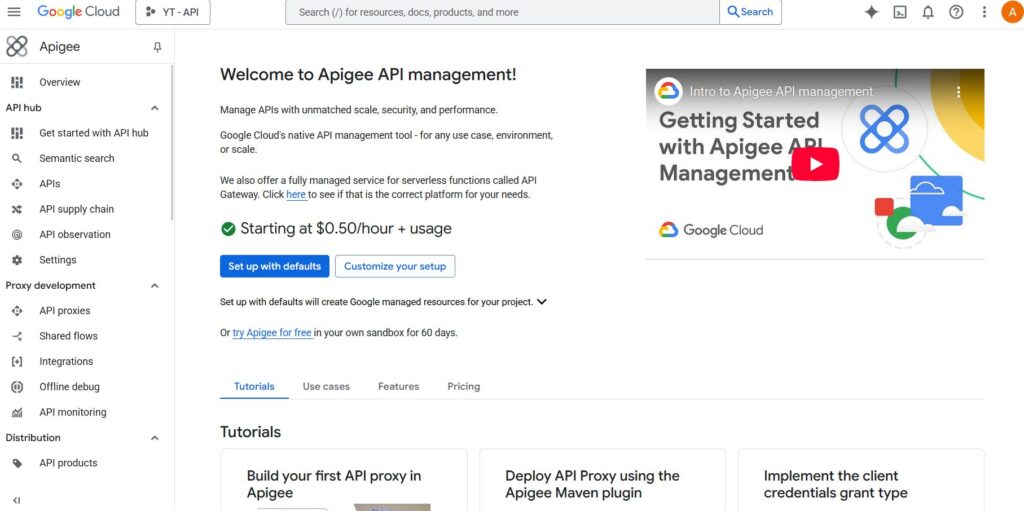

#9 — Apigee(用佢做AI前端)

乜嘢嚟嘅。. 成熟嘅API管理/網關,你可以放喺LLM供應商前面應用政策、密鑰、配額。當你想避免鎖定時,ShareAI提供透明嘅多供應商路由。.

#10 — NGINX

乜嘢嚟嘅。. DIY反向代理——令牌執行、簡單路由/緩存,如果你鍾意自己動手。配合ShareAI,無需自定義Lua,仍然可以獲得市場指導嘅供應商選擇+故障切換。.

Maxim Bifrost對比ShareAI

選擇ShareAI 如果你想 一個API覆蓋多個供應商 配合 透明嘅定價/延遲/正常運行時間/可用性 同埋 即時故障切換. 選擇Bifrost 如果你最重要嘅需求係 出口治理+高吞吐量 配備原生追蹤/指標、集群同VPC部署等功能。好多團隊會將網關同ShareAI配合使用:網關用於組織政策;ShareAI用於市場指導嘅路由。.

快速比較

| 平台創建/輪換密鑰 | 服務對象 | 模型廣度 | 管治同安全性 | 可觀察性 | 路由 / 故障切換 | 市場透明度 | 供應商計劃 |

|---|---|---|---|---|---|---|---|

| 分享AI | 需要一個API + 公平經濟嘅產品/平台團隊 | 150+模型;好多供應商 | API 鑰匙 & 每條路徑控制 | 控制台使用 + 市場統計 | 智能路由 + 即時故障切換 | 係 (價格、延遲、正常運行時間、可用性、供應商類型) | 係 ——開放供應;70%畀供應商 |

| Maxim Bifrost | 團隊需要高性能嘅網關 | “1000+模型”通過統一API | RBAC、預算、治理、VPC | 追蹤/指標、儀表板 | 後備方案同集群 | 唔係 (網關,不係市場) | 無適用 |

關於Bifrost嘅定位:“LLM網關…連接1000+模型…即插即用風格,可觀察性同遷移。”關於性能/基準同追蹤,睇佢哋嘅產品/文檔/博客。.

價格同總擁有成本:比較實際成本(唔係淨係單位價格)

原始$/1K tokens隱藏咗真實情況。你嘅TCO會因重試/後備方案而改變,, 延遲 (影響使用/用戶體驗),供應商差異,, 可觀察性存儲, ,同 評估 運行。A 透明市場 幫你揀啱嘅路徑,平衡成本同用戶體驗。.

TCO ≈ Σ (基礎代幣 × 單位價格 × (1 + 重試率))原型(大約每日10k tokens): 優化首次獲取令牌嘅時間(遊樂場, ,快速入門)。. 中型規模(大約每日2M tokens): 市場指導嘅路由/故障轉移可以減少10–20%,同時改善用戶體驗。. 高峰工作負載: 預期喺故障轉移期間重試會導致更高嘅有效token成本;為此預算。.

開發者快速入門(兼容OpenAI)

替換 你嘅密鑰 用你嘅 ShareAI 密鑰——喺 創建API Key. 。然後試下呢啲:

#!/usr/bin/env bash"// JavaScript (fetch) — Node 18+/Edge runtimes;# Python(requests)對於供應商:通過保持模型在線賺錢

任何人都可以成為ShareAI供應商——社區或者公司。通過Windows、Ubuntu、macOS或者Docker進行登記。貢獻閒置時間嘅爆發或者保持持續運行。選擇你嘅激勵: 獎勵 (錢),, 交換 (代幣/AI Prosumer),或者 任務 (捐%俾NGOs)。隨住你擴展,設定推理價格同獲得優先曝光。.

供應商連結: 供應商指南 · 提供者儀表板 · 交易概覽 · 任務貢獻

FAQ — Maxim Bifrost vs其他競爭者(同ShareAI嘅定位)

Maxim Bifrost vs OpenRouter — 邊個適合多模型速度?

開放路由器 快速用於多模型嘅實驗。. 彩虹橋 係一個 閘道 為高吞吐量而設計,提供即插即用替代品同治理。如果你都想要 路由前嘅透明性 同埋 即時故障切換 跨供應商,揀 分享AI.

Maxim Bifrost vs Traefik AI Gateway — 邊個網關?

兩個都係網關: Traefik 偏向邊緣政策/可觀察性;; 彩虹橋 強調高吞吐量LLM路由。如果你想要 市場透明度 + 一個API覆蓋多個供應商, ,加埋 分享AI.

Maxim Bifrost vs Portkey — 邊個喺防護欄方面更強?

兩個都強調 管治同可觀察性. 。如果你嘅主要需求係 透明嘅供應商選擇 同埋 即時故障切換 跨供應商,, 分享AI 為此專門設計。.

Maxim Bifrost vs Eden AI — 多AI服務定網關控制?

Eden AI 聚合多個AI服務(LLM、TTS、視覺)。. 彩虹橋 集中LLM嘅出口。 市場指導嘅路由 有價格/延遲/正常運行時間嘅可見性。 喺 你路由,揀選。 分享AI.

Maxim Bifrost vs LiteLLM— DIY代理或者包裝網關?

LiteLLM 係一個DIY代理/SDK。. 彩虹橋 係一個包裝網關。如果你唔想操作基礎設施而且想要。 市場 數據 + 有韌性嘅路由, ,用 分享AI. 。 (Bifrost經常引用基準數據對比LiteLLM;睇佢哋嘅repo/blog。)

Maxim Bifrost vs Unify— 最佳模型選擇 vs 政策執行?

統一 優化選擇質量;; 彩虹橋 執行政策/路由。要結合。 多供應商 訪問,, 路由前嘅透明性, ,同 故障轉移, ,揀選 分享AI.

Maxim Bifrost vs Orq AI— 編排 vs 出口?

Orq 幫助編排流程;; 彩虹橋 管理出口。. 分享AI 配合市場觀點同有彈性嘅路由。.

Maxim Bifrost 對 Kong AI Gateway — 企業級閘道對開發速度閘道?

兩者都係閘道。如果你仲需要 透明市場 比較同 即時故障切換 跨供應商,層 分享AI.

Maxim Bifrost 對 Apigee — API 管理對 AI 專屬閘道?

Apigee 係廣泛嘅API管理;; 彩虹橋 係專注於 AI。對於 與供應商無關嘅訪問 用一個 即時市場, 分享AI 係更適合嘅選擇。.

Maxim Bifrost 對 NGINX — 自己動手對即用型?

NGINX 提供 DIY 控制;; 彩虹橋 係即用型。為咗避免自定 Lua 同時仲可以獲得 透明嘅供應商選擇 同埋 故障轉移, ,用 分享AI.

“「我搵咗 Portkey替代品 — 呢個有關係咩?」”

係—Portkey 亦都係一個 閘道. 呢度嘅評估標準(價格/延遲/正常運行時間透明度、故障切換、治理、可觀察性、開發者速度)同樣適用。如果你想 Portkey替代品 加入 市場指導嘅路由 同埋 人力供應, ,試下 分享AI 首先。.

資源(Maxim Bifrost)

- Maxim Bifrost(產品頁面) — 定位同「1000+模型」,性能定位。.

- Bifrost 文檔:概覽同開始使用 — 統一API、使用、架構連結。.

- 基準測試 — 喺5000 RPS嘅負載測試同實例規格。.

- 跟蹤功能 — 請求/回應跟蹤。.

- GitHub: maximhq/bifrost — 開源repo同readme。.