Traefik AI 网关替代方案 2026:十大替代方案

更新于 2026 年 3 月

如果您正在评估 Traefik AI Gateway 替代方案, ,本指南像构建者一样绘制了全景图。首先,我们明确 Traefik 的 AI Gateway 是什么——一个专注于出口的控制层,具有统一的 AI API、安全策略和可观察性——然后比较 10 个最佳替代方案. 。我们将 分享AI 放在首位,适合希望在多个提供商之间使用一个 API的团队,一个透明的市场,在路由之前显示价格/延迟/正常运行时间/可用性,即时故障转移,以及以人为本的经济学(70% 的支出用于提供商)。.

什么是 Traefik AI Gateway(以及它不是)

Traefik AI 网关 在 Traefik Hub 的 API Gateway 之上添加了一个薄的专用控制层。它专注于 LLM 流量,暴露了专门的中间件(例如,, 内容保护, 语义缓存),集中管理凭据/策略,并与 OpenTelemetry 集成以实现可观察性——因此每个 AI 端点都可以作为 API 进行生命周期管理、安全保护和观察。这是一个以治理为主的网关,而不是一个透明的模型市场。.

聚合器 vs 网关 vs 代理平台

- LLM 聚合器:一个 API 跨多个模型/提供商,具有路由前透明性(价格、延迟、正常运行时间、可用性、提供商类型)以及智能路由/故障转移。.

- AI 网关:边缘的策略/治理(凭据、速率限制、防护措施),加上可观察性;您带来您的提供商。Traefik AI Gateway 属于此类别。.

- 代理/聊天机器人平台:打包的用户体验、内存/工具、渠道——面向最终用户助手,而不是与提供商无关的聚合。.

我们如何评估最佳的 Traefik AI Gateway 替代方案

- 模型广度与中立性:专有 + 开源;轻松切换;无需重写。.

- 延迟与弹性:路由策略、超时、重试、即时故障切换。.

- 治理与安全:密钥处理、范围、区域路由。.

- 可观测性:日志/跟踪和成本/延迟仪表板。.

- 定价透明度与总拥有成本 (TCO):比较实际成本 在 你路由之前。.

- 开发者体验:文档、SDK、快速入门;首次获取令牌的时间。.

- 社区与经济:无论您的支出是否促进供应(为 GPU 拥有者提供激励)。.

前 10 名 Traefik AI Gateway 替代方案

#1 — ShareAI(由人驱动的AI API)

它是什么。. 一个多提供商 API,具有 透明的市场 和 智能路由. 。通过一次集成,浏览大量模型和提供商目录,比较 价格、延迟、正常运行时间、可用性、供应商类型, ,并通过 即时故障切换. 。经济是以人为本的: 每一美元的 70% 流向提供商 (社区或公司),他们保持模型在线。.

为什么它在这里是#1。. 如果您需要与供应商无关的聚合 预路由 透明性和弹性,ShareAI 是最直接的选择。如果需要组织范围的政策,请保留网关;添加 ShareAI 以实现市场引导的路由。.

- 一个 API → 150+ 个模型,涵盖多个供应商;无需重写,无需绑定。.

- 透明市场:按价格、延迟、正常运行时间、可用性、供应商类型选择。.

- 默认的弹性:路由策略 + 即时故障转移。.

- 公平经济:70% 的支出用于供应商(社区或公司)。.

快速链接 — 浏览模型 · 打开 Playground · 创建API密钥 · API参考 · 用户指南 · 发布

对于提供商:通过保持模型在线来赚取收益

任何人都可以成为 ShareAI 提供商——社区 或 公司. 。通过 Windows、Ubuntu、macOS 或 Docker 入驻。贡献 空闲时间 爆发或运行 始终在线. 。选择您的激励措施: 1. 奖励 (金钱),, 交换 (代币/AI专业用户),或 5. 使命 (捐赠 1% 给非政府组织)。随着您的扩展,您可以设置自己的推理价格并获得优先曝光。.

供应商链接 — 提供商指南 · 提供者仪表板 · 交易概览 · 使命贡献

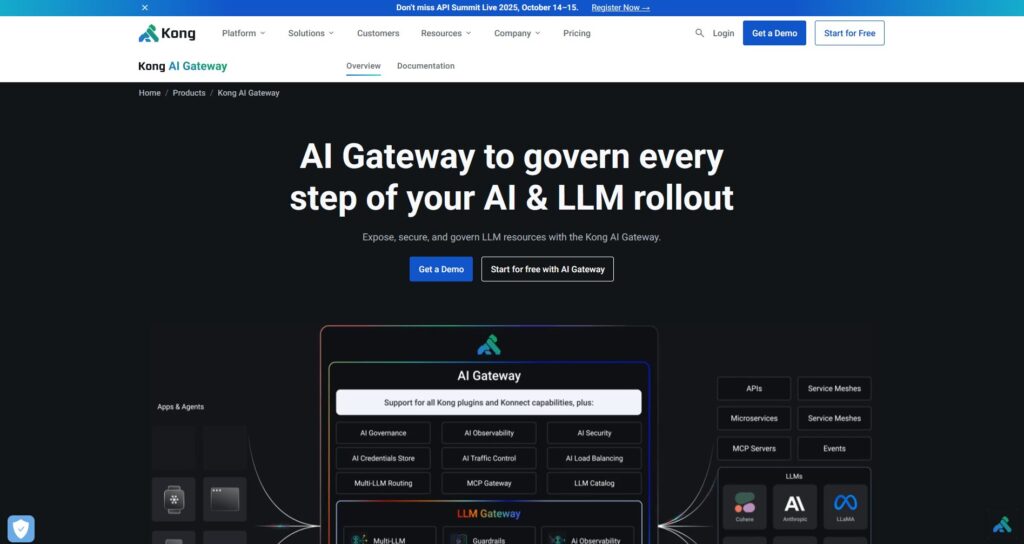

#2 — Kong AI 网关

它是什么。. 企业AI/LLM网关——治理、策略/插件、分析、边缘AI流量的可观测性。这是一个控制平面,而不是一个市场。.

#3 — Portkey

它是什么。. 强调可观测性、安全防护和治理的AI网关——在受监管行业中很受欢迎。.

#4 — OpenRouter

它是什么。. 统一的 API 覆盖多个模型;非常适合在广泛的目录中快速实验。.

#5 — Eden AI

它是什么。. 聚合了 LLM 和更广泛的 AI 功能(图像、翻译、TTS),支持回退/缓存和批处理。.

#6 — LiteLLM

它是什么。. 一个轻量级的Python SDK + 可自托管的代理 支持与多个提供商兼容的OpenAI接口。.

#7 — Unify

它是什么。. 面向质量的路由和评估,以根据提示选择更好的模型。.

#8 — Orq AI

它是什么。. 编排/协作平台,帮助团队通过低代码流程从实验转向生产。.

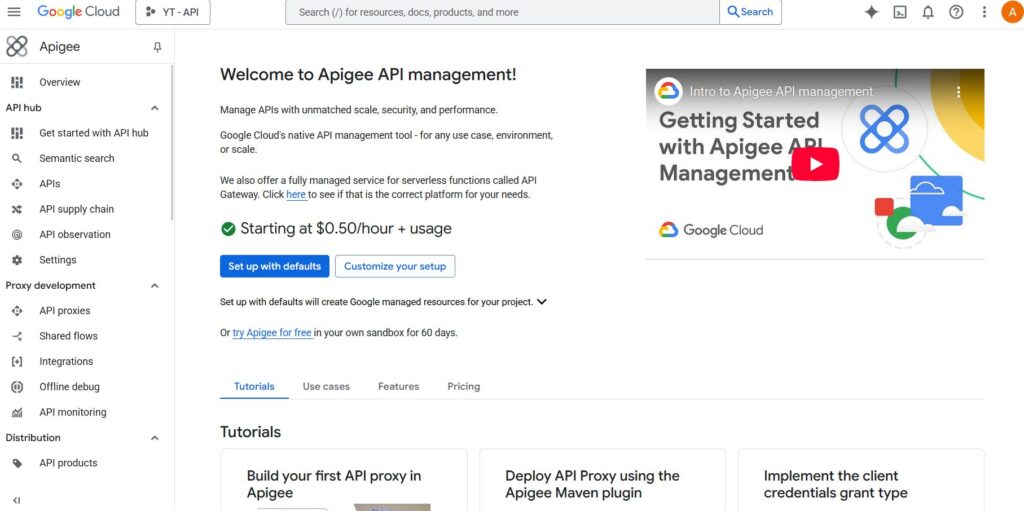

#9 — Apigee(背后有LLM)

它是什么。. 一个成熟的API管理/网关,可以放置在LLM提供商前面以应用策略、密钥和配额。.

#10 — NGINX

它是什么。. 如果您更喜欢DIY控制,可以使用NGINX为LLM后端构建自定义路由、令牌执行和缓存。.

Traefik AI Gateway与ShareAI对比

如果您需要 一个API覆盖多个提供商 与 透明的定价/延迟/正常运行时间 和 即时故障切换, 中,选择 分享AI. 如果您的首要需求是 出口治理——集中式凭据、策略执行和支持OpenTelemetry的可观测性——Traefik AI Gateway适合这一领域。许多团队将它们结合使用:网关用于组织策略 + ShareAI用于市场路由。.

快速比较

| 平台 | 服务对象 | 模型广度 | 治理与安全 | 可观测性 | 路由/故障切换 | 市场透明度 | 提供商计划 |

|---|---|---|---|---|---|---|---|

| 分享AI | 产品/平台团队需要一个API + 公平经济性 | 150+模型,多个提供商 | API密钥和每路由控制 | 控制台使用 + 市场统计 | 智能路由 + 即时故障切换 | 是 (价格、延迟、正常运行时间、可用性、提供商类型) | 是 ——开放供应;70%到提供商 |

| Traefik AI 网关 | 需要出口治理的团队 | 自带供应商 | 集中式凭证/策略 | OpenTelemetry 指标/追踪 | 通过中间件进行条件路由 | 否 (基础设施工具,不是市场) | 不适用 |

| Kong AI网关 | 需要网关级策略的企业 | 自带 | 强大的边缘策略/插件 | 分析 | 代理/插件,重试 | 否(基础设施) | 不适用 |

| 门钥 | 受监管/企业团队 | 广泛 | 护栏与治理 | 深度追踪 | 条件路由 | 部分 | 不适用 |

| OpenRouter | 开发者希望一个关键点 | 广泛目录 | 基本API控制 | 应用端 | 回退 | 部分 | 不适用 |

| 伊甸AI | 团队需要LLM + 其他AI服务 | 广泛 | 标准控制 | 变化 | 回退/缓存 | 部分 | 不适用 |

| LiteLLM | 自助/自托管代理 | 许多提供商 | 配置/密钥限制 | 您的基础设施 | 重试/回退 | 不适用 | 不适用 |

| 统一 | 质量驱动的团队 | 多模型 | 标准API安全性 | 平台分析 | 最佳模型选择 | 不适用 | 不适用 |

| Orq | 编排优先的团队 | 广泛支持 | 平台控制 | 平台分析 | 编排流程 | 不适用 | 不适用 |

| Apigee / NGINX | 企业 / DIY | 自带 | 政策 | 附加组件 / 定制 | 定制 | 不适用 | 不适用 |

Traefik的网关功能——轻量级AI层,专用中间件如 内容保护 和 语义缓存, ,以及支持OpenTelemetry的可观测性——在官方文档中有详细说明。.

定价与TCO:比较实际成本(不仅仅是单价)

原始$/1K令牌隐藏了真实情况。TCO随着重试/回退、延迟(影响使用)、提供商差异、可观测性存储和评估运行而变化。 透明的市场 帮助您选择平衡成本和用户体验的路线。.

TCO ≈ Σ (Base_tokens × Unit_price × (1 + Retry_rate)) + Observability_storage + Evaluation_tokens + Egress

- 原型(约10k令牌/天): 优化首次令牌生成时间(Playground,快速入门)。.

- 中规模(约2M令牌/天): 基于市场的路由/故障切换可减少10–20%,同时改善用户体验。.

- 峰值工作负载: 在故障切换期间重试会导致更高的有效令牌成本;为此预留预算。.

迁移指南:迁移到ShareAI

来自Traefik AI网关

在网关级别保留其优势的策略,添加 分享AI 用于市场路由+即时故障切换。模式:网关认证/策略 → ShareAI按模型路由 → 测量市场统计数据 → 收紧策略。.

来自 OpenRouter

映射模型名称,验证提示一致性,然后影子10%流量并逐步增加至25% → 50% → 100%,确保延迟/错误预算保持。市场数据使提供商切换变得简单。.

来自 LiteLLM

替换您不想操作的生产路由上的自托管代理;如果需要,可保留 LiteLLM 用于开发。比较操作开销与托管路由的优势。.

来自 Unify / Portkey / Orq / Kong

定义功能一致性期望(分析、保护措施、编排、插件)。许多团队运行混合模式:在其最强的地方保留专业功能;使用 分享AI 实现透明的提供商选择和故障切换。.

开发者快速入门(复制粘贴)

以下使用与 OpenAI 兼容的界面。替换 YOUR_KEY 为您的 ShareAI 密钥——在此获取 创建API密钥. 查看 API参考 了解详细信息。.

#!/usr/bin/env bash"

// JavaScript (fetch) — Node 18+/Edge runtimes;

安全、隐私与合规检查清单(与供应商无关)

- 密钥处理:轮换频率;最小范围;环境分离。.

- 数据保留:提示/响应存储位置,存储时长;默认编辑。.

- PII及敏感内容:屏蔽;访问控制;; 区域路由 数据地域性。.

- 可观测性:提示/响应日志记录;过滤或匿名化的能力;一致传播跟踪ID(OTel)。.

- 事件响应:升级路径和提供商服务级别协议(SLA)。.

常见问题解答 — Traefik AI网关与其他竞争对手比较

Traefik AI Gateway 与 ShareAI——哪个适合多供应商路由?

ShareAI。. 它专为市场透明度(价格、延迟、正常运行时间、可用性、供应商类型)而设计, 智能路由/故障切换 跨多个供应商。Traefik AI Gateway 是一个 出口治理 工具(集中式凭证/策略;OpenTelemetry 可观测性;AI 中间件)。许多团队同时使用两者。.

Traefik AI Gateway 与 OpenRouter——快速多模型访问还是网关控制?

OpenRouter 使多模型访问变得快速;Traefik AI Gateway 集中管理策略和可观测性。如果您还需要 路由前的透明性 即时故障切换,, 分享AI 将多提供商访问与市场视图和弹性路由相结合。.

Traefik AI Gateway 与 LiteLLM——自托管代理还是托管治理?

LiteLLM 是一个您自己操作的 DIY 代理;Traefik AI Gateway 是 AI 出口的托管治理/可观测性。如果您不想运行代理并希望基于市场驱动的路由,请选择 分享AI.

Traefik AI Gateway 与 Portkey——谁在防护措施方面更强?

两者都强调治理和可观测性;深度和人体工程学有所不同。如果您的主要需求是 透明的提供商选择 和 故障切换, ,添加 分享AI.

Traefik AI Gateway 与 Unify——最佳模型选择还是策略执行?

Unify 专注于基于评估的模型选择;Traefik AI Gateway 专注于策略/可观测性。对于一个 API 跨多个供应商并具有实时市场统计数据,请使用 分享AI.

Traefik AI Gateway 与 Eden AI——多个 AI 服务还是出口控制?

Eden AI 聚合了多个 AI 服务(LLM、图像、TTS)。Traefik AI Gateway 使用专门的 AI 中间件集中管理策略/凭证。为了实现多个提供商之间透明的定价/延迟以及即时故障切换,请选择 分享AI.

Traefik AI Gateway vs Orq — 编排 vs 出口?

Orq 帮助编排工作流;Traefik AI Gateway 管理出口流量。. 分享AI 与市场路由相辅相成。.

Traefik AI Gateway vs Kong AI Gateway — 两个网关

两者都是网关(策略、插件、分析),而非市场。许多团队将网关与 分享AI 用于透明的多提供商路由和故障切换。.

Traefik AI Gateway vs Apigee — API 管理 vs AI 专用出口

Apigee 是广泛的 API 管理;Traefik AI Gateway 是基于 Traefik Hub 的 AI 专注出口治理。如果您需要与市场透明度相结合的提供商无关访问,请使用 分享AI.

Traefik AI Gateway vs NGINX — 自定义 vs 一站式

NGINX 提供自定义过滤器/策略;Traefik AI Gateway 提供带有 AI 中间件和支持 OpenTelemetry 的可观察性的一体化层。为了避免自定义 Lua 并仍然获得透明的提供商选择,请添加 分享AI.

尝试 ShareAI 下一步

打开 Playground · 创建您的API密钥 · 浏览模型 · 阅读文档 · 查看发布版本 · 登录 / 注册

来源(Traefik AI Gateway)

- 解决方案概述 — 统一的 AI API,集中管理凭证/策略,,

- AI Gateway 文档(概述) — 薄控制层 + 专用中间件。.

- 内容保护 和 语义缓存 中间件。.

- 可观测性(OpenTelemetry) — OTel 格式的指标和追踪。.

- 追踪参考 — 追踪上下文传播和支持的传播器。.