ทางเลือก Helicone 2026: 10 อันดับแรก

อัปเดต มีนาคม 2026

หากคุณกำลังค้นคว้า ทางเลือกของ Helicone, คู่มือนี้จะวางโครงสร้างเหมือนที่ผู้สร้างจะทำ ก่อนอื่นเราจะชี้แจงว่า Helicone คืออะไร (และไม่ใช่อะไร) จากนั้นเราจะเปรียบเทียบ 10 ทางเลือกที่ดีที่สุด—จัดลำดับ แชร์เอไอ อันดับแรกสำหรับทีมที่ต้องการ API เดียวสำหรับผู้ให้บริการหลายราย ความโปร่งใสก่อนการกำหนดเส้นทาง (ราคา, ความหน่วง, ความพร้อมใช้งาน, ประเภทผู้ให้บริการ), การเปลี่ยนไปใช้ระบบสำรองทันที, และเศรษฐศาสตร์ที่ขับเคลื่อนด้วยผู้คน (70% ของการใช้จ่ายไปยังผู้ให้บริการที่รักษาโมเดลให้พร้อมใช้งานออนไลน์).

Helicone คืออะไร (และไม่ใช่อะไร)

เฮลิคอน เริ่มต้นเป็นแพลตฟอร์มการสังเกตการณ์ LLM แบบโอเพนซอร์ส—พร็อกซีที่บันทึกและวิเคราะห์การจราจร LLM ของคุณ (ความหน่วง, ค่าใช้จ่าย, การใช้งาน) เพื่อช่วยคุณแก้ไขข้อบกพร่องและปรับปรุงประสิทธิภาพ เมื่อเวลาผ่านไป ผลิตภัณฑ์ได้เพิ่ม เกตเวย์ AI ด้วย API เดียวสำหรับโมเดลกว่า 100+ โมเดล ในขณะที่ยังคงเน้นการกำหนดเส้นทาง การแก้ไขข้อบกพร่อง และการวิเคราะห์.

จากเว็บไซต์และเอกสารอย่างเป็นทางการ:

- การสังเกตการณ์ LLM แบบโอเพนซอร์สด้วยการตั้งค่าเพียงบรรทัดเดียว; บันทึก/เมตริกสำหรับคำขอ.

- AI Gateway พร้อมพื้นผิวที่รวมเป็นหนึ่งเพื่อเข้าถึงโมเดลกว่า 100+ โมเดลและบันทึกคำขอโดยอัตโนมัติ.

- การวางตำแหน่ง: กำหนดเส้นทาง แก้ไขข้อบกพร่อง และวิเคราะห์แอป AI ของคุณ.

การตีความ: Helicone ผสมผสานการสังเกตการณ์ (การบันทึก/เมตริก) เข้ากับเกตเวย์ มันมีการรวมข้อมูลบางส่วน แต่จุดศูนย์กลางยังคงอยู่ที่ การวัดผลเป็นอันดับแรก (ตรวจสอบ, เฝ้าระวัง, วิเคราะห์) ซึ่งแตกต่างจาก ตลาดหลายผู้ให้บริการที่โปร่งใส ที่คุณตัดสินใจเส้นทางตาม ก่อนการกำหนดเส้นทาง ราคาโมเดล/ผู้ให้บริการ, ความหน่วง, ความพร้อมใช้งาน และการเปลี่ยนแปลงได้อย่างรวดเร็วเมื่อเงื่อนไขเปลี่ยนแปลง (ซึ่งเป็นจุดเด่นของ ShareAI)

ตัวรวมข้อมูล vs เกตเวย์ vs แพลตฟอร์มการสังเกตการณ์

- ตัวรวมข้อมูล/ตลาด LLM: API เดียวสำหรับผู้ให้บริการหลายรายพร้อม ความโปร่งใสก่อนการกำหนดเส้นทาง (ราคา, ความหน่วง, เวลาทำงาน, ความพร้อมใช้งาน, ประเภทผู้ให้บริการ) และ การกำหนดเส้นทางอัจฉริยะ/การสำรองข้อมูล.

- เกตเวย์ AI: การกำกับดูแลและนโยบายที่ขอบ (คีย์แบบรวมศูนย์, การจำกัดอัตรา, การป้องกัน), การสังเกตการณ์, การกำหนดเส้นทางบางส่วน; คุณนำผู้ให้บริการมาเอง.

- แพลตฟอร์มการสังเกตการณ์: จับคำขอ/การตอบกลับ, ความหน่วง, ค่าใช้จ่าย; การแก้ไขปัญหาแบบ APM.

- ไฮบริด (เช่น Helicone): แกนกลางการสังเกตการณ์ + คุณสมบัติเกตเวย์, เส้นแบ่งที่ไม่ชัดเจนมากขึ้นเรื่อยๆ.

วิธีที่เราประเมินทางเลือกที่ดีที่สุดสำหรับ Helicone

- ความกว้างของโมเดล & ความเป็นกลาง: เป็นกรรมสิทธิ์ + เปิด; สลับง่าย; เขียนใหม่ให้น้อยที่สุด.

- ความหน่วง & ความยืดหยุ่น: นโยบายการกำหนดเส้นทาง, การหมดเวลา, การลองใหม่, การเปลี่ยนไปใช้ระบบสำรองทันที.

- การกำกับดูแล & ความปลอดภัย: การจัดการคีย์, ขอบเขต; การกำหนดเส้นทางระดับภูมิภาค/การตั้งค่าข้อมูลในพื้นที่.

- การสังเกตการณ์: บันทึก/การติดตามและ แดชบอร์ดต้นทุน/ความหน่วง.

- ความโปร่งใสด้านราคา & TCO: เปรียบเทียบต้นทุนจริง ก่อน การกำหนดเส้นทาง.

- ประสบการณ์ของนักพัฒนา: เอกสาร, SDKs, การเริ่มต้นอย่างรวดเร็ว; เวลาในการรับโทเค็นแรก.

- ชุมชน & เศรษฐศาสตร์: ไม่ว่าการใช้จ่ายของคุณจะช่วยเพิ่มอุปทาน (แรงจูงใจสำหรับเจ้าของ GPU).

10 อันดับทางเลือก Helicone

#1 — ShareAI (API AI ที่ขับเคลื่อนโดยผู้คน)

มันคืออะไร. A API หลายผู้ให้บริการ พร้อมกับ ตลาดที่โปร่งใส และ การกำหนดเส้นทางอัจฉริยะ. ด้วยการรวมหนึ่งครั้ง, เรียกดูแคตตาล็อกขนาดใหญ่ของโมเดลและผู้ให้บริการ, เปรียบเทียบ ราคา, ความหน่วง, ความพร้อมใช้งาน, ประเภทผู้ให้บริการ, และกำหนดเส้นทางด้วย การเปลี่ยนไปใช้ระบบสำรองทันที. เศรษฐศาสตร์ขับเคลื่อนโดยผู้คน: 70% ของทุกดอลลาร์ ไหลไปยังผู้ให้บริการ (ชุมชนหรือบริษัท) ที่รักษาโมเดลให้ออนไลน์.

ทำไมมันถึงเป็น #1 ที่นี่. หากคุณต้องการ การรวมแบบไม่ยึดติดกับผู้ให้บริการ ด้วย ความโปร่งใสก่อนการกำหนดเส้นทาง และ ความยืดหยุ่น, ShareAI เป็นตัวเลือกที่ตรงที่สุด เก็บเกตเวย์ไว้หากคุณต้องการนโยบายทั่วทั้งองค์กร; เพิ่ม ShareAI สำหรับ การกำหนดเส้นทางที่แนะนำโดยตลาด.

- หนึ่ง API → โมเดลกว่า 150+ ครอบคลุมผู้ให้บริการหลายราย; ไม่มีการเขียนใหม่, ไม่มีการผูกมัด.

- ตลาดที่โปร่งใส: เลือกตามราคา ความหน่วงเวลา ความพร้อมใช้งาน ประเภทผู้ให้บริการ.

- ความยืดหยุ่นโดยค่าเริ่มต้น: นโยบายการกำหนดเส้นทาง + การสำรองข้อมูลทันที.

- เศรษฐศาสตร์ที่เป็นธรรม: 70% ของค่าใช้จ่ายไปยังผู้ให้บริการ (ชุมชนหรือบริษัท).

ลิงก์ด่วน — เรียกดูโมเดล · เปิด Playground · สร้างคีย์ API · เอกสารอ้างอิง API · การเปิดตัว

สำหรับผู้ให้บริการ: รับรายได้โดยการรักษาโมเดลออนไลน์

ใครๆ ก็สามารถเป็นผู้ให้บริการ ShareAI ได้—ชุมชนหรือบริษัท เข้าร่วมผ่าน Windows, Ubuntu, macOS หรือ Docker มีส่วนร่วมในช่วงเวลาว่างหรือทำงานตลอดเวลา เลือกแรงจูงใจของคุณ: รางวัล (เงิน), แลกเปลี่ยน (โทเค็น/AI Prosumer) หรือภารกิจ (บริจาค % ให้กับองค์กรไม่แสวงหาผลกำไร) เมื่อคุณขยาย คุณสามารถตั้งราคาการอนุมานของคุณเองและได้รับการเปิดเผยที่เป็นที่นิยม ลิงก์ผู้ให้บริการ — คู่มือผู้ให้บริการ · แดชบอร์ดผู้ให้บริการ

#2 — OpenRouter

API ที่รวมเป็นหนึ่งเดียวในแคตตาล็อกที่กว้างขวาง—เหมาะสำหรับการทดลองอย่างรวดเร็วและการครอบคลุม มีความแข็งแกร่งในด้านความกว้างและการทดลองอย่างรวดเร็ว; จับคู่กับตลาดสำหรับความโปร่งใสก่อนการกำหนดเส้นทางและการสำรองข้อมูล.

#3 — อีเดน AI

รวม LLMs รวมถึง AI ที่กว้างขึ้น (การมองเห็น, การแปล, การพูด) เหมาะสำหรับทีมที่ต้องการหลายรูปแบบนอกเหนือจากข้อความ; เพิ่มการกำหนดเส้นทางที่แนะนำโดยตลาดเพื่อปรับสมดุลต้นทุนและเวลาแฝง.

#4 — พอร์ทคีย์

เกตเวย์ AI ที่เน้นการสังเกตการณ์, การป้องกัน, และการกำกับดูแล—เป็นที่นิยมในสภาพแวดล้อมที่มีการควบคุม เก็บไว้สำหรับความลึกของนโยบาย; เพิ่ม ShareAI สำหรับตัวเลือกผู้ให้บริการและการสำรองข้อมูล.

#5 — ไลท์LLM

SDK Python น้ำหนักเบาและพร็อกซีโฮสต์เองที่พูดอินเทอร์เฟซที่เข้ากันได้กับ OpenAI กับผู้ให้บริการหลายราย เหมาะสำหรับ DIY; สลับไปที่ ShareAI เมื่อคุณไม่ต้องการใช้งานพร็อกซีในระบบการผลิต.

#6 — ยูนิฟาย

การกำหนดเส้นทางและการประเมินที่เน้นคุณภาพเพื่อเลือกโมเดลที่ดีกว่าต่อคำสั่งเสริมด้วย ShareAI เมื่อคุณต้องการสถิติตลาดสดและการสำรองข้อมูลทันที.

#7 — ออร์ค AI

การจัดการและการทำงานร่วมกันเพื่อเปลี่ยนจากการทดลองไปสู่การผลิตด้วยโค้ดต่ำ รันควบคู่ไปกับเลเยอร์การกำหนดเส้นทางและตลาดของ ShareAI.

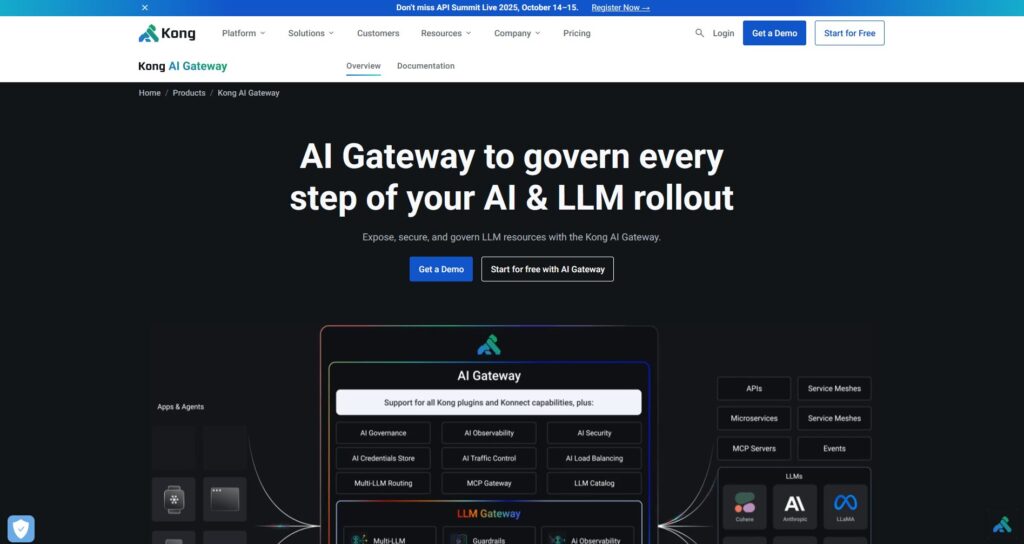

#8 — Kong AI Gateway

เกตเวย์สำหรับองค์กร: นโยบาย, ปลั๊กอิน, การวิเคราะห์ และการสังเกตการณ์สำหรับทราฟฟิก AI ที่ขอบ เป็นแผงควบคุมมากกว่าตลาด.

#9 — Traefik AI Gateway

เลเยอร์ AI บาง ๆ บนเกตเวย์ API ของ Traefik—มิดเดิลแวร์เฉพาะทาง, การจัดการข้อมูลรับรองแบบรวมศูนย์ และการสังเกตการณ์ที่เป็นมิตรกับ OpenTelemetry จับคู่กับ ShareAI เพื่อการกำหนดเส้นทางแบบโปร่งใสหลายผู้ให้บริการ.

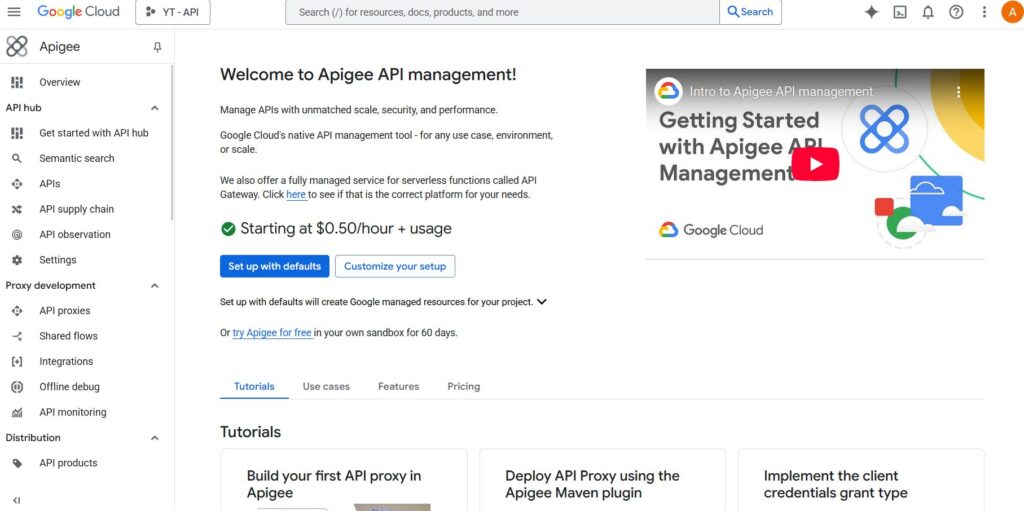

#10 — Apigee / NGINX (DIY)

การจัดการ API ทั่วไป (Apigee) และพร็อกซีที่ตั้งโปรแกรมได้ (NGINX) คุณสามารถสร้างการควบคุมเกตเวย์ AI ของคุณเอง เพิ่ม ShareAI เพื่อความโปร่งใสของตลาดและการสำรองข้อมูลโดยไม่ต้องใช้ระบบท่อที่กำหนดเอง.

Helicone vs ShareAI (โดยสังเขป)

- หากคุณต้องการ API เดียวสำหรับผู้ให้บริการหลายราย ด้วย การกำหนดราคาที่โปร่งใส/ความหน่วง/เวลาทำงาน และ การเปลี่ยนไปใช้ระบบสำรองทันที, เลือก แชร์เอไอ.

- หากความต้องการสูงสุดของคุณคือ การสังเกตการณ์และการดีบัก, วิธีการที่เน้นการสังเกตการณ์ของ Helicone มีคุณค่า; ด้วย AI Gateway ใหม่กว่า มันให้การเข้าถึงแบบรวมศูนย์แต่ไม่มี ตลาดผู้ให้บริการ ด้วย ก่อนการกำหนดเส้นทาง ความโปร่งใส.

การเปรียบเทียบอย่างรวดเร็ว

| แพลตฟอร์ม | ใครที่มันให้บริการ | ความกว้างของโมเดล | การกำกับดูแล & ความปลอดภัย | การสังเกตการณ์ | การกำหนดเส้นทาง / การสำรองข้อมูล | ความโปร่งใสของตลาด | โปรแกรมผู้ให้บริการ |

|---|---|---|---|---|---|---|---|

| แชร์เอไอ | ทีมผลิตภัณฑ์และแพลตฟอร์มที่ต้องการ API เดียว + เศรษฐศาสตร์ที่ยุติธรรม | 150+ โมเดล, ผู้ให้บริการหลายราย | คีย์ API & การควบคุมต่อเส้นทาง | การใช้งานคอนโซล + สถิติของตลาด | การกำหนดเส้นทางอัจฉริยะ + การสลับสำรองทันที | ใช่ (ราคา, ความหน่วง, เวลาทำงาน, ความพร้อมใช้งาน, ประเภทผู้ให้บริการ) | ใช่ — เปิดซัพพลาย; 70% ให้กับผู้ให้บริการ |

| เฮลิคอน | ทีมที่ต้องการการสังเกตการณ์ + การเข้าถึง AI Gateway | โมเดลมากกว่า 100+ ผ่าน Gateway | คีย์แบบรวมศูนย์ผ่าน Gateway | ใช่ — บันทึก/เมตริก | การกำหนดเส้นทางตามเงื่อนไข | บางส่วน (มุมมองเกตเวย์; ไม่ใช่ตลาดการกำหนดราคา) | ไม่มี |

| OpenRouter | นักพัฒนาที่ต้องการการเข้าถึงหลายโมเดลอย่างรวดเร็ว | แคตตาล็อกที่กว้าง | การควบคุม API ขั้นพื้นฐาน | ฝั่งแอป | การสำรองข้อมูล | บางส่วน | ไม่มี |

| อีเดน AI | LLM + บริการ AI อื่นๆ | กว้าง | การควบคุมมาตรฐาน | แตกต่างกัน | การสำรองข้อมูล/การแคช | บางส่วน | ไม่มี |

| พอร์ทคีย์ | ถูกควบคุม/องค์กร | กว้าง | รั้วป้องกัน & การกำกับดูแล | การติดตามเชิงลึก | มีเงื่อนไข | บางส่วน | ไม่มี |

| LiteLLM | ทำเอง/โฮสต์พร็อกซีด้วยตัวเอง | ผู้ให้บริการหลายราย | การกำหนดค่า/ข้อจำกัดของคีย์ | โครงสร้างพื้นฐานของคุณ | การลองใหม่/การสำรองข้อมูล | ไม่มี | ไม่มี |

| รวมเป็นหนึ่ง | ทีมที่มุ่งเน้นคุณภาพ | หลายโมเดล | ความปลอดภัยมาตรฐาน | การวิเคราะห์แพลตฟอร์ม | การเลือกโมเดลที่ดีที่สุด | ไม่มี | ไม่มี |

| Orq | การจัดการลำดับงานเป็นอันดับแรก | การสนับสนุนที่กว้างขวาง | การควบคุมแพลตฟอร์ม | การวิเคราะห์แพลตฟอร์ม | การไหลของการจัดการระบบ | ไม่มี | ไม่มี |

| คอง AI เกตเวย์ | องค์กร/เกตเวย์ | ผู้ให้บริการ BYO | นโยบายขอบที่แข็งแกร่ง | การวิเคราะห์ | พร็อกซี/ปลั๊กอิน, การลองใหม่ | ไม่มี (โครงสร้างพื้นฐาน) | ไม่มี |

| เกตเวย์ AI ของ Traefik | การกำกับดูแลการออก | ผู้ให้บริการ BYO | นโยบายแบบรวมศูนย์ | OpenTelemetry | มิดเดิลแวร์ | ไม่มี (โครงสร้างพื้นฐาน) | ไม่มี |

การกำหนดราคา & TCO: เปรียบเทียบ จริง ต้นทุน (ไม่ใช่แค่ราคาต่อหน่วย)

การซ่อน $/1K โทเค็นแบบดิบไม่แสดงภาพจริง TCO เปลี่ยนแปลงตามการลองใหม่/การสำรอง, ความหน่วง (ซึ่งส่งผลต่อพฤติกรรมผู้ใช้), ความแตกต่างของผู้ให้บริการ, การจัดเก็บข้อมูลการสังเกตการณ์, และการประเมินผลการทำงาน ตลาดที่โปร่งใสช่วยให้คุณเลือกเส้นทางที่สมดุลระหว่างต้นทุนและ UX.

การจัดกรอบแบบง่าย:

TCO ≈ Σ (Base_tokens × Unit_price × (1 + Retry_rate))- ต้นแบบ (~10k tokens/วัน): ปรับให้เหมาะสมสำหรับเวลาในการรับโทเค็นแรก (Playground, quickstarts).

- ขนาดกลาง (~2M tokens/วัน): การกำหนดเส้นทาง/การสำรองที่แนะนำโดยตลาดสามารถลดลงได้ 10–20% พร้อมปรับปรุง UX.

- งานที่มีความแปรปรวนสูง: งบประมาณสำหรับต้นทุนโทเค็นที่มีประสิทธิภาพสูงขึ้นจากการลองใหม่ในระหว่างการเปลี่ยนเส้นทางสำรอง.

คู่มือการย้าย: การย้ายไปยัง ShareAI (จาก Helicone หรืออื่นๆ)

จาก Helicone

ใช้ Helicone ในจุดที่โดดเด่น—การวัดผล—และเพิ่ม ShareAI สำหรับการกำหนดเส้นทางในตลาดและการเปลี่ยนเส้นทางสำรองทันที รูปแบบทั่วไป: แอป → (นโยบายเกตเวย์ที่เป็นทางเลือก) → เส้นทาง ShareAI ต่อโมเดล → วัดสถิติในตลาด → ปรับนโยบายให้เข้มงวดขึ้นเมื่อเวลาผ่านไป เมื่อคุณเปลี่ยนเส้นทาง ให้ตรวจสอบความสอดคล้องของคำสั่งและความหน่วง/ต้นทุนที่คาดหวังใน สนามเด็กเล่น ก่อนการเปิดตัวเต็มรูปแบบ.

จาก OpenRouter

จับคู่ชื่อโมเดล ยืนยันความเข้ากันได้ของคำสั่ง จากนั้นเงา 10% ของทราฟฟิกและเพิ่มขึ้น 25% → 50% → 100% หากงบประมาณความหน่วง/ข้อผิดพลาดยังคงอยู่ ข้อมูลในตลาดทำให้การเปลี่ยนผู้ให้บริการเป็นเรื่องง่าย.

จาก LiteLLM

แทนที่พร็อกซีที่โฮสต์เองในเส้นทางการผลิตที่คุณไม่ต้องการดำเนินการ; เก็บ LiteLLM สำหรับการพัฒนาหากคุณต้องการ เปรียบเทียบค่าใช้จ่ายในการดำเนินงานกับประโยชน์ของการกำหนดเส้นทางที่มีการจัดการ.

จาก Unify / Portkey / Orq / Kong / Traefik

กำหนดความคาดหวังของคุณสมบัติที่เทียบเท่า (การวิเคราะห์, การป้องกัน, การจัดการ, ปลั๊กอิน) หลายทีมใช้รูปแบบไฮบริด: เก็บคุณสมบัติเฉพาะในจุดที่แข็งแกร่งที่สุด; ใช้ ShareAI สำหรับการเลือกผู้ให้บริการที่โปร่งใสและการเปลี่ยนเส้นทางสำรอง.

การเริ่มต้นอย่างรวดเร็วสำหรับนักพัฒนา (คัดลอก-วาง)

สิ่งต่อไปนี้ใช้พื้นผิวที่เข้ากันได้กับ OpenAI แทนที่ YOUR_KEY ด้วยคีย์ ShareAI ของคุณ — สร้างคีย์ได้ที่ สร้างคีย์ API. ดูที่ เอกสารอ้างอิง API สำหรับรายละเอียด.

#!/usr/bin/env bash"// JavaScript (fetch) — Node 18+/Edge;รายการตรวจสอบด้านความปลอดภัย ความเป็นส่วนตัว และการปฏิบัติตามข้อกำหนด (ไม่ขึ้นกับผู้ให้บริการ)

- การจัดการคีย์: ความถี่ในการหมุน; ขอบเขตขั้นต่ำ; การแยกสภาพแวดล้อม.

- การเก็บรักษาข้อมูล: ที่คำสั่ง/คำตอบถูกจัดเก็บไว้นานเท่าใด; การตั้งค่าการลบข้อมูลเริ่มต้น.

- PII & เนื้อหาที่ละเอียดอ่อน: การปิดบัง; การควบคุมการเข้าถึง; การกำหนดเส้นทางตามภูมิภาค สำหรับการตั้งถิ่นฐานข้อมูลในท้องถิ่น.

- การสังเกตการณ์: การบันทึกคำสั่ง/การตอบกลับ; ความสามารถในการกรองหรือใช้นามแฝง; การส่งต่อ รหัสติดตาม อย่างสม่ำเสมอ (OTel).

- การตอบสนองต่อเหตุการณ์: เส้นทางการยกระดับและ SLA ของผู้ให้บริการ.

คำถามที่พบบ่อย — Helicone เทียบกับคู่แข่งอื่นๆ (และตำแหน่งที่ ShareAI เหมาะสม)

Helicone เทียบกับ ShareAI — อันไหนเหมาะสำหรับการกำหนดเส้นทางหลายผู้ให้บริการ?

แชร์เอไอ. มันถูกสร้างขึ้นสำหรับ ความโปร่งใสของตลาด (ราคา, ความหน่วง, เวลาทำงาน, ความพร้อมใช้งาน, ประเภทผู้ให้บริการ) และ การกำหนดเส้นทางอัจฉริยะ/การสำรองข้อมูล ข้ามผู้ให้บริการหลายราย Helicone มุ่งเน้นที่ การสังเกตการณ์ และตอนนี้เพิ่ม AI Gateway; มันเป็นการวัดผลที่มีประโยชน์ แต่ไม่ใช่ตลาดที่มีความโปร่งใสก่อนการกำหนดเส้นทาง หลายทีมใช้ทั้งสองอย่าง: Helicone สำหรับบันทึก; ShareAI สำหรับการเลือกเส้นทาง.

Helicone เทียบกับ OpenRouter — การเข้าถึงหลายโมเดลอย่างรวดเร็วหรือความโปร่งใสในตลาด?

OpenRouter ทำให้การเข้าถึงหลายโมเดลรวดเร็ว; Helicone เพิ่มการบันทึก/วิเคราะห์เชิงลึก หากคุณต้องการ ความโปร่งใสก่อนการกำหนดเส้นทาง และ การเปลี่ยนไปใช้ระบบสำรองทันที, แชร์เอไอ รวมการเข้าถึงหลายผู้ให้บริการเข้ากับ มุมมองตลาด และการกำหนดเส้นทางที่ยืดหยุ่น.

Helicone vs Portkey — ใครแข็งแกร่งกว่าด้านการป้องกัน?

Portkey มุ่งเน้นที่การกำกับดูแล/การป้องกัน; Helicone มุ่งเน้นที่การตรวจวัด + เกตเวย์ หากความต้องการหลักของคุณคือ การเลือกผู้ให้บริการที่โปร่งใส และ การสำรองข้อมูล, เพิ่ม แชร์เอไอ.

Helicone vs LiteLLM — โฮสต์พร็อกซีด้วยตัวเองหรือเลเยอร์ที่จัดการ?

LiteLLM เป็นพร็อกซี/SDK แบบ DIY; Helicone คือการตรวจวัด + เกตเวย์ หากคุณไม่ต้องการรันพร็อกซีและคุณต้องการ การกำหนดเส้นทางที่ขับเคลื่อนด้วยตลาด, เลือก แชร์เอไอ.

Helicone vs Unify — การเลือกโมเดลที่ดีที่สุด vs การบันทึก?

Unify เน้นการเลือกโมเดลที่ขับเคลื่อนด้วยการประเมิน; Helicone เน้นการบันทึก ShareAI เพิ่ม สถิติของตลาดแบบเรียลไทม์ และการกำหนดเส้นทางเมื่อคุณต้องการ ต้นทุน/ความหน่วง การควบคุมก่อนที่คุณจะส่งทราฟฟิก.

Helicone vs Eden AI — บริการ AI จำนวนมากหรือการตรวจวัด + เกตเวย์?

Eden AI รวมหลายรูปแบบ; Helicone ผสมผสานการตรวจวัด + การเข้าถึงโมเดล สำหรับ การกำหนดราคาที่โปร่งใส/ความหน่วง ข้ามผู้ให้บริการและ การเปลี่ยนไปใช้ระบบสำรองทันที, ใช้ แชร์เอไอ.

Helicone vs Orq — การจัดการกระบวนการ vs การตรวจวัด?

Orq ช่วยจัดการกระบวนการทำงาน; Helicone ช่วยบันทึกและวิเคราะห์ Layer แชร์เอไอ สำหรับ การกำหนดเส้นทางที่ไม่ขึ้นกับผู้ให้บริการ ผูกกับสถิติของตลาด.

Helicone เทียบกับ Kong AI Gateway — ความลึกของเกตเวย์เทียบกับการวัดผล?

Kong เป็นเกตเวย์ที่แข็งแกร่ง (นโยบาย/ปลั๊กอิน/การวิเคราะห์); Helicone คือการสังเกตการณ์ + เกตเวย์ หลายทีมจับคู่เกตเวย์กับ แชร์เอไอ สำหรับ การกำหนดเส้นทางที่โปร่งใส.

Helicone เทียบกับ Traefik AI Gateway — การกำกับดูแล OTel หรือการกำหนดเส้นทางตลาด?

Traefik AI Gateway รวมศูนย์นโยบายขาออกด้วยการสังเกตการณ์ที่เป็นมิตรกับ OTel; Helicone เสนอการวัดผลพร้อมพื้นผิวเกตเวย์ สำหรับ API หนึ่งตัวที่ครอบคลุมผู้ให้บริการหลายรายด้วย ความโปร่งใสก่อนการกำหนดเส้นทาง, ใช้ แชร์เอไอ.

Helicone เทียบกับ Apigee / NGINX — สำเร็จรูปเทียบกับทำเอง?

Apigee/NGINX เสนอการควบคุม API ทั่วไป; Helicone เป็นการวัดผลเฉพาะ AI + เกตเวย์ หากคุณต้องการ การเลือกผู้ให้บริการที่โปร่งใส และ การสำรองข้อมูล โดยไม่ต้องทำเอง, แชร์เอไอ ถูกออกแบบมาเพื่อสิ่งนั้น.

แหล่งข้อมูล & การอ่านเพิ่มเติม (Helicone)

- หน้าแรกของ Helicone — AI Gateway & LLM Observability; “กำหนดเส้นทาง, แก้จุดบกพร่อง, วิเคราะห์;” API หนึ่งตัวสำหรับโมเดลกว่า 100+.

- เอกสารของ Helicone — AI Gateway พร้อมการเข้าถึงโมเดลและการบันทึกอัตโนมัติ.

- Helicone GitHub — โครงการโอเพ่นซอร์สสำหรับการสังเกตการณ์ LLM.

ลิงก์ด่วน — เรียกดูโมเดล · เปิด Playground · อ่านเอกสาร · ดูการเผยแพร่ · ลงชื่อเข้าใช้ / ลงทะเบียน